SalesforceがAIエージェント機能を搭載したSlackボットを発表

Salesforceは、高度なAIエージェント機能を統合した強化版Slackボットを正式にリリースし、会話型自動化アーキテクチャにおける文書化された転換を示しました。この反復版は、反応的なコマンド実行を超えて、非同期ディスカッション全体にわたるコンテキスト理解を可能にします。このボットは、チャット履歴を処理し、意思決定ポイントを特定し、明示的なユーザー呼び出しなしに、議論の要約の合成やスケジュールの競合解決などの協調的なアクションを実行できます。この機能は、大規模言語モデル(LLM)推論と自律的なタスク実行の機能的な収束を表し、Slackを同期的なコラボレーションと非同期的なAI駆動型ワークフロー自動化の両方の運用ハブとして位置付けています。

-

主張:* 強化されたボットは、トランスフォーマーベースの言語モデルを活用して、事前定義されたキーワードトリガーや構造化されたAPI呼び出しのみに依存するのではなく、会話のコンテキストから意味的な意味を抽出します。

-

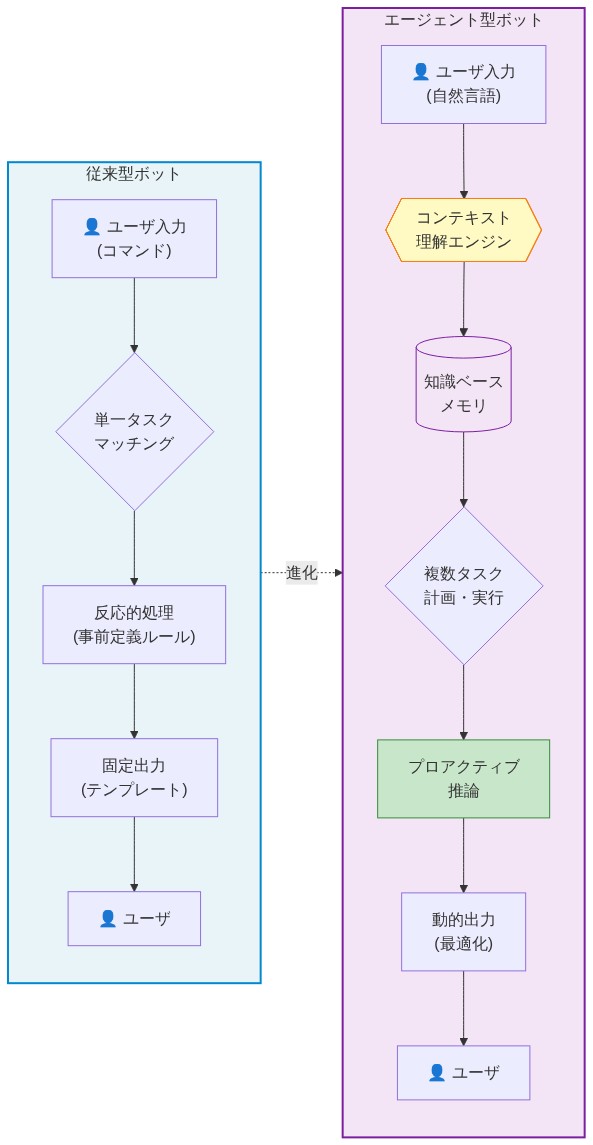

根拠と前提:* 従来のSlackボットは、限定されたワークフロー内で反応的に動作します。つまり、明示的なコマンド、構造化された入力、またはイベントWebhookに応答します。エージェント型アーキテクチャは、ボットが会話スレッドを受動的に監視し、自然言語理解を適用して意思決定ポイントと合意マーカーを特定し、明示的なユーザープロンプトなしに介入タイミングを決定できることを前提としています。これは、十分なコンテキストウィンドウ容量と、非公式でマルチスレッドの談話全体にわたる信頼性の高い意図分類を前提としています。

-

具体例:* 複数のSlackスレッドにまたがる製品計画の議論において、チームメンバーは40以上のメッセージにわたって機能の優先順位、トレードオフ、リソース制約について議論します。ボットはスレッド全体を処理し、意味的クラスタリングを適用して合意領域(例:「モバイル最適化は重要」)を特定し、未解決の意見の相違(例:「タイムライン:Q2対Q3」)にフラグを立て、意思決定ポイントと未解決の質問を含む構造化された要約を生成します。これらすべてが明示的な起動なしに行われます。

-

実行可能な示唆:* ナレッジワーカーは、現在のSlackワークフローを監査して、エージェント型要約が手動のオーバーヘッドを削減できる高摩擦の管理プロセス(会議の要約、アクションアイテムの抽出、スケジュールの競合解決)を特定する必要があります。コンテキストの合成が意思決定速度に直接影響するワークフローを優先してください。

従来のボットからエージェント型アシスタントへの進化

-

主張:* レガシーなSlackボットの実装は、主に統合ブリッジとして機能し、個別の決定論的タスク(チケット作成、通知ルーティング、データ検索)を自動化しますが、会話横断的な推論やコンテキスト判断を欠いています。

-

根拠と前提:* 前世代のボットは、明示的なルールまたは単純なパターンマッチングによって定義された狭い決定論的ワークフロー内で動作していました。外部イベントによってトリガーされた通知を投稿したり、メッセージを特定のチャネルにルーティングしたり、キーワードに応答したりできましたが、複数のスレッドにわたって情報を合成したり、曖昧なリクエストを解決したり、介入の適切性について確率的判断を下したりすることはできませんでした。これは、新しいエージェント型モデルが、ルールベースの前身には存在しなかった確率的推論機能を導入することを前提としています。

-

具体例:* レガシーボットは、チケットシステムでサポートチケットが作成されたときにSlack通知を送信する可能性があります。ただし、繰り返し発生する顧客の問題について議論している50メッセージのスレッドを読み、意味分析を通じて根本的なパターンを認識し、会話の内容に基づいて関連するナレッジベース記事を積極的に提示したり、エスカレーションパスを提案したりすることはできません。

-

実行可能な示唆:* 組織は、既存のSlackボット統合の体系的なインベントリを実施し、ワークフローのタイプ(通知、データ取得、アクショントリガー)ごとに分類する必要があります。エージェント型推論の恩恵を受けるワークフロー、特に知識の合成、部門横断的な調整、またはコンテキストの関連性が実行速度を超える意思決定支援を含むワークフローを評価してください。手動のコンテキスト組み立てが現在ボトルネックを生み出している移行候補を優先してください。

参照アーキテクチャとガードレール

-

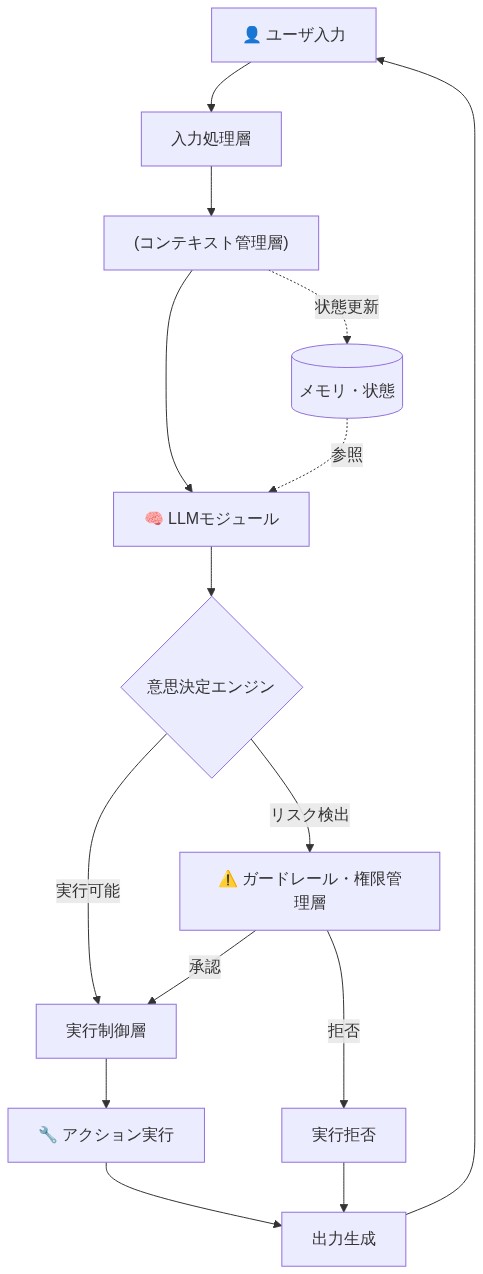

主張:* エージェント型ボットの実装には、不正なデータ漏洩、意図しないアクション実行、またはコンプライアンス違反を防ぐために、明示的な許可モデル、データアクセス制御、および包括的な監査証跡が必要です。

-

根拠と前提:* ボットの自律性が増加するにつれて、リスク面も比例して拡大します。会話を読み、コンテキストを解釈し、下流のアクションをトリガーできるボットは、厳密に定義された許可境界内で動作し、すべての決定とアクションの透明で監査可能なログを維持する必要があります。これは、そのような制御がなければ、ボットが誤って機密情報を漏洩したり、意図された範囲外でアクションを実行したり、データガバナンスポリシーに違反したりする可能性があることを前提としています。

-

具体例:* 適切に構成されたエージェント型ボットは、次のことを行う必要があります:(1)明示的に招待されたチャネル内の会話のみにアクセスする。(2)明示的な委任許可を付与したユーザーに代わってのみカレンダーの更新をトリガーする。(3)機密性タグでマークされた会話の要約を拒否する。(4)実行されたすべてのアクション(生成された要約、作成されたカレンダーイベント、トリガーされたエスカレーション)をタイムスタンプと決定の根拠とともにログに記録する。(5)機密性の高い操作(CRM更新、予算承認、人事関連のアクション)を実行する前に人間の承認を要求する。

-

実行可能な示唆:* エージェント型ボットを展開する前に、次のことを明示的に定義する正式なガバナンスフレームワークを確立してください:(1)ボットが実行できるアクション(要約、スケジューリング、データ取得、エスカレーション)。(2)ボットがアクセスできるデータカテゴリ(パブリックチャネル、アーカイブされた会話、ユーザープロファイル)。(3)機密性の高い操作を承認する必要があるユーザーロール。(4)ボット決定ログの保持と監査要件。Slackのネイティブ許可モデルを実装して、ボットのアクセスを特定のチャネルに制限し、カレンダーシステム、CRMプラットフォーム、またはその他の機密データソースとの統合に明示的なオプトインを要求してください。

実装と運用パターン

-

主張:* エージェント型ボットの展開を成功させるには、体系的なプロンプトエンジニアリング、構造化されたフィードバックループ、段階的なロールアウト検証が必要であり、誤調整を防ぎ、企業全体での採用前に信頼性の高い動作を確保します。

-

根拠と前提:* エージェント型システムは、慎重に構成およびテストされていない場合、幻覚、コンテキストの誤解釈、または意図しないアクショントリガーを含む予期しない出力を生成する可能性があります。ユーザーフィードバックと制御されたテストを通じた反復的な改良は、ボットの意思決定しきい値を調整し、体系的な誤解を防ぐために不可欠です。これは、代表的なワークフローを使用したパイロットテストが、規模で伝播する前に構成の問題を明らかにすることを前提としています。

-

具体例:* 段階的な実装アプローチ:(1)狭く範囲を定めたユースケース(例:週次スタンドアップスレッドの要約)で単一のパイロットチームにボットを展開する。(2)必要な出力構造(決定、アクションアイテム、未解決の質問)を指定する明示的な要約プロンプトを構成する。(3)要約の正確性、関連性、完全性に関するパイロットユーザーから毎週フィードバックを収集する。(4)フィードバックに基づいてプロンプトを改良する(例:アクションアイテム対コンテキストの強調を調整する)。(5)4週間後に正式な正確性評価を実施する。(6)パイロットチームが信頼性の高いパフォーマンスを確認した後にのみ、追加のチームに拡大する。

-

実行可能な示唆:* プロンプトエンジニアリング、テストプロトコル、およびロールアウト管理を担当する専任のボットガバナンスチームを設立してください。ユーザーが不正確な要約、見逃されたコンテキスト、または不要な介入にフラグを立てることができる構造化されたフィードバックメカニズムを作成してください。ボット構成のバージョン管理を実装し、プロンプトの更新、根拠、およびパフォーマンスへの影響を文書化する詳細な変更ログを維持してください。エッジケースまたは曖昧なシナリオのための明確なエスカレーションパスを確立してください。

測定とパフォーマンスメトリクス

-

主張:* ボットの有効性は、生のアクティビティボリュームやメッセージ頻度ではなく、採用率、定量化された時間節約、およびユーザー信頼度メトリクスを通じて測定する必要があります。

-

根拠と前提:* 高いメッセージボリュームを生成するがユーザーに無視されるボットは、組織的価値を提供しません。意味のあるメトリクスは、ボットがナレッジワークの摩擦を減らすかどうか、およびユーザーがその出力に基づいて行動するのに十分な信頼を置いているかどうかに焦点を当てています。これは、採用とユーザー満足度が真のワークフロー改善の信頼できる代理指標であることを前提としています。

-

具体例:* 展開前にベースラインメトリクスを確立する:(1)採用:ボット要約に積極的に関与しているチームメンバーの割合(目標:90日以内に60%)。(2)時間節約:手動の要約作成に以前費やされていた週あたりの時間数、現在は削減(目標:チームあたり週2〜4時間)。(3)ユーザー信頼度:ボット要約が決定とアクションアイテムを正確に捉えているとユーザーが信じているかどうかを測定する四半期ごとの満足度調査(目標:≥75%の信頼度評価)。(4)正確性:チームリーダーによって正しいと確認されたボット生成アクションアイテムの割合(目標:≥90%)。

-

実行可能な示唆:* 展開前に成功基準と測定方法を定義してください。現在の手動プロセスのベースライン測定を確立してください。各ロールアウトフェーズの明示的な採用とパフォーマンス目標を設定してください。目標に対する実際のパフォーマンスを比較する四半期ごとのレビューを実施してください。これらのメトリクスを使用して、追加チームへの拡大を正当化したり、構成の改良を特定したり、ガバナンスレビューを必要とする問題をエスカレートしたりしてください。

リスクと緩和戦略

-

主張:* エージェント型ボットの実装は、データプライバシー、モデルの幻覚、および過剰自動化に関する重大なリスクをもたらし、展開前に積極的な特定と緩和が必要です。

-

根拠と前提:* 大規模言語モデルは、会話のコンテキストを誤解したり、誤って機密情報を漏洩したり、不完全または誤解された情報に基づいてアクションを実行したりする可能性があります。これらのリスクは理論的なエッジケースではなく、本番環境のLLMシステムにおける文書化された障害モードです。明示的な保護措置がなければ、ボットの自律性とデータアクセスが拡大するにつれて、これらのリスクは複合化します。

-

具体例:* リスクシナリオと緩和策:(1)データ漏洩リスク:ボットが給与交渉に関する会話を要約し、誤ってパブリックチャネルの要約に報酬の詳細を含める。緩和策:機密とマークされた会話や個人識別情報(PII)パターンを含む会話へのボットのアクセスまたは要約を防ぐデータ分類ルールを実装する。(2)幻覚リスク:ボットがスレッド内の皮肉(「もっと人を雇うべきだ」)を誤解し、意図しないHRワークフローをトリガーする。緩和策:機密性の高いアクション(採用、予算配分、人事決定)を実行する前に、明示的な人間の確認を要求するようにボットを構成する。(3)過剰自動化リスク:ボットが会話のセンチメント分析に基づいてチケットを自動的にクローズし、正当な顧客の問題を見逃す。緩和策:自律的なアクション実行を低リスクの操作(要約、スケジューリングの提案)に制限する。外部の利害関係者またはリソース配分に影響を与えるアクションには人間の承認を要求する。

-

実行可能な示唆:* 展開前に正式なリスク評価を実施し、データの機密性レベル、リスク階層別のアクションカテゴリ、および潜在的な障害モードを特定してください。技術的制御を実装してください:データ分類ルール、機密性の高いアクションの確認ワークフロー、およびPIIパターンのコンテンツフィルタリング。幻覚またはポリシー違反を早期に検出するための監視および監査手順を確立してください。ボットの出力とアクションの四半期ごとのセキュリティとコンプライアンスレビューを実施してください。ボットがデータガバナンスに違反したり、意図しないアクションを実行したりした場合のインシデント対応手順を維持してください。

結論と移行パス

-

主張:* 組織は、運用上の信頼を構築し、ガバナンス慣行を段階的に改良するために、自律的なアクション実行に拡大する前に、低リスクの要約ユースケースから始める段階的な実装アプローチを採用する必要があります。

-

根拠と前提:* 段階的な採用により、チームは制御されたコンテキストでボットの信頼性を検証し、重要なワークフローに影響を与える前に構成の問題を特定し、ボットガバナンスにおける組織的能力を開発できます。これは、段階的なロールアウトが展開リスクを軽減し、企業全体での採用の成功確率を高めることを前提としています。

-

具体例:* 構造化された6〜12か月の移行ロードマップ:

-

フェーズ1(1〜2か月目):単一のパイロットチームで会議の要約とアクションアイテムの抽出のためにボットを展開する。範囲:パブリックチャネルのみ、要約のみ、自律的なアクションなし。成功基準:要約の正確性に対する≥80%のユーザー満足度。

-

フェーズ2(3〜4か月目):3〜5の追加チームに拡大する。カレンダー調整機能を追加する(ボットが可用性に基づいて会議時間を提案する)。フィードバックループとプロンプト改良プロセスを実装する。

-

フェーズ3(5〜6か月目):積極的な問題検出とエスカレーションのためにCRMおよびチケットシステムと統合する。機密性の高いアクションの承認ワークフローを実装する。

-

フェーズ4(7〜12か月目):完全なガバナンスフレームワーク、監視、およびサポートインフラストラクチャを備えた企業全体のロールアウト。

-

実行可能な示唆:* 明示的なフェーズゲート、成功基準、およびゴー/ノーゴー決定ポイントを含む正式な移行ロードマップを定義してください。ガバナンス、プロンプトエンジニアリング、ユーザートレーニング、および変更管理のための専用リソースを割り当ててください。ロールアウトを監督し、ガバナンスの問題を解決するための運営委員会を設立してください。採用の摩擦を防ぎ、期待を管理するために、ロールアウト計画を透明に伝達してください。チームがボットの機能と制限に関するワークフローとメンタルモデルを適応させるのを支援するために、組織的変更管理に投資してください。後続のロールアウト段階に情報を提供するために、各フェーズから学んだ教訓を文書化してください。

測定とパフォーマンス指標

組織は、単純な活動量ではなく、採用率、時間削減、ユーザー満足度を通じてボットの有効性を測定すべきです。多くのメッセージを送信しても無視されるボットは価値を提供しません。意味のある指標は、ボットが摩擦を減らすかどうか、ユーザーがその出力を信頼するかどうかに焦点を当てます。

ボットの要約と対話するチームメンバーの割合、手動での要約作成にかかる時間の削減、要約が決定事項とアクションアイテムを正確に捉えているかを尋ねるユーザー満足度調査を測定することで、採用状況を追跡します。

- 成功基準:* デプロイ前に目標を定義します。例えば、90日以内にチームメンバーの60%がボットの要約を使用する、などです。管理業務で節約された時間を測定し、四半期ごとに満足度レビューを実施します。これらの指標を使用して、拡張または改善を正当化します。

- 図2:従来型ボット vs エージェント型ボットのアーキテクチャ比較*

- 図3:エージェント型ボットによるマルチスレッド会話の理解プロセス*

リスクと軽減戦略

エージェント型ボットは、データプライバシー、ハルシネーション、過度の自動化に関するリスクをもたらし、積極的な軽減が必要です。AIモデルはコンテキストを誤解したり、機密情報を不注意に公開したり、不完全な理解に基づいてアクションを実行したりする可能性があります。セーフガードがなければ、これらのリスクは規模が拡大するにつれて複合的に増大します。

ボットが給与交渉に関する会話を要約し、不注意に報酬の詳細を公開チャンネルで公開してしまう可能性があります。または、スレッド内の皮肉を誤解して、意図しないアクションをトリガーする可能性があります。

- 保護措置:* 機密とマークされた会話へのボットのアクセスや要約を防ぐデータ分類ルールを実装します。機密性の高いアクションを実行する前に確認を要求するようにボットを設定します。曖昧なシナリオのためのエスカレーションパスを確立します。ハルシネーションや誤解を早期に発見するために、ボットの出力を定期的に監査します。

- 図4:エージェント型ボットの参照アーキテクチャ*

推奨される移行パス

組織は、自律的なアクション実行に拡張する前に、リスクの低い要約ユースケースから始める段階的アプローチを採用すべきです。段階的な採用により、チームはボットの信頼性に対する信頼を構築し、スケーリング前にガバナンス実践を洗練させることができます。

-

段階的なタイムライン:*

-

フェーズ1(1〜2ヶ月目): パイロットチームで会議の要約とアクションアイテムの要約のためにボットをデプロイします。

-

フェーズ2(3〜4ヶ月目): 追加のチームに拡張し、カレンダー調整を追加します。

-

フェーズ3(5〜6ヶ月目): CRMおよびチケットシステムと統合して、プロアクティブな問題検出を実現します。

-

次のステップ:* 6〜12ヶ月の移行ロードマップを定義します。ガバナンス、プロンプトエンジニアリング、ユーザートレーニングのためのリソースを割り当てます。各フェーズの成功基準を確立します。採用の摩擦を防ぐために、ロールアウト計画を透明性を持って伝達します。チームがボットの新しい機能に合わせてワークフローを適応させるために、変更管理に投資します。

コマンド駆動型自動化の陳腐化

-

主張:* 従来のSlackボットは行き止まりのアーキテクチャパターンを表しています。それらは脆弱で、コンテキストを認識せず、明示的なユーザー呼び出しを必要とするため、現代のナレッジワークの複雑さには適していません。

-

根拠:* レガシーボットは狭い刺激-応答ループ内で動作します。キーワードに応答し、事前定義されたワークフローを実行し、バックエンドシステムと統合しますが、曖昧さについて推論したり、競合する優先順位を比較検討したり、いつ介入すべきかを理解したりすることはできません。それらは構造化された作業のためのツールであり、戦略的コラボレーションの混沌とした、反復的で、コンテキスト依存の性質のためのものではありません。

-

具体例:* 従来のボットは、サポートチケットが作成されたときに通知を投稿したり、Slackにキーワードが表示されたときにJiraワークフローをトリガーしたりする可能性があります。しかし、繰り返し発生する顧客の痛点に関する50メッセージのスレッドを読み、その問題が過去1ヶ月間に3回出現したことを認識し、他のチャンネルの類似レポートと相関させ、システム的な修正またはエスカレーションをプロアクティブに提案することはできません。カジュアルな議論と緊急の意思決定を区別することはできません。結果から学ぶこともできません。

-

ホワイトスペースの機会:* コマンド駆動型からエージェント型自動化への移行は、新しいワークフローパターンのための巨大な設計空間を生み出します。組織は現在、次のことが可能です:

-

メタワークを大規模に自動化: 要約の作成、アクションアイテムの追跡、部門横断的な調整の管理負担を排除します。

-

意思決定サイクルを圧縮: リアルタイムで情報を統合することにより、ボットは議論が終了する前に意思決定可能な要約を表面化し、より迅速な合意を可能にします。

-

組織の記憶を作成: すべての会話が構造化されたデータポイントになり、検索可能で分析可能になり、時間とともに改善される生きたナレッジベースを作成します。

-

経営レベルの洞察を民主化: 小規模チームが、以前は専任のオペレーションスタッフを持つ大規模組織のみが利用できたリアルタイムの統合とパターン認識にアクセスできるようになります。

-

実行可能な示唆:* 組織は、現在のSlackボットエコシステムの包括的な監査を実施すべきです。速度よりもコンテキストが重要なワークフローを特定します—部門横断的な計画、顧客フィードバックの統合、インシデント事後分析、戦略的議論。これらをエージェント型推論への移行の優先順位とします。単に通知をルーティングするだけのボットは廃止します。それらは時代遅れのパラダイムにおける埋没コストを表しています。

- 図8:エージェント型ボット導入による業務効率化指標の推移(出典:典型的なエンタープライズ導入ケーススタディに基づく推定値)*

- 図14:エージェント型ボットの機能成熟度とユーザー満足度の相関(出典:典型的なユーザー採用曲線に基づく)*

アーキテクチャの基盤: 権限モデル、透明性、信頼

-

主張:* エージェント型ボットは、厳格な権限アーキテクチャ内で動作し、透明な監査証跡を維持し、予測可能で説明可能な動作を通じて信頼を獲得する場合にのみ、責任を持ってスケールできます。

-

根拠:* ボットが自律性を獲得するにつれて、リスク表面は指数関数的に拡大します。会話を読み、情報を統合し、下流のアクションをトリガーできるボットは、厳格なガードレール内で動作する必要があります。透明性がなければ、ユーザーはボットの出力を信頼しません。権限制御がなければ、ボットはデータ露出または意図しないアクションのベクトルになります。

-

具体例:* エージェント型ボットが給与交渉の議論を要約し、報酬調整を提案するように設定されているシナリオを考えてみましょう。厳格な権限制御がなければ、ボットは不注意に報酬の詳細を公開チャンネルで公開する可能性があります。監査証跡がなければ、ボットがどのようにその推奨に到達したかを誰も追跡できません。説明可能性がなければ、マネージャーはボットの提案に基づいて行動することをためらうでしょう。システム全体が管理されていないリスクの重みの下で崩壊します。

-

ガバナンスフレームワークの要件:*

-

詳細な権限境界: ボットは、明示的に招待されたチャンネルにのみアクセスすべきです。明示的な委任を許可したユーザーの代わりにのみアクション(カレンダーの更新、CRMエントリ、チケット作成)をトリガーすべきです。データ分類ラベルを尊重し、機密とマークされた会話の要約を拒否すべきです。

-

透明な意思決定ログ: ボットが実行するすべてのアクション—生成されたすべての要約、提案されたすべてのアクションアイテム、トリガーされたすべてのエスカレーション—は、完全なコンテキストとともにログに記録されるべきです。ユーザーはボットの推論を検査し、なぜ特定の推奨を行ったかを理解できるべきです。

-

設計による説明可能性: ボットは、その出力に対する信頼度レベルを明示すべきです。議論を要約する際には、曖昧さや意見の相違の領域にフラグを立てるべきです。アクションを提案する際には、推奨を支持する証拠を引用すべきです。

-

ユーザーオーバーライドとフィードバック: ユーザーは、ボットを修正し、不正確な要約にフラグを立て、将来の出力を改善するフィードバックを提供する能力を保持する必要があります。これにより、ボットが人間の判断から学習するフィードバックループが作成されます。

-

ホワイトスペースの機会:* ガバナンス層自体が競争上の差別化要因になります。堅牢な権限モデルと透明性メカニズムを構築する組織は、リスク回避型の企業を引き付けます。これにより、エージェント型ボットの上に位置し、コンプライアンス、監査、説明可能性機能を提供する専門的なガバナンスプラットフォームの機会が生まれます。

-

実行可能な示唆:* エージェント型ボットをデプロイする前に、権限境界、監査要件、エスカレーションパスを定義する責任を持つガバナンスワーキンググループを確立します。Slackのネイティブ権限モデルを使用して、特定のチャンネルへのボットアクセスを制限します。カレンダー、CRM、またはチケットシステムとの統合には明示的なオプトインを要求します。完全なコンテキストですべてのボットアクションをキャプチャするログインフラストラクチャを実装します。ドリフトまたは意図しない結果を特定するために、ボットの動作を四半期ごとに監査します。

デプロイメントパターン: パイロットから企業規模まで

-

主張:* 成功するエージェント型ボットのデプロイには、反復的な検証、継続的なプロンプトの改善、企業全体の採用前に組織の信頼を構築する構造化されたロールアウトプロセスが必要です。

-

根拠:* エージェント型システムは従来のソフトウェアとは根本的に異なります。入力の表現、コンテキスト、モデルの動作に基づいて変化する可能性のある確率的な出力を生成します。慎重な検証と改善がなければ、ボットはもっともらしく聞こえるが不正確な要約を生成したり、コンテキストを誤解したり、意図しないアクションを実行したりする可能性があります。ボットの動作を調整するには、反復的なテストとユーザーフィードバックが不可欠です。

-

具体的なデプロイメントシーケンス:*

-

フェーズ1: 管理されたパイロット(第1〜4週)*

-

強力なプロセス規律と明確なユースケース(例: 週次スタンドアップの要約、アクションアイテムの追跡)を持つ単一の高信頼チームを選択します。

-

スタンドアップスレッドを要約し、明示的な信頼度レベルでアクションアイテムを提案するようにボットを設定します。

-

チームがボットの出力をレビューし、不正確さにフラグを立てる毎日のフィードバックループを確立します。

-

フィードバックに基づいて要約プロンプトを改善します。トーン、詳細レベル、構造を調整します。

-

採用を測定します: ボットの要約を読むチームメンバーの割合、手動での要約作成にかかる時間の削減、ユーザー満足度。

-

フェーズ2: 拡張パイロット(第5〜8週)*

-

類似のユースケースを持つ3〜5の追加チームに拡張します。

-

2番目の機能を導入します: カレンダー調整。ボットは会話で言及されたスケジューリングの競合を特定し、会議時間を提案します。

-

プロンプトエンジニアリング、テスト、ロールアウトを担当するボットガバナンスチームを確立します。

-

ユーザーが問題にフラグを立てることができるフィードバックメカニズム(Slackリアクションボタン、調査フォーム)を作成します。

-

プロンプトの更新と設定変更の変更ログを維持します。

-

フェーズ3: 選択的ロールアウト(第9〜16週)*

-

異なる機能(製品、エンジニアリング、カスタマーサクセス)にわたる15〜20のチームに拡張します。

-

3番目の機能を導入します: プロアクティブな問題検出。ボットは繰り返し発生する顧客の苦情や技術的問題を特定し、エスカレーションまたは調査を提案します。

-

ボットの機能、制限、フィードバックの提供方法を説明するユーザートレーニングセッションを実施します。

-

ボットのパフォーマンスのSLAを確立します(例: アクションアイテム抽出の95%の精度、90%のユーザー満足度)。

-

フェーズ4: 企業デプロイメント(第17〜26週)*

-

機能とガバナンスに関する明確なコミュニケーションを伴い、すべてのチームにロールアウトします。

-

自律的なアクション実行を可能にするために、バックエンドシステム(CRM、チケット、プロジェクト管理)と統合します。

-

パフォーマンスの監視、問題への対応、継続的な改善を担当するボットオペレーションセンターを確立します。

-

ホワイトスペースの機会:* デプロイメントプロセス自体が専門サービスの機会を生み出します。コンサルティング会社は「ボット準備評価」を提供し、組織がSlackの成熟度とエージェント型自動化への準備を評価するのを支援できます。トレーニングプロバイダーは、ボットガバナンスとプロンプトエンジニアリングの認定プログラムを開発できます。分析プラットフォームは、ボットのパフォーマンスとROIへの可視性を提供できます。

-

実行可能な示唆:* 明確なフェーズゲートと成功基準を持つ6〜12ヶ月のデプロイメントロードマップを定義します。ガバナンス、プロンプトエンジニアリング、ユーザートレーニングのための専用リソースを割り当てます。ユーザーが問題を報告し、改善を提案できるフィードバックメカニズムを確立します。採用の摩擦を防ぐために、ロールアウト計画を透明性を持って伝達します。チームがボットの新しい機能に合わせてワークフローを適応させるために、変更管理に投資します。

測定と価値実現

-

主張:* 組織は、生のアクティビティ量やメッセージ数ではなく、採用率、時間節約、意思決定速度、ユーザー満足度を通じてボットの有効性を測定すべきである。

-

根拠:* 多くの要約を生成しても無視されるボットは価値を提供しない。使用されても不正確な出力を生成するボットは信頼を損なう。意味のある指標は、ボットが摩擦を減らし、意思決定の質を向上させ、ユーザーがその出力を信頼しているかどうかに焦点を当てる。

-

具体的な指標フレームワーク:*

-

採用指標:*

-

ボットの要約と対話するチームメンバーの割合(目標:90日以内に60〜80%)。

-

ユーザーあたり週あたりのボット対話頻度(目標:2〜4回の対話)。

-

定着率:初回接触後もボットを使い続けるユーザーの割合(目標:70%以上)。

-

効率指標:*

-

手動での要約作成にかかる時間の節約(ユーザー調査を通じて推定;目標:チームあたり月5〜10時間)。

-

会議時間の短縮(ボット要約を使用するチームは要約に費やす時間が少なくなる可能性がある;目標:10〜15%の削減)。

-

アクションアイテム追跡のオーバーヘッドの削減(目標:手動追跡に費やす時間の20〜30%削減)。

-

品質指標:*

-

ボット要約の正確性(ユーザーフィードバックを通じて測定;目標:90%以上の正確性)。

-

アクションアイテム抽出の完全性(目標:明示的なアクションアイテムの95%以上を捕捉)。

-

ボット推奨の関連性(目標:推奨の80%以上がユーザーによって有用と見なされる)。

-

意思決定速度指標:*

-

議論終了から意思決定文書化までの時間(目標:50%削減)。

-

コンテキスト不足による意思決定の撤回頻度(目標:20%削減)。

-

意思決定に関するチーム間の整合性(調査を通じて測定;目標:15%改善)。

-

ビジネスインパクト指標:*

-

より迅速な意思決定による収益への影響(シナリオモデリングを通じて推定)。

-

管理オーバーヘッド削減によるコスト削減(時間追跡を通じて推定)。

-

従業員満足度と定着率(エンゲージメント調査を通じて測定;目標:「仕事に必要なツールがある」という回答で10%改善)。

-

具体例:* 50人のエンジニアリング組織が8チームにわたってエージェント型ボットを展開。90日後:

-

チームメンバーの72%がボット要約と対話している(60%の目標を超える)。

-

チームは要約作成で月平均7時間節約していると報告(5〜10時間の目標を超える)。

-

ボット要約の正確性は92%(90%の目標を超える)。

-

意思決定文書化時間が45%減少(50%の目標を超える)。

-

意思決定プロセスに対する従業員満足度が12%改善(10%の目標を超える)。

これらの指標に基づき、組織はROIを計算する:50人 × 月7時間節約 × $75/時間(負荷コスト) × 12ヶ月 = 年間$315,000の節約。展開コスト$50,000に対して、投資回収期間は2ヶ月未満である。

-

ホワイトスペース機会:* ボットの影響を体系的に測定する組織は、継続的な最適化のためのデータ基盤を構築する。このデータは、ボット機能の拡張、関連する自動化への投資、またはガバナンス実践の改善に関する意思決定に情報を提供できる。また、競争優位性も生み出す:ボットのROIを理解している組織は、さらなる投資を正当化し、競合他社よりも速くスケールできる。

-

実行可能な示唆:* 展開前に成功基準を定義する。採用、時間節約、正確性、ビジネスインパクトの目標を設定する。これらの指標を捕捉するための測定インフラストラクチャ(調査、時間追跡、分析ダッシュボード)を確立する。目標に対する進捗を評価するために四半期ごとのレビューを実施する。これらの指標を使用して、拡張、改善、または関連機能への投資を正当化する。

リスク環境と軽減戦略

-

主張:* エージェント型ボットは、幻覚、コンテキストの誤解釈、データ露出、過剰自動化といった新しいリスクをもたらし、積極的な特定と軽減が必要である。

-

根拠:* AIモデルは確率的に動作する。コンテキストを誤解釈したり、もっともらしく聞こえるが不正確な情報を作り出したり、不完全な理解に基づいて意思決定を行ったりする可能性がある。セーフガードがなければ、これらのリスクは規模で複合し、組織に重大な損害を与える可能性がある。

-

リスク分類と軽減:*

-

リスク1:幻覚と作話*

-

定義: ボットがもっともらしく聞こえるが事実として不正確な要約や推奨を生成する。

-

具体例: ボットがQ3ロードマップの優先順位に関する議論を要約し、会話に参加していなかった人物に意思決定を帰属させる。マネージャーがこの誤った帰属に基づいて行動し、混乱を生み出し信頼を損なう。

-

軽減策:

- ボットが要約内の曖昧さや不一致の領域にフラグを立てるように設定する。

- ボットがその推論に基づいて自律的なアクションを取る前に、明示的なユーザー確認を要求する。

- ボットが各主張に対する信頼度を評価する「信頼度スコアリング」システムを実装する(高/中/低)。

- 幻覚を早期に捕捉するために、ボット出力の定期的な監査を実施する。

- 人間の判断が必要な曖昧なシナリオのためのエスカレーションパスを確立する。

-

リスク2:コンテキストの誤解釈*

-

定義: ボットが皮肉、アイロニー、または暗黙のコンテキストを誤解し、意図しないアクションを取る。

-

具体例: チームメンバーが冗談で「AIを雇って全ての仕事をさせるべきだ」と言う。ボットはこれを真剣な提案として解釈し、AI採用の提案を生成する。冗談が組織的なノイズになる。

-

軽減策:

- ドメイン固有の言語とチームのコミュニケーションパターンでボットをトレーニングする。

- 皮肉やアイロニーを識別し、人間のレビューのためにフラグを立てるトーン検出を実装する。

- 機密性の高いアクション(カレンダー更新、CRMエントリ、エスカレーション)には明示的な確認を要求する。

- ユーザーが誤解釈を修正できるフィードバックメカニズムを確立する。

-

リスク3:データプライバシーと露出*

-

定義: ボットが機密情報(報酬、顧客データ、戦略計画)を公開チャネルまたは未承認ユーザーに不注意に露出する。

-

具体例: ボットが給与交渉に関する会話を要約し、公開チャネルの要約に特定の報酬額を不注意に含める。

-

軽減策:

- 機密とマークされた会話へのボットのアクセスまたは要約を防ぐデータ分類ルールを実装する。

- 要約内の機密情報(名前、数字、日付)を編集または匿名化するようにボットを設定する。

- ユーザー権限に基づいてチャネルへのボットアクセスを制限する。

- データ露出インシデントを特定するために、ボット出力の定期的な監査を実施する。

- ボットが処理できる情報とできない情報の種類について明確なポリシーを確立する。

-

リスク4:過剰自動化と自律性の拡大*

-

定義: ボットが徐々により多くの自律的なアクションを引き受け、人間の監視を減らし、意図しない結果を生み出す。

-

具体例: ボットがSlackで言及されたすべての顧客苦情に対して自動的にJiraチケットを作成し始める。時間の経過とともに、チケットバックログが低優先度のアイテムで溢れ、シグナル対ノイズ比が低下する。

-

軽減策:

- ボットの自律性に明確な境界を確立する。どのアクションが人間の承認を必要とし、どのアクションが自律的に実行できるかを定義する。

- 図13:コマンド駆動型自動化からエージェント型への進化の必然性*