VS Code December 2025 (バージョン 1.108): Agent Skills 実験的対応

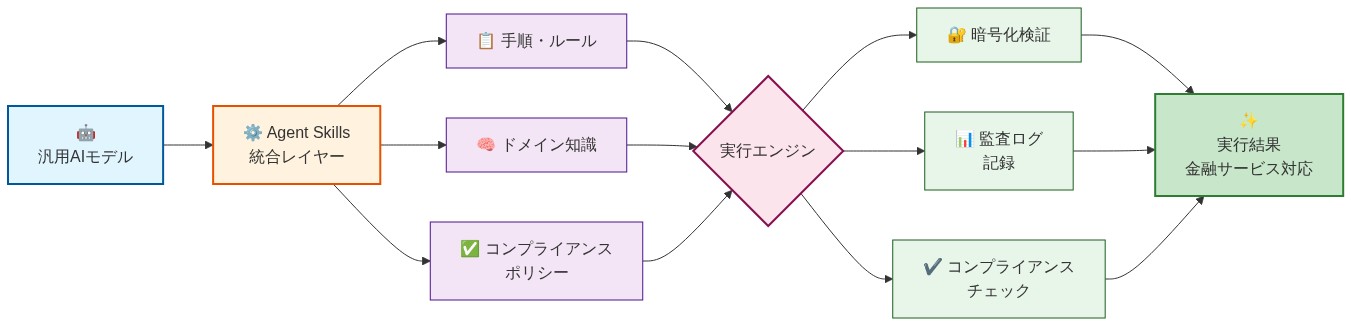

Microsoftは、Visual Studio Code December 2025 (バージョン 1.108) をリリースしました。このバージョンでは、Agent Skills の実験的対応が含まれています。Agent Skills は、開発者がタスクの手順とドメイン固有の知識を AI アシスタントに組み込むことができる機能です。この機能により、AI エージェントは汎用言語モデルの機能を超えたタスク固有の指示を実行できます。

Agent Skills が実現すること

Agent Skills は、汎用 AI 機能とドメイン固有の要件の間の摩擦を軽減します。手続き的知識をバージョン管理し、プロジェクト全体で再利用できるようにします。汎用言語モデルのみに依存するのではなく、チームは組織のワークフロー、コーディング標準、ビジネスロジックを個別のスキルモジュールにエンコードできるようになります。

開発チームは独自の制約の中で動作します。レガシーシステムの統合パターン、規制遵守ルール、内部アーキテクチャ標準などです。汎用 AI アシスタントはこのコンテキストを持っていません。Agent Skills はこのギャップを埋め、チームが AI エージェントがタスクを完了する際に従うステップバイステップの手順をエンコードできるようにします。

- 例:* 金融サービスチームは、すべての API 呼び出しに監査ログ、暗号化検証、コンプライアンスチェックを含めることを保証するスキルを定義できます。AI エージェントが新しい支払いモジュール用のコードを生成する場合、このスキルが自動的に適用され、手動のコンプライアンスレビューが不要になります。

実験的ステータスは、本番環境への完全な展開前にフィードバックを収集するという Microsoft のコミットメントを示しており、早期採用者がこの機能の進化を形作るための理想的な機会となります。

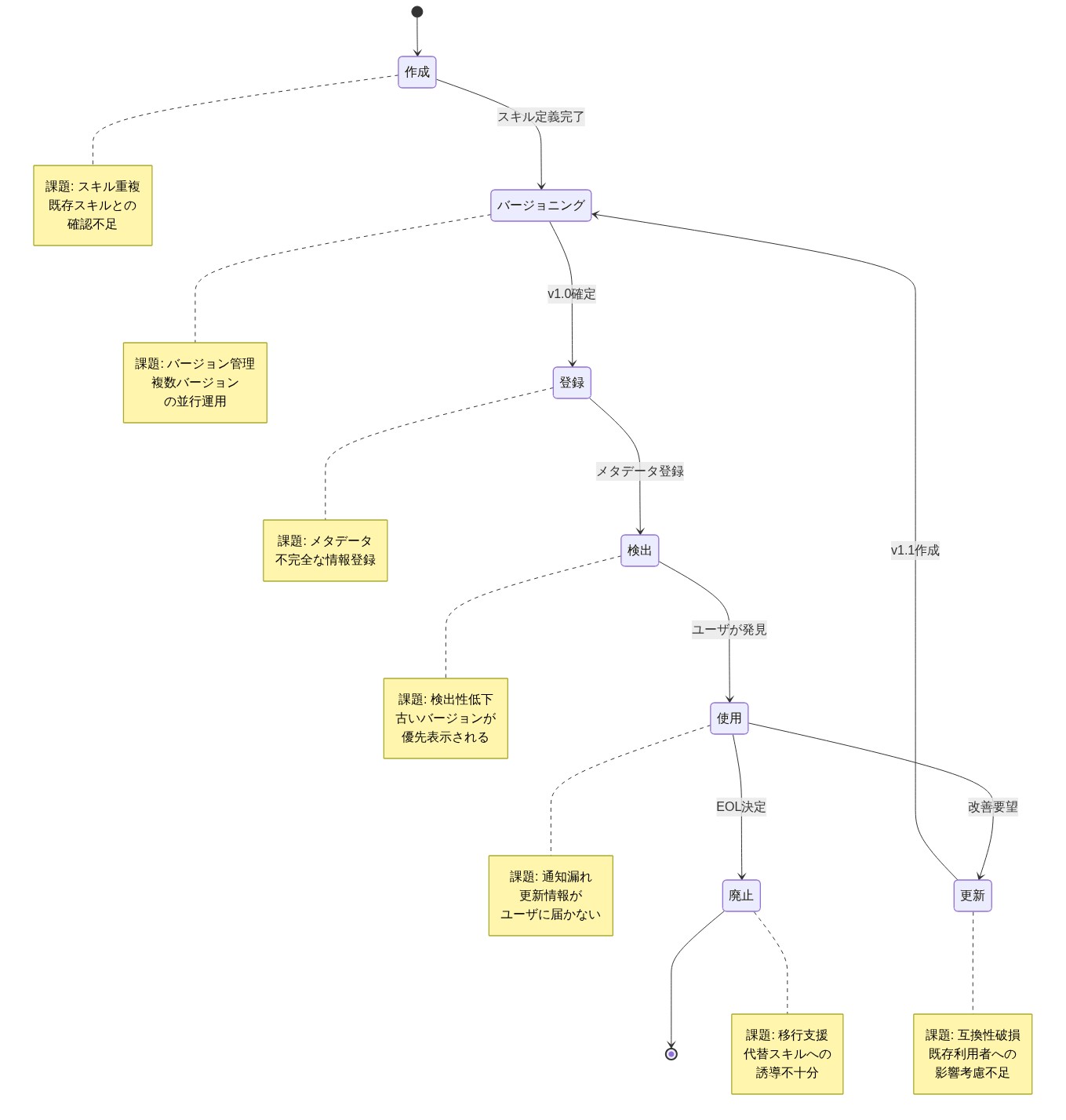

ガバナンスの課題: 発見、バージョン管理、一貫性

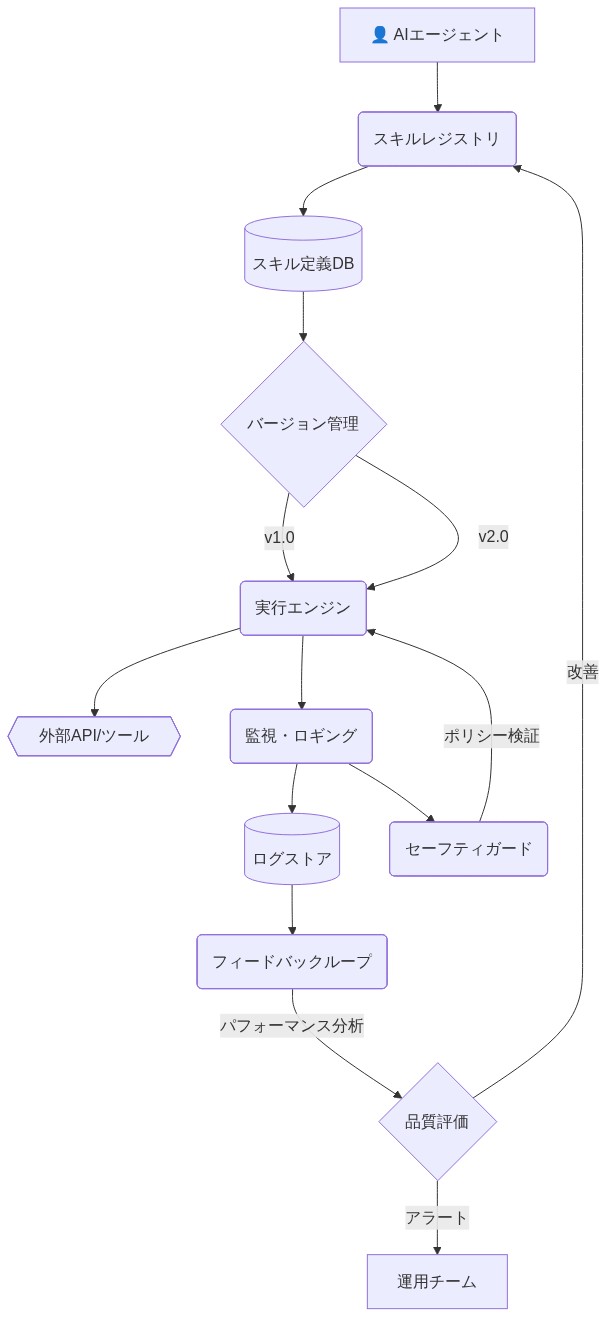

チームが複数の Agent Skills を蓄積するにつれて、課題は作成から管理へシフトします。現在のボトルネックは、スキルの発見、バージョン管理、分散チーム全体での一貫性の強制に集中しています。

明確な発見メカニズムがないと、開発者は努力を重複させたり、古いスキルを使用したりする可能性があります。スキルが進化する場合、バージョン管理が重要になります。チームはどのプロジェクトがどのスキルバージョンを使用しているかを知る必要があり、破壊的な変更を慎重に管理する必要があります。

-

例:* チームが 1 月に「secure-database-query」スキルを定義します。3 月までに、セキュリティ要件が厳しくなります。スキルは更新されますが、3 つのプロジェクトは依然として古いバージョンを参照しています。明示的なバージョン管理と通知システムがないと、コンプライアンスギャップが静かに発生します。

-

推奨アプローチ:* スキルレジストリをすぐに確立してください。すべてのアクティブなスキル、そのバージョン、所有権、最後の更新日を一覧表示する単純なドキュメントまたは内部パッケージリポジトリです。廃止ポリシーを実装してください。スキルはバージョン管理する必要があり、破壊的な変更には明示的な移行ステップが必要です。VS Code の設定を使用して、プロジェクトごとにスキルバージョンをピン留めし、予期しない動作の変更を防ぎます。

アーキテクチャの保護柵とセキュリティ

効果的な Agent Skills には、悪用を防ぎ、品質を維持し、セキュリティを確保するための明示的な保護柵が必要です。スキルには、入力検証、出力制約、監査証跡を含める必要があり、AI エージェントが有害または非準拠のアクションを実行するのを防ぎます。

自律型 AI エージェントは、ミスの影響を増幅します。設計が不十分なスキルは、広範なコード生成の欠陥、セキュリティ脆弱性、またはデータ露出を引き起こす可能性があります。保護柵は、スキルが安全な境界内で動作し、観察可能なままであることを保証します。

-

例:* 「generate-database-migration」スキルは、マイグレーションが指定されたスキーマのみを変更すること、ロールバック手順を含むこと、すべての実行詳細をログに記録することを検証する必要があります。これらの保護柵がないと、AI エージェントは関連のないテーブルをドロップしたり、機密データを露出させたりするマイグレーションを生成する可能性があります。

-

実装チェックリスト:* 新しいスキルごとに、以下を定義してください: (1) 入力制約 - どのパラメータが受け入れられ、どの範囲が有効か。(2) 出力検証 - 生成されたコードが実行前に満たす必要があるもの。(3) 監査要件 - どのイベントをログに記録する必要があるか。これらのパターンを強制するスキルテンプレートを使用してください。スキルを四半期ごとにレビューして、保護柵がセキュリティおよびコンプライアンス標準と一致していることを確認してください。

運用ライフサイクル: 定義、テスト、配布、監視、反復

成功した Agent Skills の採用は、構造化されたパターンに従います: 定義 → テスト → 配布 → 監視 → 反復。スキルは静的なアーティファクトではありません。組織的慣行が変わり、チームが何が機能するかを学ぶにつれて進化します。構造化されたライフサイクルは、スキルが技術的負債になるのを防ぎ、価値を保つことを保証します。

-

例:* チームが「code-review-checklist」スキルを定義します。初期テストでは、それが厳しすぎて有効なパターンを拒否していることが明らかになります。改善後、20 人の開発者に配布されます。2 週間後、チームはフィードバックを収集します。開発者は 15% 少ないレビューサイクルを報告しています。スキルは本番使用で発見されたエッジケースを処理するために更新されます。

-

プロセスフレームワーク:*

- サンドボックス環境でスキルをプロトタイプ化する

- パイロットグループ (5~10 人の開発者) でテストする (2~4 週間)

- 定量的フィードバック (時間節約、品質メトリクス) を収集する

- フィードバックに基づいて改善する

- より広いチームに明確なドキュメント付きでロールアウトする

各スキルに所有者を割り当て、監視と更新を担当させてください。VS Code テレメトリを使用して、スキルの採用と有効性を追跡してください。

影響の測定と投資の正当化

Agent Skills の影響を定量化することは、継続的な投資を正当化し、改善の機会を特定するために不可欠です。測定可能な成果には、コードレビューサイクルの削減、コンプライアンス違反の減少、新しい開発者のオンボーディング時間の短縮が含まれます。

測定がないと、実際の生産性向上と認識された改善を区別することは困難です。明確なメトリクスにより、どのスキルを拡張または廃止するかについてのデータ駆動型の決定が可能になります。

-

例:* 「security-best-practices」スキルを展開する前に、チームはベースラインコードレビュー時間を測定します (レビューあたり平均 45 分)。展開後、レビュー時間は 30 分に短縮されます。1 年間で、これはチーム全体で約 1,000 人の開発者時間を節約します。

-

測定フレームワーク:*

-

各スキルを展開する前に成功メトリクスを定義してください: タスクあたりの時間節約、欠陥削減、防止されたコンプライアンス違反、開発者満足度

-

スキル展開前の 2~4 週間のベースライン測定を収集してください

-

展開後 4~8 週間のメトリクスを追跡してください

-

このウィンドウ内でメトリクスが改善されない場合は、スキルが改善が必要かどうか、または採用の障害が存在するかどうかを調査してください

-

結果をチームと透過的に共有して、この機能への信頼を構築してください

リスクと軽減策

Agent Skills は、チームが予測して軽減する必要がある新しい障害モードを導入します。主なリスクには、スキルの幻覚 (AI エージェントがスキルの意図に違反するコードを生成する)、バージョンの断片化、自動化への過度な依存によるスキル萎縮が含まれます。

AI エージェントはスキル指示を誤解し、意図しない動作につながる可能性があります。バージョン規律がないと、チームは矛盾した慣行で動作する可能性があります。過度な自動化は、開発者がスキルが存在する理由について批判的に考えるのをやめた場合、チームの専門知識を損なう可能性があります。

-

例:* 「logging-best-practices」スキルが AI エージェントによって誤解され、パフォーマンスクリティカルなコードパスに過度なログを追加します。これはテストで問題が検出されるまでシステムパフォーマンスを低下させます。

-

軽減戦略:*

-

スキルテスト要件を実装してください。各スキルには正しい動作を検証するテストケースを含める必要があります

-

スキルが信頼できる場合でも、スキルを使用するすべての AI 生成コードのコードレビューを要求してください

-

スキルの使用を定期的に監査して、意図したとおりに適用されていることを確認してください

-

開発者がスキルの仕組みだけでなく、スキルが存在する理由を理解するようにチームトレーニングに投資してください

-

スキル廃止ポリシーを確立してください。6 か月間使用されていないスキルは、認知負荷を軽減するためにレビューされ、廃止される可能性があります

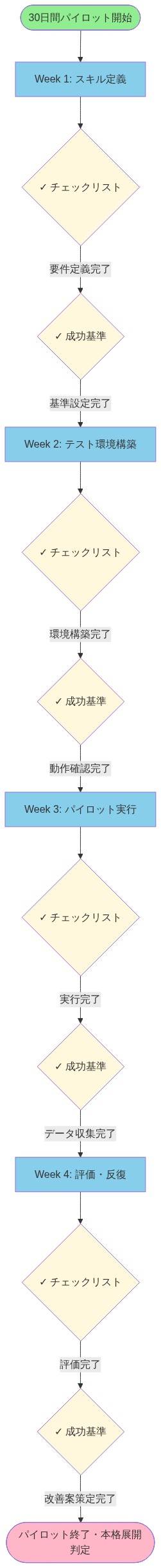

はじめ方: 30 日間のパイロット計画

Agent Skills は、AI 支援開発における意味のある進化を表しています。早期採用により、チームはこの機能の成熟を形作りながら、短期的な生産性向上をキャプチャできます。

- 即座のアクション:*

- スキルが反復的なコードレビューフィードバックまたは手続き要件を排除する 2~3 の高影響ワークフローを選択してください

- 明確な入力制約、出力検証、監査証跡を備えた対応するスキルを定義してください

- 小さなパイロットグループ (5~10 人の開発者) でテストしてください (2~4 週間)

- ベースラインメトリクスに対して成果を測定してください

- スキルガバナンスプロセスを確立してください: レジストリ、バージョン管理、所有権

- スキル採用を推進し、有効性を監視するチームメンバーを 1 人割り当ててください

- パイロット結果が投資を正当化する場合は、90 日以内に 5~10 のスキルに拡張する計画を立ててください

- 学んだ教訓を文書化し、組織全体で共有して、採用を加速させ、重複作業を防いでください

VS Code 1.108 の Agent Skills の実験的ステータスは、この機能を探索する低リスクの機会を提供します。今すぐ Agent Skills の理解と運用化に投資するチームは、この機能が成熟するにつれて、より高度な AI 自動化を活用するための良好な立場にあります。

定義と範囲

-

Agent Skills* は、AI エージェントが呼び出してドメイン固有のタスクを完了できる手続き指示を含む個別のバージョン管理されたモジュールとして定義されます。これらは、組織またはプロジェクト固有のパラメータ内で AI の動作を制約する実行可能な仕様として機能します。

-

前提:* Agent Skills は VS Code の拡張アーキテクチャ内で動作し、IDE を通じてアクセス可能な言語モデルと統合されます。実験的指定は、この機能が本番環境の安定性に達していないことを示しており、一般提供前に破壊的な変更が発生する可能性があります。

-

主張:* Agent Skills は、手続き的知識を再利用可能でバージョン管理されたモジュールにエンコードすることにより、汎用 AI 機能とドメイン固有の要件の間のギャップを軽減します。

-

支持する根拠:* 開発組織は制約の下で動作します。レガシーシステム統合パターン、規制遵守要件、内部アーキテクチャ標準などです。汎用 AI モデルはこれらを予測できません。Agent Skills により、チームは AI エージェントがコードを生成またはタスクを完了する際に従うステップバイステップの手順をエンコードできます。これにより、AI アシスタントが汎用ツールから、組織的慣行と一致するコンテキスト認識システムに変わります。

-

具体的な例:* 金融サービス組織は、すべての API 呼び出しに監査ログ、暗号化検証、コンプライアンスチェックを含める必要があることを指定するスキルを定義できます。AI エージェントが支払いモジュール用のコードを生成する場合、このスキルが自動的に適用され、手動のコンプライアンスレビューサイクルが削減されます。

-

有効性の前提条件:* スキルは、動作を意味のある方法で制約するのに十分に具体的である必要がありますが、複数のプロジェクト全体で適用するのに十分な一般性を持つ必要があります。過度に狭いスキルはメンテナンス負荷を作成します。過度に広いスキルは実行可能なガイダンスを提供できません。

構造要件とガバナンス

Agent Skills は、実装中に対処する必要があるガバナンスの課題を導入します。

-

主張:* 効果的な Agent Skills ガバナンスには、分散チーム全体での発見、バージョン管理、一貫性強制、ライフサイクル管理のための明示的なメカニズムが必要です。

-

支持する根拠:* 組織が複数のスキルを蓄積するにつれて、課題は作成からメンテナンスへシフトします。発見メカニズムがないと、開発者は努力を重複させたり、古いスキルを使用したりする可能性があります。スキルが進化する場合、バージョン管理が重要になります。組織は、どのプロジェクトがどのスキルバージョンを参照しているかを追跡し、破壊的な変更を体系的に管理する必要があります。

-

具体的な例:* 組織が 1 月に「secure-database-query」スキルを定義します。3 月までに、セキュリティ要件が変わります。スキルは更新されますが、3 つのプロジェクトは前のバージョンを参照し続けます。明示的なバージョン管理と通知システムがないと、コンプライアンスギャップが検出されないまま発生します。

-

前提条件:* スキルレジストリが存在する必要があります。すべてのアクティブなスキル、そのバージョン、所有権、最後の更新日、廃止ステータスを一覧表示する集中管理されたバージョン管理リポジトリです。このレジストリはクエリ可能で、プロジェクト構成管理に統合される必要があります。

-

実行可能な要件:* スキルバージョン管理ポリシーを確立してください。以下を指定します: (1) セマンティックバージョン管理スキーム (例: MAJOR.MINOR.PATCH)、(2) 破壊的な変更通知手順、(3) 各バージョンの最小サポート期間、(4) 廃止タイムライン。VS Code 構成ファイルを通じてプロジェクトレベルのスキルピン留めを実装して、意図しないバージョンアップグレードを防ぎます。

- 表1:Agent Skills構造要件と実装チェックリスト(出典:Enterprise Implementation Standards)*

セキュリティと品質の保護柵

Agent Skills には、意図しない動作を防ぎ、監査可能性を維持するための明示的な制約を含める必要があります。

-

主張:* スキルには、AI エージェントが有害、非準拠、または観察不可能なアクションを実行するのを防ぐために、入力検証、出力制約、包括的な監査証跡が必要です。

-

支持する根拠:* 自律型 AI エージェントは、手続き的エラーの影響を増幅します。設計が不十分なスキルは、広範なコード生成の欠陥、セキュリティ脆弱性、またはデータ露出を引き起こす可能性があります。保護柵は、スキルが定義された境界内で動作し、コンプライアンスおよびデバッグ目的で観察可能なままであることを保証します。

-

具体的な例:* 「generate-database-migration」スキルは、以下を強制する必要があります: (1) マイグレーションは指定されたスキーマのみを変更する、(2) ロールバック手順が含まれている、(3) すべての実行詳細がタイムスタンプとアクター識別でログに記録される、(4) 生成された SQL は実行前にスキーマホワイトリストに対して検証される。これらの保護柵がないと、AI エージェントは関連のないテーブルをドロップしたり、機密データを露出させたりするマイグレーションを生成する可能性があります。

-

前提条件:* 各スキルには、以下を定義する正式な仕様ドキュメントを含める必要があります: (1) 入力制約 (パラメータタイプ、有効範囲、必須フィールド)、(2) 出力検証ルール (生成されたアーティファクトが実行前に満たす必要があるもの)、(3) 監査要件 (ログに記録する必要があるイベント、保持期間)、(4) 障害モード (スキル拒否またはエスカレーションをトリガーする条件)。

-

実行可能な要件:* 保護柵パターンを強制するスキルテンプレートを開発してください。配布前にすべての新しいスキルのセキュリティレビューを要求してください。スキルの保護柵を四半期ごとに監査して、現在のセキュリティおよびコンプライアンス標準との一致を確認してください。定義された制約に違反するスキル出力を拒否するランタイム検証を実装してください。

実装ライフサイクル

Agent Skills の展開には、一貫性を確保し、技術的負債を防ぐための構造化された運用パターンが必要です。

-

主張:* 持続可能な Agent Skills の採用は、定義されたライフサイクルに従います: 仕様 → テスト → 配布 → 監視 → 反復。

-

支持する根拠:* スキルは静的なアーティファクトではありません。組織的慣行が変わり、チームが本番使用でエッジケースを発見するにつれて進化します。構造化されたライフサイクルは、スキルが保守されていない技術的負債になるのを防ぎ、組織のニーズと一致したままであることを保証します。

-

具体的な例:* 組織が「code-review-checklist」スキルを定義します。パイロットグループでの初期テストでは、有効なパターンを拒否し、摩擦を作成していることが明らかになります。パイロットフィードバックに基づいて改善した後、20 人の開発者に配布されます。2 週間の本番使用後、チームは定量的フィードバックを収集します。開発者は 15% 少ないレビューサイクルと 12% 高速なマージまでの時間を報告しています。スキルは本番使用中に発見されたエッジケースを処理するために更新されます。

-

前提条件:* スキルガバナンスプロセスが存在する必要があり、以下を指定します: (1) プロトタイプ環境要件、(2) パイロットグループサイズと期間 (推奨: 5~10 人の開発者、2~4 週間)、(3) フィードバック収集メカニズム、(4) より広いロールアウトの成功基準、(5) 継続的なメンテナンスの所有者割り当て。

-

実行可能な要件:* 正式なスキルライフサイクルプロセスを確立してください: (1) 分離されたサンドボックス環境でスキルをプロトタイプ化する、(2) 定義されたフィードバック収集 (定量的メトリクスと定性的フィードバック) でパイロットテストを実施する、(3) 時間節約、品質改善、採用の障害に関するデータを収集する、(4) パイロット結果に基づいて改善する、(5) より広いチームに明確なドキュメントとトレーニング付きでロールアウトする。各スキルに明示的な所有権を割り当て、メンテナンス責任と更新スケジュールを含めてください。VS Code テレメトリを使用して、スキル採用率、実行頻度、エラー率を追跡してください。

測定フレームワーク

Agent Skillsの影響を定量化することは、継続的な投資を正当化し、最適化の機会を特定するために不可欠です。

-

主張:* 測定可能な成果には、コードレビュー周期時間の短縮、コンプライアンス違反の減少、および開発者のオンボーディング加速が含まれます。

-

支持根拠:* 定量的な測定がなければ、実際の生産性向上と認識された改善を区別することは困難です。明確なメトリクスにより、スキル拡張、改善、または廃止に関するデータ駆動型の意思決定が可能になります。

-

具体例:* 「security-best-practices」スキルを展開する前に、組織はベースラインコードレビュー時間を測定します(平均:レビューあたり45分、n=100レビュー)。スキル展開と4週間の安定化期間後、レビュー時間は30分に短縮されます(平均、n=100レビュー)。1年間で、これはチーム全体で約1,000の開発者時間の節約に相当します。

-

前提条件:* 成功メトリクスはスキル展開前に定義する必要があります。ベースライン測定は、管理条件を確立するために展開前の2~4週間にわたって収集する必要があります。

-

実行可能な要件:* 各スキルについて、特定の成功メトリクスを定義します:(1)タスクあたりの時間節約(分/時間で測定)、(2)欠陥削減(欠陥の減少率で測定)、(3)防止されたコンプライアンス違反(カウントで測定)、(4)開発者満足度(1~5スケールのアンケートで測定)。スキル展開前の2~4週間のベースライン測定を収集します。展開後4~8週間のメトリクスを追跡します。このウィンドウ内でメトリクスが改善されない場合は、根本原因分析を実施して、スキルが改善を必要とするか、採用の障壁が存在するかを判断します。結果をチームと透過的に共有して、機能への信頼を構築し、継続的な投資を正当化します。

リスク評価と軽減

Agent Skillsは、組織が体系的に予測および軽減する必要がある障害モードを導入します。

-

主張:* 主なリスクには、AIエージェントによるスキルの誤解釈(スキルの意図に違反するコードの生成)、チーム間のバージョン分断、およびスキルの衰退(自動化への過度な依存がチームの専門知識を侵食)が含まれます。

-

支持根拠:* AIエージェントはスキル指示を誤解釈する可能性があり、意図しない動作につながります。バージョン規律がなければ、チームは一貫性のないプラクティスで動作する可能性があります。過度な自動化は、開発者がスキルの背後にある推論を理解することをやめた場合、批判的思考を侵食する可能性があります。

-

具体例:* 「logging-best-practices」スキルがAIエージェントによって誤解釈され、パフォーマンスクリティカルなコードパスに過度なログを追加します。これはテスト中に問題が検出されるまでシステムパフォーマンスを低下させ、ロールバックとスキル改善が必要になります。

-

前提条件:* リスク軽減には、明示的なテスト要件、コードレビューポリシー、およびスキル使用の定期的な監査が必要です。

-

実行可能な要件:* (1)スキルテスト要件を実装します。各スキルには、正しい動作と境界条件を検証するテストケースを含める必要があります。(2)信頼できるスキルであっても、スキルを使用するすべてのAI生成コードのコードレビューを要求して、誤解釈を検出します。(3)スキル監査スケジュールを確立します(最低四半期ごと)。スキルが意図したとおりに適用されていることを確認します。(4)チーム研修に投資して、開発者がスキルの背後にある推論を理解するようにします。単なるメカニクスではなく。(5)スキル廃止ポリシーを確立します。6か月間未使用のスキルは、認知負荷と保守負担を軽減するために、レビューされ、潜在的に廃止される必要があります。

移行と採用戦略

組織は、リスクを管理し、価値を検証するために、構造化されたフェーズを通じてAgent Skills採用にアプローチする必要があります。

-

実行可能な要件:* 30日間のパイロットフェーズを実施します:(1)測定可能な摩擦を持つ2~3の高影響ワークフローを選択します(例:コードレビュー周期、コンプライアンスチェック)、(2)明示的なガードレールとテストケースを備えた対応するスキルを定義します、(3)パイロットグループ(5~10人の開発者)でテストし、定量的フィードバックを収集します、(4)事前定義された成功基準に対して結果を測定します。スキルガバナンスプロセスを確立します。これには、一元化されたレジストリ、バージョン管理ポリシー、および所有権の割り当てが含まれます。スキルチャンピオンとして1人のチームメンバーを割り当てます。これは有効性の監視と更新の調整を担当します。パイロット結果が投資対効果の向上を示す場合、90日以内に5~10のスキルに拡張することを計画します。学習した教訓を文書化し、組織全体で共有して、採用を加速し、重複作業を防止します。

-

成功の前提条件:* 経営幹部のスポンサーシップとスキル開発およびガバナンスのためのリソースの明確な割り当てが必要です。組織的なコミットメントがなければ、スキル採用はアドホックなままで、一貫した価値を提供できません。

結論

VS Code 1.108のAgent Skillsは、AI支援開発ワークフローに手続き知識を組み込むための実験的機能を表しています。実験的ステータスは、早期採用と機能形成の低リスク機会を提供します。Agent Skillsのガバナンス要件の理解、構造化されたライフサイクルプロセスの実装、および測定フレームワークの確立に投資する組織は、機能が本番ステータスに向けて成熟するにつれて、より高度なAI自動化を活用する立場にあります。

システム構造とガバナンスのボトルネック

Agent SkillsはVS Codeの拡張アーキテクチャ内で動作し、言語モデルと開発ワークフローと統合されます。ただし、実験的実装は、スケーリング前に対処する必要がある重大なガバナンスの課題を露出させます。

-

主要なボトルネック:* 分散チーム全体でのスキル発見、バージョン管理、および一貫性の強制。チームが複数のスキルを蓄積するにつれて、課題は作成からガバナンスへシフトします。

-

これが重要な理由:* 明示的な発見メカニズムがなければ、開発者は努力を複製するか、古いスキルを使用します。スキルが進化するとバージョン管理が重要になります。チームはどのプロジェクトがどのスキルバージョンを使用しているかを知る必要があり、破壊的な変更を慎重に管理する必要があります。本番環境の単一の古いスキルは、コンプライアンスギャップまたはセキュリティ脆弱性を静かに再導入する可能性があります。

-

具体的な障害モード:* チームは1月に「secure-database-query」スキルを定義します。3月までに、セキュリティ要件が厳しくなり、スキルが更新されます。3つのプロジェクトは依然として古いバージョンを参照しています。明示的なバージョン管理と通知システムがなければ、コンプライアンス監査は数か月後にギャップを明らかにし、緊急の改善が必要になります。

-

これを防ぐための運用要件:*

-

スキルレジストリ(第1週): すべてのアクティブなスキル、それらのバージョン、所有権、最終更新日、および廃止タイムラインをリストする簡単なドキュメントまたは内部パッケージリポジトリを作成します。すべての開発者がアクセスできる共有場所(GitHubウィキ、Confluence、または内部パッケージマネージャー)を使用します。

-

バージョン管理ポリシー(第1週): セマンティックバージョニング(major.minor.patch)を実装します。メジャーバージョンの変更には、明示的な移行ステップとチーム通知が必要です。マイナー更新は下位互換性があります。パッチは透過的です。

-

プロジェクトレベルのピン留め(第2週): VS Codeの設定(

.vscode/settings.json)を使用して、プロジェクトごとにスキルバージョンをピン留めします。これにより、スキルがグローバルに更新されるときに予期しない動作の変更が防止されます。 -

廃止プロセス(第2週): 60日間の廃止ウィンドウを定義します。スキルが廃止対象としてマークされた場合、それを使用しているすべてのチームに通知し、移行ガイダンスを提供し、置換スキルの採用を追跡します。

- スキップされた場合のリスク:* この構造がなければ、スキルの拡散は2~3か月以内に管理不可能になります。スキルが予期しない動作の変更を起こすと、チームは自動化への信頼を失います。

参照アーキテクチャとセーフティガードレール

効果的なAgent Skillsには、誤用を防止し、品質を維持し、セキュリティを確保するための明示的なアーキテクチャガードレールが必要です。自律型AIエージェントは、誤りの影響を増幅します。設計の悪いスキルは、広範なコード生成の欠陥、セキュリティ脆弱性、またはデータ露出を引き起こす可能性があります。

-

主張:* スキルは、展開前に入力検証、出力制約、および監査証跡を含める必要があります。

-

根拠:* スキル指示を誤解釈するAIエージェントは、重大な損害を引き起こす可能性があります。ガードレールのない「generate-database-migration」スキルは、無関係なテーブルをドロップするか、機密データを露出させるマイグレーションを生成する可能性があります。出力検証のない「code-generation」スキルは、セキュリティチェックをバイパスするコードを生成する可能性があります。

-

各スキルの必須ガードレールコンポーネント:*

-

入力制約(コーディング前に定義):

- どのパラメータが受け入れられますか?(例:テーブル名、列タイプ)

- どの範囲が有効ですか?(例:最大文字列長、許可されたデータ型)

- どの値が明示的に禁止されていますか?(例:DROP TABLE、WHEREなしのDELETE)

- 例:「generate-query」スキルはSELECT、INSERT、UPDATEステートメントのみを受け入れます。DELETEとDROPはエラーメッセージで拒否されます。

-

出力検証(実行前に強制):

- 実行前に生成されたコードは何を満たす必要がありますか?(例:リンティングに合格、エラーハンドリングを含む、ハードコードされた認証情報を含まない)

- 生成されたコードで実行される自動チェックは何ですか?(例:静的分析、セキュリティスキャン、コンプライアンス検証)

- 展開前に手動レビューが必要なものは何ですか?(例:データベーススキーマの変更、API修正)

- 例:生成されたデータベースマイグレーションには、ロールバック手順を含める必要があり、ステージングデータベースに対してテストされ、マイグレーションファイル名にタイムスタンプを含める必要があります。

-

監査要件(すべてをログに記録):

- どのイベントをログに記録する必要がありますか?(スキル呼び出し、パラメータ、生成された出力、実行結果、エラー)

- 誰が監査ログにアクセスできますか?(セキュリティチーム、コンプライアンスチーム、スキル所有者)

- ログはどのくらいの期間保持されますか?(コンプライアンスクリティカルなスキルの場合、最低90日)

- 例:「compliance-check」スキルが実行されるたびに、開発者、タイムスタンプ、レビューされたコード、および検出されたコンプライアンス違反をログに記録します。

- 新しいスキルの実装テンプレート:*

スキル名:[名前]

所有者:[チーム/人]

目的:[1文の説明]

入力制約:

- 受け入れられるパラメータ:[リスト]

- 検証ルール:[リスト]

- 禁止値:[リスト]

出力検証:

- 自動チェック:[リスト]

- 手動レビューが必要:[はい/いいえ、および条件]

- ロールバック手順:[該当する場合]

監査証跡:

- ログに記録されるイベント:[リスト]

- 保持期間:[日数]

- アクセス制御:[誰が表示できるか]

テストケース:

- 有効な入力:[例]

- 無効な入力:[例]

- エッジケース:[例]-

運用アクション:* 30日以内にこのテンプレートに対してすべての既存スキルをレビューします。ガードレールが不足しているスキルは、継続的な使用前に改善のためにフラグが立てられます。新しいスキルは、このテンプレートを完成させずに展開することはできません。

-

スキップされた場合のリスク:* 単一の保護されていないスキルは、コンプライアンス違反、セキュリティ侵害、またはデータ損失を引き起こす可能性があります。改善のコスト(インシデント対応、監査、潜在的な罰金)は、事前にガードレールを実装する努力をはるかに超えています。

- 図6:Agent Skills参照アーキテクチャ - 統合ガバナンスシステム(出典:Enterprise Architecture Patterns)*

実装と運用ライフサイクル

Agent Skillsの展開には、一貫性、保守性、および測定可能な価値を確保するための構造化されたライフサイクルが必要です。スキルは静的なアーティファクトではありません。組織的なプラクティスが変わり、チームが何が機能するかを学ぶにつれて進化します。

-

主張:* 成功したAgent Skills採用は、パターンに従います:定義→テスト→配布→監視→反復。

-

フェーズ1:定義(第1週)*

-

ワークフローを特定します:どの反復的なタスクが摩擦またはコンプライアンスリスクを引き起こしますか?

-

手順を文書化します:ジュニア開発者に教えるかのようにステップバイステップの指示を書きます。

-

成功基準を定義します:「正しい」とはどのようなことですか?(例:コードがセキュリティスキャンに合格、レビュー時間が30%削減)

-

所有権を割り当てます:要件が変わるにつれてこのスキルを誰が保守しますか?

-

フェーズ2:テスト(第2~3週)*

-

サンドボックスでプロトタイプを作成します:本番環境ではなく、テスト環境でスキルを作成します。

-

パイロットグループでテストします:5~10人の開発者(スキルレベルの混合)を選択して、2~4週間スキルを使用します。

-

定量的フィードバックを収集します:節約された時間、導入された欠陥、開発者満足度を測定します。

-

エッジケースを特定します:スキルはどのシナリオで不十分に処理されましたか?

-

フェーズ3:配布(第4週)*

-

フィードバックに基づいて改善します:テスト中に発見されたエッジケースを処理するようにスキルを更新します。

-

使用法を文書化します:スキルを使用する時期、スキルが何をするか、何をしないかを説明する1ページのガイドを作成します。

-

より広いチームにロールアウトします:スキルが必要なすべての開発者がスキルを利用できるようにします。

-

トレーニングを提供します:スキルに不慣れなチームのための15分間のウォークスルー。

-

フェーズ4:監視(継続中、第5~12週)*

-

採用を追跡します:何人の開発者がスキルを使用していますか?どのくらいの頻度で?

-

結果を測定します:成功基準が満たされていますか?(節約された時間、欠陥削減、防止されたコンプライアンス違反)

-

フィードバックを収集します:開発者は問題に遭遇していますか?スキルをより有用にするには何が必要ですか?

-

問題にフラグを立てます:採用が低いか、結果が改善されていない場合は、障壁を調査します。

-

フェーズ5:反復(第8~12週以降)*

-

本番データに基づいて改善します:実際の使用パターンに対処するようにスキルを更新します。

-

必要に応じて廃止します:スキルが8週間後に価値を提供していない場合は、それを廃止し、リソースを再割り当てします。

-

成功した場合は拡張します:結果が強い場合は、関連するワークフローにスキルを拡張することを検討します。

-

具体例:* チームは「code-review-checklist」スキルを定義して、レビュー周期を短縮します。

-

第1週:チェックリストを文書化します(セキュリティチェック、パフォーマンスの考慮事項、コンプライアンスルール)。

-

第2~3週:8人の開発者とパイロット。フィードバック:スキルが厳しすぎて、有効なパターンを拒否しています。レビュー時間は20%削減されますが、開発者の不満は高いです。

-

第4週:スキルを改善して、文書化されたエッジケースの例外を許可します。40人の開発者にロールアウトします。

-

第5~8週:採用を監視します(コードレビューの85%がスキルを使用)。結果を測定します:レビュー時間は35%削減、コンプライアンス違反は60%削減。

-

第12週:スキルは成功しています。関連するワークフロー(プルリクエスト検証、展開チェックリスト)に拡張します。

-

運用要件:*

-

スキル所有権: スキルあたり1人を割り当てます。監視、更新、および問題への対応を担当します。この人は「スキルチャンピオン」です。

-

フィードバックループ: 週次30分間のシンクを確立します。スキルチャンピオンが使用メトリクスをレビューし、開発者からフィードバックを収集し、改善を特定します。

-

テレメトリ: VS Codeテレメトリを使用してスキル採用を追跡します(呼び出し回数、誰が、成功/失敗率)。分析のために週次でデータをエクスポートします。

-

ドキュメント: 各スキルのリビングドキュメントを保持します:スキルが何をするか、いつ使用するか、既知の制限、最近の変更、およびスキルチャンピオンの連絡先情報。

- スキップされた場合のリスク:* 構造化されたライフサイクルがなければ、スキルは技術的負債になります。スキルが保守されていない場合、チームは信頼を失い、採用が停滞し、機能は放棄されます。

測定フレームワークと成功指標

Agent Skillsの影響を定量化することは、継続的な投資を正当化し、改善の機会を特定するために不可欠です。測定がなければ、実際の生産性向上と認識された改善を区別することは困難です。

- 各スキルをデプロイする前にメトリクスを定義する:*

-

時間短縮(主要メトリクス)

- ベースライン:スキルデプロイ前のタスク期間を測定する(例:平均コードレビュー時間 = 45分)

- デプロイ後:スキルデプロイ後のタスク期間を測定する(例:平均コードレビュー時間 = 30分)

- 計算:(ベースライン – デプロイ後)× 頻度 × 時給 = 年間削減額

- 例:15分削減 × 週20回のレビュー × 年50週 × 時給$100 = 年間$150,000削減

-

品質メトリクス(二次メトリクス)

- 欠陥削減:AI生成コードによって導入されるバグの削減

- コンプライアンス違反:レビューで検出されるセキュリティまたは規制違反の削減

- 再作業サイクル:承認前のコードレビューラウンド数の削減

- 測定:スキルを使用した場合と使用しない場合で、生成されたコード1,000行あたりの欠陥/違反を追跡する

-

採用メトリクス(採用メトリクス)

- スキルを使用する適格開発者の割合

- 開発者あたり週あたりのスキル呼び出し頻度

- 目標:ロールアウト後4週間以内に80%の採用率

-

開発者満足度(定性的メトリクス)

- 開発者に調査する:「このスキルはあなたの仕事を簡単にしますか?」(1~5スケール)

- 目標:平均4以上の評価

- 測定プロセス:*

-

ベースライン(1~2週目): スキルデプロイ前の現在の状態を測定する。信頼できるベースラインを確立するために、少なくとも20個のデータポイントを収集する。

-

パイロット(3~6週目): スキルをパイロットグループにデプロイする。同じメトリクスを測定する。ベースラインと比較する。

-

ロールアウト(7週目): パイロット結果が肯定的な場合(時間短縮>20%、採用>70%、満足度>4)、より広いチームにロールアウトする。

-

本番環境(8~12週目): より広いチーム全体でアウトカムを測定する。このウィンドウ内でメトリクスが改善されない場合は、障害を調査するか、スキルを改善する。

-

具体例:* チームが「security-best-practices」スキルをデプロイする。

-

ベースライン(1~2週目):平均コードレビュー時間 = 45分。レビューあたりで検出されるセキュリティ違反 = 1.2件。現在のプロセスに対する開発者満足度 = 2.5/5。

-

パイロット(3~6週目):平均コードレビュー時間 = 30分(33%改善)。セキュリティ違反 = 0.3件(75%削減)。開発者満足度 = 4.2/5。

-

ロールアウト(7週目):結果がすべてのチームへのロールアウトを正当化する。

-

本番環境(8~12週目):改善が継続。年間削減額 = 1,000開発者時間 × 時給$100 = $100,000。

-

報告頻度:* 結果をスキルチャンピオンと週単位で共有し、より広いチームと月単位で共有し、リーダーシップと四半期単位で共有する。透明性は信頼を構築し、継続的な投資を正当化する。

-

スキップした場合のリスク:* 測定がなければ、スキルが価値を提供しているかどうかを知ることは不可能です。チームは効果のないスキルを使い続けたり、認識される影響の欠如のために効果的なスキルを放棄したりする可能性があります。

リスク評価と軽減戦略

Agent Skillsは、チームが積極的に予測して軽減する必要がある新しい障害モードをもたらします。

- 主要なリスク:*

-

スキルハルシネーション(AIエージェントがスキルの意図を誤解する)

- 障害モード:AIエージェントがスキルの意図に違反するコードを生成し、意図しない動作を引き起こす。

- 例:「logging-best-practices」スキルがAIエージェントによって誤解され、パフォーマンスクリティカルなコードパスに過度なログを追加し、システムパフォーマンスを低下させる。

- 軽減策:

- スキルテスト要件を実装する:各スキルは正しい動作を検証するテストケースを含める必要があります。

- スキルが信頼されている場合でも、スキルを使用するすべてのAI生成コードのコードレビューを要求する。

- スキル実行の異常を監視する(例:異常に長い実行時間、予期しない出力)。

- ハルシネーションが検出された場合、すぐにスキルを無効にし、根本原因を調査する。

-

バージョンの断片化(チームが一貫性のないプラクティスで運用する)

- 障害モード:バージョン規律がなければ、チームは一貫性のないプラクティスで運用し、コンプライアンスギャップやセキュリティ脆弱性を再導入する可能性があります。

- 例:チームが新しい規制に対応するために「compliance-check」スキルを更新する。3つのプロジェクトは依然として古いバージョンを使用しており、監査リスクを生じさせている。

- 軽減策:

- プロジェクトレベルで必須バージョンピニングを実装する(

.vscode/settings.json)。 - 廃止ポリシーを確立する:古いスキルバージョンは60日間サポートされ、その後削除される。

- バージョンアップグレード通知を自動化する:チームが使用しているスキルバージョンが廃止されたときにアラートする。

- 定期的にプロジェクトを監査して、現在のスキルバージョンを使用していることを確認する。

- プロジェクトレベルで必須バージョンピニングを実装する(

-

オートメーションへの過度な依存(スキル萎縮、専門知識の喪失)

- 障害モード:開発者がスキルが存在する理由について批判的に考えることをやめ、スキルが失敗したり予期しない結果を生成したりするときにブラインドスポットが生じる。

- 例:チームが6ヶ月間、自動化された「security-check」スキルに依存している。スキルがメンテナンスのために無効にされると、開発者はセキュリティチェックを手動で実行する方法を知らず、セキュリティレビューが遅延する。

- 軽減策:

- チームトレーニングに投資して、開発者がスキルの仕組みだけでなく、スキルが存在する理由を理解するようにする。

- スキル使用を定期的に監査して、意図したとおりに適用されていることを確認する(盲目的に信頼されていない)。

- スキル所有権をローテーションする:スキルチャンピオンに知識を文書化し、6ヶ月ごとに後継者を訓練することを要求する。

- 四半期ごとに「スキルなし」レビューを実施して、開発者がオートメーションなしでタスクを実行し、専門知識を維持する。

-

スキル増殖(管理不可能な数のスキル、認知負荷)

- 障害モード:チームが多くのスキルを蓄積し、開発者がどのスキルをいつ使用するかを知ることが困難になる。

- 例:チームが50個のスキルを持っている。開発者は特定のタスクに使用するスキルについて混乱しており、一貫性のない適用またはスキルが無視される。

- 軽減策:

- スキル廃止ポリシーを確立する:6ヶ月間未使用のスキルはレビューされ、潜在的に廃止される。

- アクティブなスキルの数をチームあたり10~15に制限する。さらに必要な場合は、関連するスキルを統合する。

- スキル発見インターフェース(例:スキル説明付きのVS Codeコマンドパレット)を作成して、開発者が正しいスキルを見つけるのを支援する。

- 四半期ごとにスキル監査を実施して、重複または重複するスキルを特定する。

-

スキルのセキュリティ脆弱性(悪意のあるまたは設計が不十分なスキル)

- 障害モード

パラダイムシフト:汎用ツールから組織的インテリジェンスへ

-

主張:* Agent Skillsは、AIをステートレスツールから、組織的記憶とプラクティスのステートフル、学習可能な拡張機能に変換します。

-

根拠:* 数十年間、ソフトウェア開発は専門知識をエンコードするための2つのメカニズムに依存してきました:(1)ドキュメンテーションと(2)コードレビュー。どちらも損失的で、非同期的で、人間の注意に依存しています。Agent Skillsは第3のメカニズムをもたらします:実行可能な組織的知識—AIエージェントが呼び出し、学習し、リアルタイムで改善できるプロシージャ。

現在の状態を考えてみてください:開発者が金融サービス企業に参加します。彼らは50ページのコンプライアンスマニュアルを受け取ります。彼らはコードを書きます。レビュアーは3つのコンプライアンス違反を検出します。開発者は学習します。6ヶ月後、新しい開発者がサイクルを繰り返します。これは摩擦を通じた組織的知識の転送です。

Agent Skillsを使用すると、そのコンプライアンス知識はスキルにエンコードされます。AIエージェントが支払い処理のコードを生成するたびに、スキルが自動的に適用されます。コンプライアンス違反はほぼゼロに低下します。オンボーディング時間は短縮されます。組織の苦労して得た専門知識は環境的になります—AIが行うすべての決定に存在します。

-

具体的なシナリオ:* ヘルスケアソフトウェアチームが、規制学習の年を含む「HIPAA-compliant-data-handling」スキルを定義します。AIエージェントが患者データ処理のコードを生成するとき、スキルは暗号化、監査ログ、アクセス制御、およびデータ保持ポリシーが適用されることを自動的に確保します。チームの集合的な専門知識は、新入社員や契約者を含むすべての開発者のための力の乗数になります。

-

実行可能な含意:* 組織の最も価値があるが最も文書化されていない知識を監査する。コードレビューが一貫して同じ間違いを検出する場所はどこですか?オンボーディング会話が繰り返し同じ内容をカバーする場所はどこですか?コンプライアンスまたはセキュリティの問題が予測可能に出現する場所はどこですか?これらはAgent Skillsの最も高いROI候補です。2~3人のシニアエキスパートが現在保有している知識をエンコードするスキルを優先します—これらは組織的スケーリングの最大のレバレッジを表しています。

ガバナンスの課題:混乱なしに知識をスケーリングする

VS Code 1.108でのAgent Skillsの実験的ステータスは制限ではなく、ガバナンスパターンを確立する機会です。それらが根付いた悪いプラクティスになる前に。

-

主張:* Agent Skills採用の主要なボトルネックは技術的能力ではなく、組織的ガバナンス—具体的には、スキル発見、バージョニング、一貫性の強制、およびスキルドリフトの防止です。

-

根拠:* 組織がAgent Skillsを蓄積するにつれて、彼らは新しい形式の技術的負債に直面します:スキル断片化。意図的なガバナンスがなければ、チームは重複するスキルを作成し、古いバージョンを使用し、一貫性のないプラクティスで運用します。AIエージェント自体は組織的不一貫性のベクトルになります。

シナリオを想像してください:チームAが「database-query-optimization」スキルを作成します。チームB、気づかずに、異なるパフォーマンス仮定を持つほぼ同一のスキルを作成します。チームCはチームAのスキルを使用しますが、パフォーマンス要件が変わるときに更新することはありません。6ヶ月以内に、組織は本番環境で同じスキルの3つのバージョンを持っており、それぞれ異なる動作をしています。デバッグは悪夢になります。コンプライアンス監査は不一貫性を明らかにします。

-

具体例:* 大規模なテック企業が5つのチーム全体で40個のAgent Skillsを定義します。中央レジストリがなければ、開発者はどのスキルが存在するかを知りません。チームAが「API-error-handling」スキルを作成します。3ヶ月後、チームBはわずかに異なる再試行ロジックを持つほぼ同一のスキルを作成します。年末までに、会社は12個の重複するスキルを持っており、それぞれ異なるプロジェクトで異なるバージョンを持っています。エラーハンドリングのセキュリティ脆弱性が発見されると、セキュリティチームはすべての12個のバリアントにパッチを適用する必要があります—数週間かかるプロセスであり、ギャップを残します。

-

実行可能な含意:* スケールでAgent Skillsをデプロイする前に、スキルガバナンスカウンシルを確立する。このカウンシルは:(1)明確な所有権、バージョン履歴、および廃止ステータスを持つ中央スキルレジストリを維持する;(2)重複を防ぐための発見チェックを含むスキル作成プロセスを定義する;(3)バージョニング標準(セマンティックバージョニング、破壊的変更ポリシー)を確立する;(4)スキルライフサイクルを実装する:プロトタイプ → パイロット → 本番環境 → メンテナンス → 廃止;(5)四半期ごとにスキル監査を実施して、未使用または冗長なスキルを特定する;(6)セキュリティ、コンプライアンス、および品質標準を開始から強制するスキルテンプレートライブラリを作成する。

カウンシルは大きくある必要はありません—3~5人のシニアエンジニア、1人のアーキテクト、および1人のコンプライアンス代表者の回転グループは、数十のスキルを管理できます。重要なのは、組織的負債が蓄積する前に確立された意図的な構造です。

アーキテクチャガードレール:自律的障害モードの防止

Agent Skillsは新しいクラスのリスクをもたらします:自律的障害増幅。単一の設計が不十分なスキルは、AIエージェントが一貫してスケールで適用するため、広範で迅速な損害を引き起こす可能性があります。

-

主張:* 効果的なAgent Skillsには、明示的なアーキテクチャガードレールが必要です:入力検証、出力制約、実行サンドボックス、および包括的な監査証跡。これらがなければ、Agent Skillsはシステム的障害のベクトルになります。

-

根拠:* 従来のコードレビューは、間違いが伝播する前にそれをキャッチします。自律的なAIエージェントでは、間違いが最初に伝播し、その後キャッチされます(もしあれば)。ガードレールは検出から防止へモデルをシフトします。

「generate-database-migration」スキルを考えてみてください。ガードレールがなければ、AIエージェントは:(1)無関係なテーブルを削除するマイグレーションを生成する、(2)ロールバック手順を含めない、(3)ステージングの代わりに本番データベースに対して実行する、(4)何が変更されたか、なぜかの監査証跡を残さない可能性があります。

ガードレールを使用すると、スキルは以下を強制します:(1)スキーマ検証—マイグレーションは指定されたテーブルのみを変更できます;(2)ロールバック要件—すべてのマイグレーションは対応するロールバック手順を含める必要があります;(3)環境ゲーティング—本番環境へのマイグレーションは明示的な承認が必要であり、メンテナンスウィンドウ中にのみ実行できます;(4)包括的なログ—すべてのマイグレーション実行はタイムスタンプ、ユーザー、加えられた変更、およびロールバックステータスでログされます。

- 具体例:* 金融サービス企業が「payment-processing-code-generation」スキルを実装します。ガードレールには以下が含まれます:(1)入力検証—指定された支払い方法と通貨のみがサポートされます;(2)出力制約—生成されたコードはべき等性チェック、タイムアウト処理、および再試行ロジックを含める必要があります;(3)実行サンドボックス—生成されたコードはテスト環境で最初に実行され、本番環境デプロイ前に結果がレビューされます;(4)監査証跡—すべてのコード生成イベントはAIモデルバージョン、スキルバージョン、入力パラメータ、および生成された出力でログされます。

本番環境での6ヶ月後、AIモデルのバグにより、不正な丸め処理ロジックを持つ支払いコードが生成されます。ガードレールはこれをキャッチします:(1)出力検証は丸め処理が予期される精度と一致しないことを検出します;(2)コードは本番環境からブロックされます;(3)監査証跡はバグが導入された正確な時期と、テストで影響を受けた支払いを示します。チームはスキルバージョンをすばやくロールバックし、調査できます。

- 実行可能な含意:* 新しいAgent Skillごとに、以下を含むガードレール仕様を定義する:(1)入力制約—どのパラメータが受け入れられるか、どの範囲が有効か、どの組み合わせが禁止されているか;(2)出力検証—生成されたコードが満たす必要があるプロパティ(パフォーマンス、セキュリティ、コンプライアンス);(3)実行制約—スキルをどこで実行できるか(開発、ステージング、本番環境)、誰がそれを呼び出せるか、どの承認が必要か;(4)監査要件—どのイベントをログする必要があるか、どのメタデータをキャプチャする必要があるか、ログをどのくらい保持する必要があるか;(5)ロールバック手順—スキルを以前のバージョンに戻す方法、影響を受けたコードを特定する方法、修復する方法。

これらのパターンを強制するスキルテンプレートを使用する。本番環境デプロイ前にすべての新しいスキルのセキュリティおよびコンプライアンスレビューを要求する。ガードレールが正しく機能していることを検証する自動テストを実装する。四半期ごとにガードレール違反を監査して、改善または廃止が必要なスキルを特定する。

運用パターン:プロトタイプから本番運用へ、そして継続的な進化へ

Agent Skillsの導入を成功させるには、スキルを静的なツールではなく、生きた成果物として扱う明確な運用パターンが必要です。

-

主張:* Agent Skillsは継続的なライフサイクルに従います:プロトタイプ → パイロット → 本番運用 → 監視 → 反復。このパターンを早期に確立する組織は、より迅速に価値を獲得し、スキルの陳腐化を回避できます。

-

根拠:* スキルはデプロイされた時点で「完成」ではありません。組織の慣行が変わるにつれて、AIモデルが改善されるにつれて、本番運用で予期しないケースが出現するにつれて、またチームのフィードバックが蓄積するにつれて進化します。構造化されたライフサイクルがなければ、スキルは陳腐化し、一貫性なく適用されるか、放棄されてしまいます。

-

具体的なシナリオ:* あるチームが、最も一般的なレビューフィードバックに基づいて「code-review-checklist」スキルを定義します。初期テストにより、それが厳しすぎることが判明し、経験豊富な開発者が安全と認識する有効なパターンを拒否しています。スキルは、これらのパターンの例外を含めるように改善されます。10人の開発者のパイロットグループに2週間デプロイされます。フィードバック:開発者はレビューサイクルが20%減少したと報告していますが、スキルは時々エッジケースを見落とします。スキルはこれらのケースに対応するように更新されます。パイロット4週間後、50人の開発者にロールアウトされます。本番運用2ヶ月後、使用データはスキルがコードレビューの60%に適用されており、レビュー時間が45分から30分に短縮されたことを示しています。チームはスキルに追加すべき3つの新しいパターンを特定します。これらは初期デプロイから2ヶ月後にリリースされたバージョン1.1に組み込まれます。

-

実行可能な含意:* 明確なゲートとメトリクスを備えたスキルライフサイクルプロセスを確立します:

-

プロトタイプ(1~2週間): 組織の課題に基づいてスキルを定義します。スキルが意図したとおりに機能することを検証するテストケースを作成します。本番への影響がないサンドボックス環境でテストします。

-

パイロット(2~4週間): フィードバックを提供することに同意した小規模グループ(5~10人の開発者)にデプロイします。定量的メトリクス(時間節約、欠陥削減、採用率)と定性的フィードバック(何が機能しているか、何が不満か)を収集します。比較を可能にするため、パイロット前にベースラインメトリクスを測定します。

-

本番運用(継続的): より広いチームにロールアウトし、明確なドキュメント、トレーニング、サポートを提供します。監視と更新を担当する所有者を割り当てます。VS Codeテレメトリを使用して、採用と有効性を追跡します。

-

監視(継続的): 主要メトリクスを追跡します:採用率、タスクあたりの時間節約、欠陥削減、防止されたコンプライアンス違反、開発者満足度。異常(採用率の急激な低下、エラーの増加)についてアラートを設定します。

-

反復(四半期ごと): メトリクスとフィードバックを確認します。組み込むべき改善、エッジケース、または新しいパターンを特定します。明確な変更ノート付きで更新をリリースします。未使用または廃止されたスキルを廃止します。

所有権を割り当てます:各スキルには、そのライフサイクルを担当する明確な所有者(通常はシニアエンジニア)が必要です。スキルレビューの頻度を作成します:アクティブなスキルは月次、すべてのスキルは四半期ごと。この頻度を使用して、更新、改善、または廃止が必要なスキルを特定します。

測定と価値実現:見えないものを見えるようにする

測定がなければ、Agent Skillsは興味深い実験のままであり、戦略的能力にはなりません。

-

主張:* Agent Skillsからの測定可能な成果には、以下が含まれます:(1)コードレビューサイクル時間の短縮、(2)コンプライアンスおよびセキュリティ違反の削減、(3)新規開発者のオンボーディング時間の短縮、(4)コード一貫性の向上、(5)反復的なタスクに費やす時間の削減。

-

根拠:* これらの成果は理論的ではなく、組織の知識を実行可能な形式にエンコードすることから直接生じます。重要なのは、それらを厳密に測定して、実際の利益を認識から区別することです。

-

具体的な例:* 金融サービスチームが「secure-API-design」スキルを実装します。ベースライン測定(デプロイ前2週間):APIコードの平均コードレビュー時間は60分。コンプライアンス違反はレビューの15%で検出されます。新規開発者のオンボーディング時間には、APIセキュリティトレーニングの8時間が含まれます。

スキルをデプロイした後(4週間にわたって測定):平均コードレビュー時間は40分に低下。コンプライアンス違反はレビューの2%に低下。新規開発者のオンボーディング時間は4時間に低下します(スキルはセキュリティトレーニングの大部分を暗黙的に処理します)。

1年間で、50人の開発者と500件のAPIコードレビューを使用:時間節約 = (60 - 40)分 × 500レビュー = 10,000分 = 167開発者時間。防止されたコンプライアンス違反 = 13% × 500 = 65違反。オンボーディング時間節約 = 4時間 × 10人の新規開発者 = 40時間。

- 実行可能な含意:* 各Agent Skillについて、デプロイ前に成功メトリクスを定義します:

-

効率メトリクス: タスクあたりの時間節約、開発者あたり週間完了タスク数、サイクル時間削減。

-

品質メトリクス: 欠陥削減、防止されたコンプライアンス違反、開発サイクルの早期に検出されたセキュリティ問題。

-

採用メトリクス: スキルを使用している開発者の割合、使用頻度、スキルバージョン分布。

-

満足度メトリクス: 開発者フィードバック、認識される価値、スキル使用の意思。

スキルデプロイ前2~4週間のベースライン測定を収集します。デプロイ後4~8週間のメトリクスを追跡します。このウィンドウ内でメトリクスが改善されない場合は、調査します:スキルは改善が必要ですか?採用の障壁がありますか(不明確なドキュメント、使いにくい)?スキルは実際には存在しない問題を解決していますか?

チームと結果を透過的に共有します。勝利を公開で祝います。データを使用してAgent Skillsへの継続的な投資を正当化し、どのスキルを拡張または廃止すべきかを特定します。

リスク軽減:障害モードの予測と防止

Agent Skillsは、組織が積極的に予測して軽減する必要がある新しい障害モードを導入します。

-

主張:* 主なリスクには、以下が含まれます:(1)スキルハルシネーション(AIエージェントがスキル意図を誤解釈)、(2)バージョン断片化(プロジェクト全体で一貫性のないスキルバージョン)、(3)オートメーションへの過度な依存(スキル萎縮—開発者が批判的思考を停止)、(4)スキルのセキュリティ脆弱性、(5)コンプライアンスドリフト(スキルが規制要件と不一致になる)。

-

根拠:* 各リスクは、システム的障害の潜在的な原因を表しています。軽減には、意図的なアーキテクチャと組織的な選択が必要です。

-

具体的なシナリオ:*

-

スキルハルシネーション: 「logging-best-practices」スキルがAIエージェントによって誤解釈され、パフォーマンスクリティカルなコードパスに過度なログを追加します。本番監視で問題が検出されるまで、システムパフォーマンスが低下します。

-

バージョン断片化: 3つのプロジェクトが「database-query-optimization」スキルの異なるバージョンを使用しています。セキュリティ脆弱性が発見されると、チームはすべての3つのバージョンにパッチを適用し、プロジェクト全体で更新を調整する必要があります。

-

オートメーションへの過度な依存: 開発者は、信頼されたスキルを使用するAI生成コードのレビューを停止します。スキルの微妙なバグにより、広範な欠陥が発生し、検出されないまま伝播します。

-

セキュリティ脆弱性: 「API-authentication」スキルは、トークン再利用を許可する微妙な欠陥で実装されています。欠陥はスキルを使用して生成されたすべてのコードに伝播します。

-

コンプライアンスドリフト: 「GDPR-data-handling」スキルが現在の規制に基づいて作成されます。6ヶ月後、規制が変わります。スキルは更新されません。スキルを使用して生成された新しいコードは非準拠になります。

-

実行可能な含意:* 包括的なリスク軽減戦略を実装します:

-

スキルテスト要件: 各スキルには、正しい動作を検証する自動テストケースが含まれている必要があります。テストは、通常のケース、エッジケース、および障害モードをカバーする必要があります。スキルデプロイ前および各更新前にテストが成功することを要求します。

-

コードレビュー規律: スキルが信頼されている場合でも、スキルを使用するすべてのAI生成コードのコードレビューを要求します。レビュアーはスキルの意図を理解し、生成されたコードがそれと一致していることを検証する必要があります。これにより、スキルハルシネーションが検出されないまま伝播するのを防ぎます。

-

スキル監査: スキル使用を定期的に監査して、スキルが意図したとおりに適用されていることを確認します。各スキルを使用して生成されたコードの10~20%をサンプリングします。誤用または意図しない動作のパターンを探します。

-

チームトレーニング: 開発者がスキルのメカニクスだけでなく、スキルの背後にある推論を理解するようにトレーニングに投資します。これにより、オートメーションへの過度な依存を防ぎ、開発者がスキル障害を検出できるようになります。

-

セキュリティおよびコンプライアンスレビュー: すべての新しいスキルおよび既存スキルの更新に対して、セキュリティおよびコンプライアンスレビューを要求します。コンプライアンスドリフトを特定して修復するためのプロセスを確立します(例:現在の規制に対するスキルの四半期ごとのレビュー)。

-

廃止ポリシー: スキルの明確な廃止ポリシーを確立します。6ヶ月間未使用のスキルはレビューされ、潜在的に廃止される必要があります。スキルへの破壊的な変更は、影響を受けるプロジェクトの明示的な移行ステップをトリガーする必要があります。廃止を明確に伝達し、移行サポートを提供します。

-

インシデント対応: スキル障害に対応するためのプロセスを確立します。スキルが広範な欠陥またはコンプライアンス違反を引き起こす場合、チームは影響を受けたコードを迅速に特定し、スキルをロールバックし、修復できる必要があります。スキルインシデントのログを保持して、パターンを特定し、再発を防ぎます。

地平線:スキルから適応型組織インテリジェンスへ

VS Code 1.108のAgent Skillsは、より大きなビジョンの基礎を表しています:AIエージェントが汎用ツールではなく、組織インテリジェンスの適応型拡張である組織。

-

主張:* 18~24ヶ月以内に、Agent Skillsは手動の静的手順から、組織フィードバックと成果に基づいて時間とともに改善する適応型で学習可能なシステムに進化します。

-

根拠:* 現在の実装では、人間がスキルを明示的に定義する必要があります。次の進化には、組織の慣行から学習し、パターンを特定し、新しいスキルまたはスキル改善を提案するAIシステムが含まれます。これにより、フィードバックループが作成されます:人間が初期スキルを定義 → AIエージェントがスキルを適用してデータを生成 → AIシステムがデータを分析して改善を提案 → 人間が改善を検証して組み込む → サイクルが繰り返される。

-

具体的なビジョン:* AIシステムがコード生成、コードレビュー、コンプライアンス成果を継続的に監視する組織を想像してください。パターンを特定します:「現在の『error-handling』スキルを使用している開発者は、別のバージョンを使用している開発者よりも本番インシデントが15%多く経験しています

- 図2:Agent Skillsのアーキテクチャ - 汎用AIに組織固有の手順を統合し金融サービスのコンプライアンス要件に対応*

- 図4:Agent Skillsのライフサイクル管理フロー(Software Versioning and Governance Patterns)*

- 図10:30日間パイロットプラン - 実装タイムライン(Agile Implementation Methodology)*