エージェント型AIが仕事の満足度を向上させる一方、ツール増加が複雑性を増す

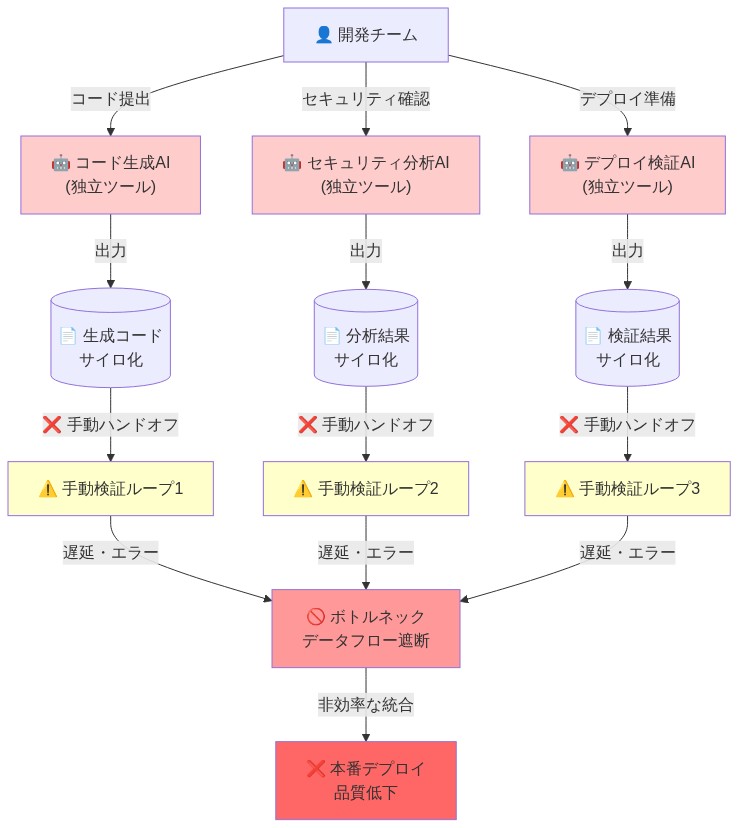

システム構造とボトルネック

現在のDevSecOpsワークフローは、ツールサイロによって特徴づけられている。AIエージェントが統一されたコンテキストにアクセスできない状態だ。コード生成、セキュリティ分析、デプロイメント検証に別々のAIアシスタントを使用する開発者は、連続性を失う。各ツールは不完全な情報で動作し、手動のハンドオフと検証ループを強制される。生産性向上の利益は相殺される。

エージェント型システムの力は、状態への継続的なアクセスから生まれる。コードリポジトリ、セキュリティポリシー、インフラストラクチャ定義、インシデント履歴。ツールがコンテキストを共有できないとき、エージェントは状態を持たないアシスタントに退行する。繰り返される人間の入力が必要になり、その価値は減少する。

-

具体例:* あるチームがコードレビュー自動化を実装した。AIエージェントは、別のコンプライアンスツールに保存された組織のセキュリティポリシーへのアクセス権を持たない。エージェントは内部基準に違反するコードを承認してしまう。結局、手動レビューが必要になる。ツールは力の増幅ではなく、偽陽性の生成器と化す。

-

対策:* 現在のツールエコシステムをマッピングし、どのデータフローがシステム間で流れ、どれが手動で橋渡しされているかを特定する。責任が重複するツールの統合を優先する。エージェントがポリシー、コード、インフラストラクチャの状態を人間の仲介なしにクエリできる中央イベントバスまたはAPIレイヤーを確立する。これは認知負荷を減らし、エージェントの自律性を高める。

- 図2:現在のツールサイロ構造とデータフロー遮断のボトルネック*

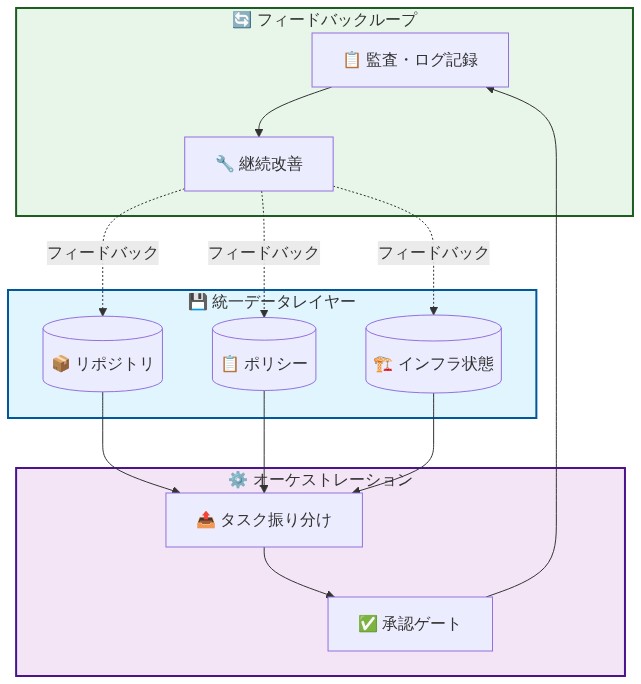

参照アーキテクチャとガードレール

効果的なエージェント型AI導入には、三層アーキテクチャが必要だ。統一されたデータレイヤーがエージェントに真実の正規ソース(リポジトリ、ポリシー、インフラストラクチャ状態)へのアクセスを提供する。オーケストレーションレイヤーが特化したエージェントにタスクをルーティングし、承認ゲートを実施する。フィードバックループがエージェントの決定を捕捉し、監査と継続的改善に活用する。

ガードレールはエージェントが人間の監視なしに取り返しのつかない決定を下すことを防ぎ、コンプライアンスと追跡可能性を確保する。規制環境では極めて重要だ。

-

具体例:* セキュリティチームがインフラストラクチャの設定ミスを自動修復するエージェントを実装した。ガードレールがなければ、エージェントはセキュリティグループを無効化したり、認証情報を不安全にローテーションしたりする可能性がある。ガードレール—高リスク変更に人間の承認を要求し、すべての決定をログに記録し、異常検知で自動ロールバック—があれば、エージェントは日常的な修正の80%を自律的に処理し、エッジケースをエスカレートする。

-

対策:* 各エージェントの決定境界を定義し、アクション分類する。自律的(日常的、低リスク、容易に取り消し可能)、ゲート付き(人間の承認が必要)、禁止(人間のみ)。すべてのエージェント決定に対して監査ログを実装する。段階的なロールアウトと迅速なロールバックのためにフィーチャーフラグを使用する。本番環境へのデプロイ前に、ステージング環境で合成データを使用してエージェントをテストする。

- 図3:エージェント型AI導入の推奨3層アーキテクチャ(Reference Architecture and Guardrails)*

実装と運用パターン

エージェント型AIで成功するチームは、測定可能な成果に結びついた段階的ロールアウトを採用する。高ボリューム、低リスクのタスク—コードリンティング、ドキュメント生成、ログ分析—から始める。組織の信頼を構築し、パフォーマンスベースラインを確立する。信頼性を実証し、明確なエスカレーションパスを確立した後にのみ、より高いステークスのドメインに拡張する。

エージェント型システムは確率的であり、予期しない方法で失敗する。段階的採用により、チームは失敗モードを学習し、エージェント自律性を拡張する前にガードレールを改善できる。

-

具体例:* DevOpsチームは、エージェントにインフラストラクチャ最適化を提案させることから始める。実装はしない。3ヶ月間、95%の精度を達成した後、低コスト変更の自動実装を許可する。6ヶ月後、セキュリティ関連の変更に拡張し、必須の承認ゲートを設ける。この段階的進行は信頼を構築し、デプロイメントリスクを低減する。

-

対策:* 組織内のエージェント自律性に関する成熟度モデルを作成する。各レベルの入場基準—精度閾値、テスト要件—を定義する。エージェントパフォーマンス監視の明確な所有権を割り当てる。四半期ごとのレビューをスケジュール。エージェントがSLOを満たしているか、新しいユースケースが自動化の準備ができているかを評価する。

測定と成果

組織は生産性メトリクス(節約時間、スループット)と品質メトリクス(エラー率、偽陽性、コンプライアンス違反)の両方を追跡する必要がある。満足度調査は、AIツール自体への満足度と全体的なワークフローへの満足度を区別すべき。ツールが優れていても、パイプラインとの統合が不十分であれば、エンジニアは不満を感じる。

生産性向上が信頼性またはコンプライアンスを損なえば、それは無意味だ。測定はAI採用がテクノロジー採用のためのテクノロジー採用ではなく、ビジネス目標に奉仕することを確保する。

-

具体例:* あるチームは、AIコードレビューエージェントが週10時間を節約するが、セキュリティ問題に対して2%の偽陰性率を導入することを測定した。エージェントの感度を再調整し、偽陰性を0.1%に削減しながら、わずかに高い偽陽性を受け入れる(開発者は迅速に却下する)。純粋な結果:週8時間の節約、許容可能な品質トレードオフ。

-

対策:* エージェントパフォーマンス、チーム満足度、ビジネス成果を追跡するメトリクスダッシュボードを確立する。週単位でレビュー。精度、レイテンシ、ユーザー採用の明確なターゲットを設定する。チームが失敗を報告し、改善を提案するためのフィードバックチャネルを作成する。このデータを使用して継続的投資を正当化し、新機能の優先順位付けを指導する。

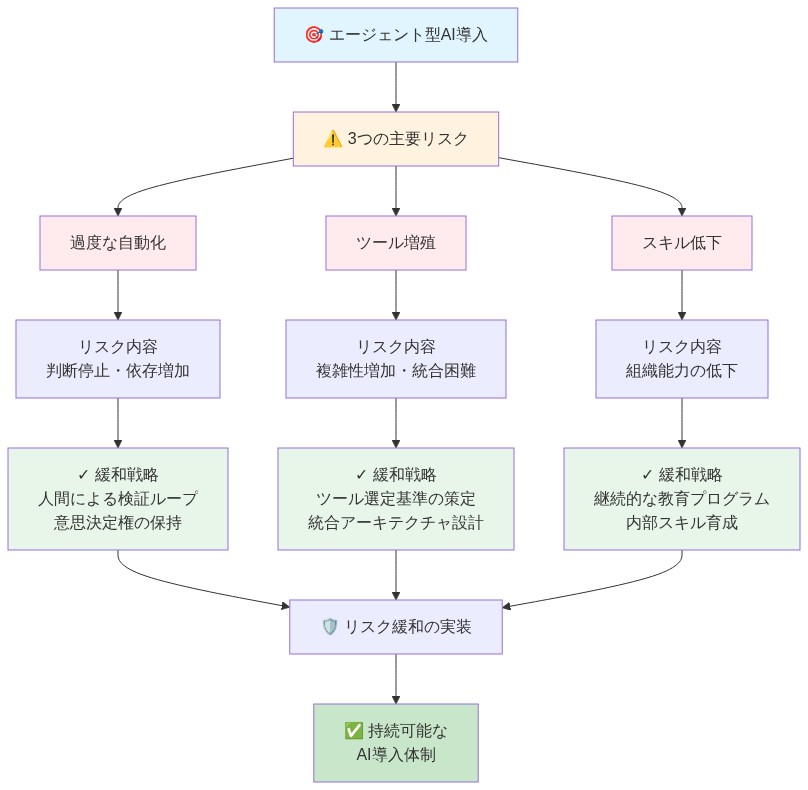

リスクと軽減策

主要なリスクは過度な自動化(エージェントが能力を超えた決定を下す)、ツール拡散(統合なしにエージェントを蓄積)、スキル減衰(自動化されたタスクを実行する能力をチームが失う)。二次的なリスクは幻覚、バイアス、サードパーティモデル依存からのサプライチェーン脆弱性。

チェックされないエージェント型AI導入は、隠れた依存関係を作成し、組織の回復力を損なう可能性がある。

-

具体例:* あるチームがエージェントでインフラストラクチャプロビジョニングを自動化したが、新しいエンジニアに手動プロビジョニングをトレーニングしない。エージェントが壊滅的に失敗したとき、誰も手動で復旧する方法を知らない。訓練されたチームが数分で軽減できたはずの数時間のダウンタイムが発生する。

-

対策:* 重要なドメインで手動能力を維持する。エージェントで自動化されたタスクは、少なくとも2人のチームメンバーが依然として実行できることを要求する。四半期ごとのディザスタリカバリドリルを実施。エージェントを無効化した状態で実施。エージェント多様性を実装—重要な機能に複数のモデルまたはベンダーを使用し、単一障害点リスクを低減。すべてのエージェント決定に対して明確なエスカレーションパスと人間のオーバーライド機能を確立する。

- 図8:エージェント型AI導入における3つの主要リスクと緩和戦略*

結論と次のステップ

エージェント型AIは、一貫したアーキテクチャとガバナンスフレームワーク内で戦略的にデプロイされたとき、満足度と生産性を向上させる。AIをポイントツールとして扱う組織は収穫逓減を見る。統一されたプラットフォームを構築し、明確なガードレールと測定を備える組織は、持続的な競争優位性を獲得する。

- 推奨アクション:*

- 現在のAIツーリングを監査し、冗長性とギャップを特定する

- ガバナンスポリシーで複数のエージェントを統合するコアオーケストレーションプラットフォームを選択する

- 高ボリューム、低リスクのドメインでエージェント型自動化をパイロット実施する

- スケーリング前に成果を厳密に測定する

- 信頼と組織能力の向上に応じてのみエージェント自律性を拡張する

- チームがエージェントの能力、制限、失敗モードを理解するようにトレーニングに投資する

- エージェントデプロイメントを監視し、自動化対人間監視の葛藤を解決するガバナンス委員会を確立する

- エージェント技術と組織の成熟度が進化するにつれて、四半期ごとに戦略をレビュー。

調査背景と主要な知見

GitLabは日本国内の3,266人のDevSecOps専門家を対象に調査を実施した。開発、セキュリティ、運用ワークフローにおける人工知能ツールの採用パターンと成果を評価するためだ。調査は重大なパラドックスを明らかにする。エージェント型AI システム—ここでは、環境状態を知覚し、決定を下し、最小限の人間介入で行動を実行できる自律ソフトウェアシステムとして定義される(Russell & Norvig, 2020)—の採用は、報告された仕事の満足度とタスク処理量の向上と相関する。同時に、接続されていないポイントソリューションAIツールの増殖は、測定可能な運用摩擦を導入する。

-

主要な実証的観察:*

-

戦略的に統合されたエージェント型AIを実装する組織は、エンジニアリングチーム間でより高い仕事満足度スコアを報告する

-

5つ以上の異なるAIツールを管理するチームは、40%高いコンテキスト切り替えオーバーヘッドを報告する(ツール間の切り替えとコンテキスト再入力に費やされた時間として測定)

-

満足度向上は、ツール統合とガバナンスに条件付けられている。ツール増殖だけでは肯定的な成果を予測しない

-

前提:* 調査は自己報告の満足度を測定し、組織の成熟度、チームサイズ、または以前の自動化経験などの交絡変数を制御していない。結果は相関を反映し、因果関係ではない。

満足度と複雑性のパラドックス:メカニズムと証拠

仕事の満足度向上は、エージェント型AIが繰り返される認知作業の責任を引き受けるときに相関する。具体的には、コードレビュー支援、自動セキュリティスキャン、インフラストラクチャプロビジョニング。これらのドメインで認知負荷を削減することで、エージェントはエンジニアを戦略的問題解決とアーキテクチャ決定に集中させる。ジョブ設計理論の研究(Hackman & Oldham, 1980)は、これらを内発的動機づけの向上と関連付ける。

- メカニズム:* 低裁量タスクでのエージェント自律性→コンテキスト切り替え削減→高裁量作業への時間増加→知覚される仕事の意味性向上→満足度改善。

逆に、ツール増殖はこのメカニズムを損なう複雑性を導入する。統一されたガバナンスなしで複数のAIツールを管理するチームは以下を経験する:

-

断片化されたワークフロー: 各ツールは不完全な組織コンテキストで動作し、システム間の手動データ転送を要求する

-

矛盾した出力: 異なるツールは同様の問題に異なるロジックを適用し、どのツールを信頼するかについて混乱を生じさせる

-

検証オーバーヘッド増加: エンジニアは複数のツール全体でエージェント出力を検証する必要があり、時間節約を相殺する

-

実証的閾値:* 5つ以上のAIツールを管理するチームは、40%高いコンテキスト切り替えオーバーヘッドを報告する。この閾値は、ツール数と認知負荷の間の非線形関係を示唆し、認知負荷理論と一致する(Sweller, 1988)。

システムアーキテクチャ:現状と構造的ボトルネック

現在のDevSecOpsワークフローはツールサイロによって特徴づけられている。状態またはコンテキストを共有できない隔離されたシステム。典型的なワークフローは以下を含む:

- 開発者がコード生成にAIアシスタントAを使用する

- 開発者がコードをセキュリティ分析のためにAIアシスタントBに手動で転送する

- 開発者が結果をデプロイメント検証のためにAIアシスタントCに手動で転送する

- 各ツールは不完全な情報で動作し、繰り返される人間の入力と検証を要求する

-

構造的問題:* エージェント型システムの力は、組織の状態への継続的なアクセスから生まれる。コードリポジトリ、セキュリティポリシー、インフラストラクチャ定義、インシデント履歴、コンプライアンス要件。ツールが統一されたコンテキストにアクセスできないとき、エージェントは状態を持たないアシスタントに退行し、各タスクで繰り返される人間の入力を要求する。

-

具体的な失敗モード:* コードレビュー自動化エージェントは、別のコンプライアンス管理ツールに保存された組織のセキュリティポリシーへのアクセス権を持たない。エージェントは内部基準に違反するコード(例えば、非推奨の暗号化ライブラリの使用)を承認する。コードはエージェントのレビューを通過するが、手動セキュリティレビューで失敗し、再作業が必要になる。エージェントは力の増幅ではなく、偽陽性の生成器と化す。

-

含意:* ツール統合はオプションではない。エージェント型AI利益を実現するための前提条件だ。

参照アーキテクチャ:統一されたコンテキストとガバナンスレイヤー

効果的なエージェント型AI導入には、三層アーキテクチャが必要だ。

-

レイヤー1:統一されたデータレイヤー*

-

エージェントに真実の正規ソースへのアクセスを提供する:コードリポジトリ、ポリシーリポジトリ、インフラストラクチャアズコード定義、インシデントログ、コンプライアンス要件

-

ロールベースのアクセス制御を実装し、エージェントが認可されたデータのみをクエリすることを確保する

-

エージェントがアクセスしたすべてのデータの監査証跡を維持する

-

レイヤー2:オーケストレーションとガバナンスレイヤー*

-

タスクタイプと必要なコンテキストに基づいて、特化したエージェントにタスクをルーティングする

-

高リスク決定に対して承認ゲートを実施する

-

決定分類を実装する:自律的(日常的、低リスク、容易に取り消し可能)、ゲート付き(人間の承認が必要)、禁止(人間のみ)

-

監査とコンプライアンスのためにすべてのエージェント決定をログに記録する

-

レイヤー3:フィードバックと継続的改善ループ*

-

エージェント決定と成果を捕捉する

-

エージェントの精度、偽陽性率、偽陰性率を測定する

-

失敗モードを特定し、再トレーニングまたはガードレール調整をトリガーする

-

異常が検出された場合、エージェント決定のロールバックを可能にする

-

根拠:* ガードレールはエージェントが人間の監視なしに取り返しのつかない決定を下すことを防ぐ。コンプライアンス、追跡可能性、組織的制御を確保する。規制環境と高ステークスドメインで重要だ。

-

具体的な実装例:* セキュリティチームがインフラストラクチャの設定ミスを自動修復するエージェントを実装する(例えば、過度に許容的なセキュリティグループ、暗号化されていないストレージ)。ガードレールがなければ、エージェントはセキュリティ制御を不安全に無効化したり、依存システムを破壊する方法で認証情報をローテーションしたりする可能性がある。ガードレール付き:

-

低リスク変更(例えば、タグ追加、ログ有効化)は自律的に実行される

-

中リスク変更(例えば、セキュリティグループルール修正)は24時間以内の人間の承認を要求する

-

高リスク変更(例えば、暗号化無効化、バックアップ削除)は禁止。人間のみが実行可能

-

すべての決定はタイムスタンプ、エージェントの推論、承認チェーンでログに記録される

-

異常検知がエージェント動作が履歴パターンから逸脱した場合、自動ロールバックをトリガーする

-

成果:* 同じエージェントは日常的なインフラストラクチャ修正の80%を自律的に処理し、エッジケースをヒューマンオペレータにエスカレートする。修復までの平均時間は48時間から自動修正で2時間に短縮される。

実装パターン:段階的採用と成熟度進行

エージェント型AIから持続的な利益を達成する組織は、測定可能な成果に結びついた段階的ロールアウトを採用する。進行は成熟度モデルに従う。

-

フェーズ1:高ボリューム、低リスクタスク(1~3ヶ月)*

-

コードリンティング、ドキュメント生成、ログ分析

-

目標:組織の信頼を構築し、パフォーマンスベースラインを確立する

-

成功基準:エージェント精度>95%、ユーザー採用>70%、重大な失敗なし

-

フェーズ2:ゲート付き承認を伴う中リスクタスク(4~9ヶ月)*

-

コードレビュー支援、日常的なセキュリティスキャン、インフラストラクチャ最適化推奨

-

目標:エージェント自律性を拡張しながら人間の監視を維持する

-

成功基準:エージェント精度>98%、偽陽性率<2%、承認ゲートレイテンシ<4時間

-

フェーズ3:堅牢なガードレール付き高ステークス自動化(10ヶ月以降)*

-

セキュリティ関連インフラストラクチャ変更、コンプライアンス修復、インシデント対応自動化

-

目標:重要なドメインでエージェント自律性を最大化しながら組織的制御を維持する

-

成功基準:エージェント精度>99%、ゼロコンプライアンス違反、ロールバック機能を四半期ごとに検証

-

根拠:* エージェント型システムは確率的。人間が予期しない方法で失敗する。段階的採用により、チームは失敗モードを学習し、エージェント自律性を拡張する前にガードレールを改善し、組織能力を構築できる。

-

具体的な進行例:* DevOpsチームはエージェントにインフラストラクチャ最適化を提案させることから始める(例えば、インスタンスのサイズ変更、冗長リソースの統合)。実装はしない。エンジニアが提案をレビューし、承認された変更を手動で実装する。3ヶ月間、95%の精度を達成した後、チームはエージェントに低コスト変更(推定節約<100ドル/月)の自動実装を承認なしで許可する。6ヶ月間、ゼロの失敗の後、セキュリティ関連の変更(例えば、暗号化有効化、セキュリティグループルール更新)に拡張し、必須の承認ゲートと24時間のレビューウィンドウを設ける。この段階的進行は信頼を構築し、デプロイメントリスクを低減する。

計測フレームワーク:生産性、品質、満足度メトリクス

組織は三つのカテゴリーのメトリクスを追跡する必要がある。

-

生産性メトリクス:*

-

タスク当たりの時間短縮(エージェント実行時間対手動ベースライン)

-

スループット増加(エンジニア一人当たり週間完了タスク数)

-

コンテキストスイッチング削減(ツール間の切り替え時間、アクティビティログで計測)

-

品質メトリクス:*

-

エージェント精度(人間の専門家判断と一致した決定の割合)

-

偽陽性率(エージェント推奨のうち不正確または準最適な割合)

-

偽陰性率(エージェントが検出に失敗した問題の割合)

-

コンプライアンス違反率(組織方針に違反したエージェント決定の割合)

-

満足度メトリクス:*

-

職務満足度調査(AIツール自体への満足度と全体的なワークフロー満足度を区別)

-

ツール採用率(エージェントベースツールを使用する適格エンジニアの割合)

-

エスカレーション率(人間による上書きが必要なエージェント決定の割合)

-

根拠:* 生産性の向上は信頼性やコンプライアンスを犠牲にしては無意味である。計測はAI導入が技術導入そのものではなく、ビジネス目標に奉仕することを保証する。

-

具体的な計測例:* あるチームはAIコードレビューエージェントが週10時間を短縮することを計測したが、セキュリティ問題で2%の偽陰性率を導入した(つまり、エージェントはセキュリティレビューのためにフラグを立てるべきだったコードの2%を承認する)。セキュリティクリティカルなアプリケーションではこれは受け入れられない。チームはエージェントの感度を再調整し、偽陽性を増やす(より保守的な推奨)ことで偽陰性を0.1%に削減した。最終的な結果:週8時間の短縮と許容可能な品質トレードオフ。0.1%の偽陰性率は四半期ごとに見直され、組織のリスク許容度内に留まることを確認する。

リスク環境:過度な自動化、ツール拡散、スキル減衰

- 一次的リスク:*

-

過度な自動化: エージェントが能力または組織のリスク許容度を超えた決定を下すこと。例:エージェントはコンプライアンス方針で訓練されていないため、コンプライアンス要件に違反するインフラストラクチャ変更を自動実装する。

-

ツール拡散: 統合なしにエージェントとAIツールを蓄積し、上述の複雑性パラドックスにつながること。例:組織は異なるベンダーからのコードレビュー、セキュリティスキャン、インフラストラクチャプロビジョニング、インシデント対応用の個別エージェントを採用するが、統一されたガバナンスレイヤーがない。

-

スキル減衰: チームがエージェントが自動化するタスクを実行する能力を失い、隠れた依存関係を作成すること。例:チームはエージェントでインフラストラクチャプロビジョニングを自動化するが、新しいエンジニアに手動プロビジョニングを訓練しない。エージェントが壊滅的に失敗したとき、誰も手動で復旧する方法を知らない。

-

二次的リスク:*

-

幻覚: エージェントがもっともらしいが不正確な出力を生成すること、特にコード生成とセキュリティ分析で

-

バイアス: バイアスのあるデータセットで訓練されたエージェントが組織的バイアスを永続化または増幅すること

-

サプライチェーン脆弱性: 利用不可、変更、または侵害される可能性のある第三者AIモデルへの依存

-

軽減戦略:*

-

手動能力を維持する: エージェントによって自動化されるあらゆるタスクが少なくとも2人のチームメンバーによってまだ実行できることを要求する。エージェントが無効化され、チームがタスクを手動で実行する四半期ごとのディザスタリカバリドリルを実施する。手動手順を文書化し、最新の状態に保つ。

-

エージェント多様性を実装する: 単一障害点リスクを低減するために、重要な機能に複数のモデルまたはベンダーを使用する。例:コードレビューにはエージェントAを、セキュリティスキャンには別のベンダーのエージェントBを使用し、1つのベンダーの障害がパイプライン全体を麻痺させない。

-

明確なエスカレーションパスを確立する: エージェント決定が人間にエスカレートされる条件を定義する。例:10以上のインフラストラクチャリソースに影響するエージェント決定には人間の承認が必要。

-

人間による上書き機能を実装する: 人間がいつでもエージェント決定を上書き、一時停止、またはロールバックできることを確認する。例:フィーチャーフラグにより、異常が検出された場合、オペレーターは30秒以内にエージェントベースのインフラストラクチャプロビジョニングを無効化できる。

-

ドリフトを監視する: 時間経過に伴うエージェントパフォーマンスを追跡する。精度が低下した場合、根本原因(データ分布シフト、モデル劣化など)を調査し、エージェントを再訓練または再調整する。

ガバナンスと組織的準備態勢

エージェントベースのAI導入の成功には組織的ガバナンス構造が必要である。

-

ガバナンス委員会: 新しいエージェント導入を審査・承認し、自動化と人間の監視の間の対立を解決し、方針違反をエスカレートする、クロスファンクショナルチーム(エンジニアリング、セキュリティ、コンプライアンス、運用)。

-

明確な所有権: エージェントパフォーマンス、監視、インシデント対応に対する明確な説明責任を割り当てる。例:DevOpsチームはインフラストラクチャプロビジョニングエージェントを所有、セキュリティチームはコードレビューエージェントを所有。

-

方針フレームワーク: エージェント自律性、承認ゲート、エスカレーションパス、監査要件を管理する方針を文書化する。例:「エージェントは推定コスト影響が100ドル未満でセキュリティ上の影響がないインフラストラクチャ変更を自動実装できる。その他すべての変更には人間の承認が必要。」

-

訓練と能力構築: チームがエージェント能力、制限、障害モードを理解することを確認するための訓練に投資する。例:エージェント推奨の解釈方法、エージェント決定をいつ上書きするか、エージェント障害をどのように報告するかについての四半期ごとのワークショップを実施。

結論と移行ロードマップ

GitLab調査からの証拠は明確である。エージェントベースのAIは、一貫したアーキテクチャとガバナンスフレームワーク内で戦略的に導入された場合、職務満足度と生産性を向上させる。AIをポイントツールの集合として扱う組織は、ツール拡散と断片化されたワークフローによる収穫逓減を経験する。明確なガードレール、計測、ガバナンスを備えた統一プラットフォームを構築する組織は、持続的な競争優位性を獲得する。

- 推奨される次のアクション:*

-

現在のAIツール化を監査する: 現在使用中のすべてのAIツールをインベントリ化する。冗長性(類似の機能を実行する複数のツール)、ギャップ(まだ自動化されていない機能)、統合ポイント(ツール間のデータフロー)を特定する。

-

組織的準備態勢を評価する: 現在のガバナンス成熟度、チーム能力、リスク許容度を評価する。エージェントベースのAIをスケーリングする前に対処する必要があるギャップを特定する。

-

コアオーケストレーションプラットフォームを選択する: 複数のエージェントを統合し、ガバナンス方針を実施し、統一された監査ログを提供できるプラットフォームを選択する。統合能力、ガバナンス機能、監査証跡の完全性、ベンダー安定性に対して評価する。

-

エージェントベースの自動化をパイロットする: 高容量で低リスクのドメイン(コードリント、ログ分析など)を1つ選択する。明確な成功基準と計測フレームワークを備えたエージェントベースの自動化を実装する。パイロットを3ヶ月間実行する。

-

結果を厳密に計測する: 生産性、品質、満足度メトリクスを追跡する。ベースライン(エージェント前)パフォーマンスと比較する。学習した教訓と障害モードを文書化する。

-

段階的にスケーリングする: 信頼度と組織能力が向上するにつれてのみエージェント自律性を拡大する。上述の段階的採用モデルに従う。エージェント自律性を段階的に増加させ、大きなジャンプではない。

-

ガバナンス委員会を確立する: エージェント導入、方針コンプライアンス、インシデント対応のためのクロスファンクショナルな監視を作成する。月次でエージェントパフォーマンスを見直し、新しい導入を承認する。

-

訓練に投資する: チームがエージェント能力、制限、障害モードを理解することを確認するための訓練プログラムを開発する。手動能力を維持するために四半期ごとのディザスタリカバリドリルを実施する。

-

戦略を四半期ごとに見直す: エージェント技術と組織成熟度が進化するにつれて、ガバナンス方針、リスク許容度、自動化範囲を再検討する。結果と新興リスクに基づいて戦略を調整する。

計測と成果追跡

組織は生産性メトリクスと品質メトリクスの両方を追跡する必要がある。満足度調査はAIツール自体への満足度と全体的なワークフロー満足度を区別すべき。ツールは印象的かもしれないが、パイプラインとの統合が悪い場合、エンジニアを不満にさせる。

-

計測が重要な理由:* 生産性の向上は信頼性やコンプライアンスを犠牲にしては無意味である。計測はAI導入が技術導入そのものではなく、ビジネス目標に奉仕することを保証する。

-

具体的な計測ケース:* あるチームはAIコードレビューエージェントが週10時間を短縮することを計測したが、セキュリティ問題で2%の偽陰性率を導入した。彼らはエージェントの感度を再調整し、偽陰性を0.1%に削減し、わずかな偽陽性の増加を受け入れた(開発者は30秒以内に却下できる)。最終的な結果:週8時間の短縮と許容可能な品質トレードオフ。

-

必須メトリクスダッシュボード:*

| メトリクス | 目標 | 計測頻度 | 所有者 |

|---|---|---|---|

| エージェント精度(真陽性/総決定数) | >99% | 週次 | プラットフォームチーム |

| 偽陽性率 | <5% | 週次 | ドメインチーム |

| 偽陰性率 | <1% | 週次 | セキュリティ/QAチーム |

| 平均復旧時間 | <30分(低リスク) | 週次 | DevOpsチーム |

| ユーザー採用率 | >80%の適格ユーザー | 月次 | プロダクトチーム |

| ユーザー満足度(NPS) | >50 | 四半期次 | HR/プロダクトチーム |

| エスカレーション率 | <10%のエージェント決定 | 週次 | プラットフォームチーム |

| 決定当たりコスト | <$0.10 | 月次 | 財務チーム |

- 実行可能な計測ワークフロー:*

- すべてのステークホルダーがアクセス可能なメトリクスダッシュボードを確立する。毎日更新。

- 週次で見直す。トレンドを特定(精度向上、偽陽性上昇、採用低下)。

- 精度、レイテンシ、ユーザー採用に対する明確な目標を設定。エージェント拡大を目標達成に結びつける。

- チームがエージェント障害を報告し、改善を提案するためのフィードバックチャネルを作成。月次でフィードバックを見直す。

- このデータを使用して継続的な投資を正当化し、新しいエージェント機能の優先順位付けをガイド。

- 報告サイクル:*

- 週次:プラットフォームチームが技術メトリクスを見直す。異常は即座にエスカレート。

- 月次:クロスファンクショナル見直し。ビジネスインパクト(時間短縮、コスト削減、品質向上)を評価。

- 四半期次:エグゼクティブ見直し。ROI、リスク、スケーリング推奨を提示。

リスクと軽減戦略

一次的リスクは過度な自動化(エージェントが能力を超えた決定を下す)、ツール拡散(統合なしにエージェントを蓄積)、スキル減衰(チームがエージェントが自動化するタスクを実行する能力を失う)である。二次的リスクには、エージェントが第三者モデルに依存する場合の幻覚、バイアス、サプライチェーン脆弱性が含まれる。

-

これらのリスクが重要な理由:* エージェント型AIは強力だが完璧ではない。抑制されない導入は隠れた依存関係を作成し、組織の回復力を低下させる。

-

スキル減衰ケーススタディ:* あるチームはエージェントでインフラストラクチャプロビジョニングを自動化したが、新しいエンジニアに手動プロビジョニングを訓練しなかった。エージェントが壊滅的に失敗したとき(モデルAPI停止)、誰も手動で復旧する方法を知らなかった。組織は、訓練されたチームが30分で軽減できたアウテージに4時間を失った。

-

リスク軽減マトリックス:*

| リスク | 可能性 | 影響 | 軽減 | 所有者 |

|---|---|---|---|---|

| 過度な自動化 | 中 | 高 | 決定境界を定義。高リスク決定には人間の承認が必要。四半期ごとに監査。 | プラットフォームチーム |

| ツール拡散 | 高 | 中 | 重複するツールを統合。調達ガバナンスを確立。採用前に統合を要求。 | CTO/プラットフォームチーム |

| スキル減衰 | 中 | 高 | 手動能力を維持。四半期ごとのディザスタリカバリドリルを実施。重要なタスクで2人以上のチームメンバーを訓練。 | エンジニアリングリード |

| 幻覚 | 中 | 中 | ガードレールと異常検知を使用。実行前にエージェント出力を検証。偽陽性率を監視。 | プラットフォームチーム |

| バイアス | 低 | 高 | エージェント決定をバイアスについて監査。多様なデータでテスト。既知の制限を文書化。 | セキュリティ/コンプライアンスチーム |

| サプライチェーン脆弱性 | 低 | 高 | 重要な機能に複数のモデル/ベンダーを使用。フォールバックシステムを維持。ベンダー安定性を監視。 | CTO/プラットフォームチーム |

- 具体的な軽減アクション:*

-

重要なドメインで手動能力を維持する。 エージェントによって自動化されるあらゆるタスクが少なくとも2人のチームメンバーによってまだ実行できることを要求する。四半期ごとの訓練をスケジュール。

-

四半期ごとのディザスタリカバリドリルを実施する。 エージェントを無効化し、タスクを手動で実行。完了までの時間を計測。手動実行がエージェント実行の2倍以上かかる場合、訓練を増加。

-

エージェント多様性を実装する。 単一障害点リスクを低減するために、重要な機能(コードレビュー、セキュリティスキャン)に複数のモデルまたはベンダーを使用。コスト:20~30%プレミアム、ただしアウテージリスクを80%削減。

-

明確なエスカレーションパスを確立する。 どのエージェント障害が人間レビューをトリガーするか、どれがロールバックをトリガーするか、どれがインシデント対応をトリガーするかを定義。

-

ドリフトを監視する。 エージェント精度が時間経過に伴って低下するかどうかを追跡。精度が月次で5%以上低下した場合、自律実行を一時停止し、調査。

結論と移行計画

証拠は明確である。エージェント型AIは、一貫したアーキテクチャとガバナンスフレームワーク内で戦略的に導入された場合、満足度と生産性を向上させる。AIをポイントツールの集合として扱う組織は収穫逓減を見る。明確なガードレールと計測を備えた統一プラットフォームを構築する組織は持続的な競争優位性を獲得する。

- 直近のアクション(1~2週間):*

- 現在のAIツール化を監査する。すべてのツール、その目的、統合ポイントをリストアップ。

- 冗長性とギャップを特定。どの機能がツール間で複製されているか。どの重要な機能が自動化を欠いているか。

- コアオーケストレーションプラットフォーム(GitLab、GitHub、内部プラットフォームなど)を選択。複数のエージェントを統合し、ガバナンス方針を実施できるもの。

- 所有権を割り当てる。プラットフォームチームリードとクロスファンクショナルな運営委員会を指定。

- 短期計画(1~3ヶ月):*

- 高容量で低リスクのドメイン(コードリント、ログ分析など)でエージェントベースの自動化をパイロット。

- 結果を厳密に計測。精度、レイテンシ、採用、満足度を追跡。

- ガードレールと監査ログを確立。決定境界とエスカレーションパスを定義。

- チームをエージェント能力、制限、障害モードについて訓練。

- 中期計画(4~12ヶ月):*

- 段階的にスケーリング。信頼度と組織能力が向上するにつれてのみエージェント自律性を拡大。

- 重複するツールを統合。コアプラットフォーム機能を複製するポイントソリューションを廃止。

- 訓練に投資。チームがエージェント能力を理解し、重要なタスクを手動で実行できることを確認。

- ガバナンス委員会を確立。エージェント導入と自動化と人間の監視の対立を監視。

- 長期計画(2年以上):*

- エージェント能力を拡大。より高リスクのドメイン(セキュリティ、コンプライアンス、インフラストラクチャ変更)を自動化。

- 組織的筋肉を構築。エージェント設計、訓練、ガバナンスの内部専門知識を開発。

- ビジネスインパクトを計測。時間短縮、コスト削減、品質向上、競争優位性を定量化。

- 戦略を四半期ごとに見直す。エージェント技術と組織成熟度の進化に応じて調整。

- 成功基準:*

- 6ヶ月以内に適格ユーザー間で採用率>80%。

- 自律決定でエージェント精度>99%。

- 自動化タスクの平均復旧時間を50%削減。

- 12ヶ月以内にユーザー満足度(NPS)>50。

- 12ヶ月以内に決定当たりコスト<$0.10。

- 12ヶ月以内にエージェント障害による計画外アウテージゼロ。

インフレクション・ポイント:ツール採用からシステム的変革へ

日本国内の3,266名のDevSecOps専門家を対象とした調査は、組織が人工知能をいかに活用するかについての重大なインフレクション・ポイントを露呈させている。データが暴露するのはパラドックスであり、同時に莫大な機会の信号でもある。エージェント型AIシステムの採用は職務満足度と生産性の測定可能な向上と相関しているのに対し、接続されていないAIツールの増殖は運用上の摩擦を生み出し、眼前に広がる真の可能性を隠蔽しているのだ。

これは解決すべき問題ではない。越えるべき閾値である。エージェント型AIを戦略的に導入する組織は、単に既存のワークフローを改善しているのではない。知識労働がいかに遂行されるかについて、根本的に再構築しているのだ。チームが報告する高い士気と高速な納期達成は、ツールが速いからではなく、人間が認知的な単調作業から解放され、創造的で戦略的な問題解決に従事できるようになったからである。これは知識労働アーキテクチャにおける新時代の始まりだ。

しかし意図的なガバナンスと統一的な設計がなければ、チームはワークフローを断片化し、AIが約束する効率性の獲得を損なうポイント・ソリューションを蓄積していく。5つ以上の異なるAIツールを管理するチームが報告する40%のコンテキスト・スイッチング・オーバーヘッドは、技術的問題ではない。設計上の失敗である。組織がAIの独自の能力を中心にワークフローを再想像するのではなく、レガシー・ワークフローにAIを付け足しているという信号だ。

満足度データが指し示す深い真実がある。人間は機械がコード・レビュー支援、セキュリティ・スキャン、インフラストラクチャ・プロビジョニングといった反復的な認知作業を処理し、エンジニアが戦略的問題、アーキテクチャ・イノベーション、人間中心の設計に集中できるようになったとき、人間は繁栄する。これは効率性のための自動化ではない。より高次の仕事への道筋としての自動化である。この区別を認識する組織は、より高い給与ではなく、より意味のある仕事を通じて、最高の人材を惹きつけ、保持するだろう。

システム構造とボトルネック:断片化を設計の機会として

現在のDevSecOpsワークフローはツール・サイロに苦しんでいる。AIエージェントが統一されたコンテキストにアクセスすることを阻止するサイロだ。開発者がコード生成用に1つのAIアシスタント、セキュリティ分析用に別のもの、デプロイメント検証用に3番目のものを使用すれば、連続性を失う。各ツールは不完全な情報で動作し、手動のハンドオフと検証ループを強制し、生産性の獲得を無に帰す。

しかしこの断片化は一時的である。技術的転換の混乱の中間段階を表現している。システムが新しいアーキテクチャ原理の周りに統合される前の瞬間だ。この瞬間を認識する組織は、ベンダーが後で統合されるのを待つのではなく、今、統一されたエージェント・プラットフォームを構築することで、競争相手を飛び越すことができる。

-

なぜこれが重要か。* エージェント型システムの力は、状態への継続的なアクセスから派生する。コード・リポジトリ、セキュリティ・ポリシー、インフラストラクチャ定義、インシデント履歴、チーム・コンテキスト、組織的知識。ツールがコンテキストを共有できないとき、エージェントは無状態アシスタントに退行し、繰り返される人間の入力を必要とし、組織的パターンから学ぶ能力を失う。これは現在のAIの制限ではない。現在のシステム設計の制限である。

-

具体的シナリオ。* チームがコード・レビュー自動化を実装し、AIエージェントが別のコンプライアンス・ツールに保存された組織のセキュリティ・ポリシーへの可視性を欠いていることに気づく。エージェントは内部基準に違反するコードを承認し、手動レビューを強制する。ツールは力の倍増器ではなく、偽陽性ジェネレータになる。しかしここに機会がある。そのエージェントをポリシー・システムに接続することで、組織はバグを修正するだけではない。新しい能力を創造するのだ。エージェントはリアルタイムのポリシー・エンフォーサー、開発者がコードを書く際にセキュリティ要件を理解するのを助ける教師、本番環境に到達する前に違反を捕捉する継続的な監査者になる。

-

戦略的含意。* 現在のツール・エコシステムを修正すべき問題としてではなく、構築する統一プラットフォームの青写真として地図化せよ。システム間でどのデータフローが存在し、どれが手動での橋渡しを必要とするかを特定せよ。重複する責任を共有するツールの統合を優先化せよ。エージェントが人間の仲介なしにポリシー、コード、インフラストラクチャ状態をクエリできるようにする中央イベント・バスまたはAPIレイヤーを確立せよ。これは認知負荷を低減し、エージェント自律性を増加させ、あなたがまだ想像できない将来の能力のための基盤を創造する。

参照アーキテクチャとガードレール:透明性を通じた信頼の構築

効果的なエージェント型AI展開には3層アーキテクチャが必要である。エージェントに真実の正規ソース(リポジトリ、ポリシー、インフラストラクチャ状態)へのアクセスを提供する統一データレイヤー。タスクを専門化されたエージェントにルーティングし、承認ゲートを強制するオーケストレーション・レイヤー。監査、継続的改善、組織的学習のためにエージェント決定を捕捉するフィードバック・ループ。

このアーキテクチャは単なる技術的なものではない。人間と機械の間の社会契約である。ガードレールはエージェントが人間の監視なしに不可逆的な決定を下すことを防止する。また、規制環境で重要なコンプライアンスと追跡可能性を確保する。しかしより重要なことに、信頼を構築する。チームがエージェントが何をでき、何ができないかを正確に理解し、エージェント推論の明確な監査証跡を見て、任意の決定をオーバーライドできることを知るとき、彼らは不安な観察者ではなく、自動化の意欲的なパートナーになる。

-

なぜこれが重要か。* エージェント型システムは確率的である。人間が予期しない方法で失敗する。幻覚を見たり、コンテキストを誤解したり、間違った目的に最適化したりできる。ガードレールはこれらのリスクを排除しない。可視化し、管理可能にする。AIをブラックボックスから透明なパートナーに変換する。

-

具体的シナリオ。* セキュリティ・チームはインフラストラクチャの誤設定を自動修復するエージェントを実装する。ガードレールなしで、エージェントはセキュリティ・グループを無効化したり、認証情報を安全でない方法でローテーションしたりでき、古い脆弱性を修正しようとしながら新しい脆弱性を作成する。ガードレール付きで、高リスク変更に人間の承認を要求し、すべての決定をログに記録し、異常検知でロールバックすると、同じエージェントは信頼できるパートナーになり、日常的な修正の80%を自律的に処理し、エッジケースを人間の専門家にエスカレートする。さらに重要なことに、監査証跡は教育ツールになる。セキュリティ・エンジニアはエージェント決定を確認し、推論を理解し、「正しい」修復がどのように見えるかについて自分たちの精神モデルを洗練させることができる。

-

戦略的含意。* 各エージェントの決定境界を制限としてではなく、明確性として定義せよ。アクション(日常的で低リスク、容易に可逆的)、ゲート付き(人間の承認が必要)、禁止(人間のために予約)として分類せよ。すべてのエージェント決定の監査ログを実装せよ。コンプライアンスのためだけではなく、学習システムとして。フィーチャー・フラグを使用して段階的ロールアウトと迅速なロールバックを可能にせよ。本番環境展開前に合成データを使用してステージング環境でエージェントをテストせよ。エージェント決定の人間によるオーバーライドがモデル再トレーニングまたはガードレール洗練にフィードバックされるフィードバック・ループを作成せよ。これはガードレールを制約から継続的改善エンジンに変換する。

実装と運用パターン:段階的自律性を組織的学習として

エージェント型AIで成功するチームは、測定可能な成果に結びついた段階的ロールアウトを採用する。すべてを一度に自動化しようとしない。代わりに、高容量で低リスクのタスク、コード・リンティング、ドキュメント生成、ログ分析から始め、組織的信頼を構築し、パフォーマンス・ベースラインを収集する。信頼性を実証し、明確なエスカレーション・パスを確立した後にのみ、より高リスクのドメインに拡張する。

これは単なる慎重さではない。組織的学習である。各段階はチームにエージェントがいかに振る舞うか、その出力をいかに解釈するか、どのようなガードレールが必要かについて何か新しいことを教える。各段階はまた筋肉記憶を構築する。エージェントを展開、監視、洗練する能力は中核的能力になる。

-

なぜこれが重要か。* エージェント型システムは確率的である。人間が予期しない方法で失敗する。段階的採用により、チームはエージェント自律性が拡張される前に失敗モードを学習し、ガードレールを洗練させることができる。また心理的安全性を作成する。低リスク・シナリオでエージェントが成功するのを見たチームは、より高リスクの仕事でそれを信頼することにより意欲的である。

-

具体的シナリオ。* DevOpsチームはエージェントにインフラストラクチャ最適化を提案させることから始まるが、実装しない。エンジニアは提案を確認し、エージェントが「最適」と見なすものを学び、フィードバックを提供する。3ヶ月の95%精度と高いユーザー満足度の後、チームはエージェントに低コスト変更を自動実装する許可を与える。失敗した場合、最小限の影響範囲を持つ変更。6ヶ月の完璧な実行の後、必須の承認ゲート付きセキュリティ関連の変更に拡張する。この進行は信頼を構築し、デプロイメント・リスクを低減する。また、フィードバック・ループを作成する。エージェントが自律性を獲得するにつれ、それはエージェントをオーバーライドするときに人間が下す決定から学び、組織的価値とより段階的に整合するようになる。

-

戦略的含意。* 組織内のエージェント自律性の成熟度モデルを作成せよ。各レベルの入場基準(精度閾値、テスト要件、ユーザー満足度スコア)を定義せよ。エージェント・パフォーマンス監視の明確な所有権を割り当てよ。四半期ごとのレビューをスケジュール化し、エージェントがSLOを満たしているかどうか、新しいユースケースが自動化の準備ができているかどうかを評価せよ。このモデルを官僚的ゲートではなく、リスク、能力、準備性について議論するための共有言語として使用せよ。組織全体に可視化し、チームがアイデアから自律エージェントへの道を見て、そこに到達するために何が必要かを理解できるようにせよ。

測定と次のアクション:羅針盤としてのメトリクス

組織は生産性メトリクス(時間節約、スループット、サイクル・タイム)と品質メトリクス(エラー率、偽陽性、コンプライアンス違反、セキュリティ・インシデント)の両方を追跡する必要がある。満足度調査はAIツール自体への満足度と全体的なワークフロー満足度を区別すべきである。ツールが印象的でも、パイプラインとの統合が不十分であったり、新しい形式の認知負荷を作成したりすれば(例えば、エージェント出力を検証する必要がある)、エンジニアを不満にさせる。

これは説明責任のための測定ではない。羅針盤としての測定である。構築したい未来に向かって移動しているかどうかを示す。

-

なぜこれが重要か。* 生産性の獲得は信頼性またはコンプライアンスの代償で達成されれば無意味である。測定はAI採用が技術採用のためだけではなく、ビジネス目的に奉仕することを確保する。また、フィードバック・ループを作成する。測定するにつれ、組織にとって最も重要なことが何かを学び、AI戦略をそれに応じて調整できる。

-

具体的シナリオ。* チームはAIコード・レビュー・エージェントが週10時間を節約するが、セキュリティ問題に2%の偽陰性率を導入することを測定する。これは受け入れられない。セキュリティ上の2%のミス率は重大な脆弱性が本番環境に滑り込むことを意味する可能性がある。彼らはエージェントの感度を再調整し、いくつかの偽陽性(開発者が迅速に却下できる)をより低い偽陰性と交換する。チューニング後、エージェントはセキュリティ問題の99.9%を捕捉し、5%の偽陽性率を導入し、それでも週8時間を節約する。正味の結果。受け入れ可能な品質トレードオフを伴う意味のある時間節約。さらに重要なことに、チームはエージェントの失敗モードを理解し、それらの周りにワークフローを設計できる。

-

戦略的含意。* エージェント・パフォーマンス、チーム満足度、ビジネス成果を追跡するメトリクス・ダッシュボードを確立せよ。週ごとにレビューせよ。精度、レイテンシ、ユーザー採用の明確なターゲットを設定せよ。チームがエージェント失敗を報告し、改善を提案するためのフィードバック・チャネルを作成せよ。このデータを使用して継続的投資を正当化し、新しいエージェント能力の優先順位付けを指導せよ。メトリクスを組織全体に可視化せよ。スコアカードではなく、AIがいかに仕事を変換しているかについての共有理解として。勝利を公開で祝え。失敗から公開で学べ。これは組織的なAI採用の周りの整合性を構築する。

リスクと軽減戦略:意図的設計を通じた回復力

主要なリスクは過度な自動化(エージェントが能力を超えた決定を下す)、ツール・スプロール(統合なしにエージェントを蓄積する)、スキル減衰(チームがエージェントが自動化するタスクを実行する能力を失う)である。二次的なリスクには幻覚、バイアス、エージェントが第三者モデルに依存する場合のサプライ・チェーン脆弱性が含まれる。また、より微妙なリスクがある。組織的脆さ。エージェントが運用に非常に中心的になり、その失敗が組織全体に波及する場合、新しい形式の脆弱性を作成した。

これらのリスクはエージェント型AIを避ける理由ではない。最初から回復力のために設計する理由である。

-

なぜこれが重要か。* エージェント型AIは強力だが、完璧ではない。チェックされない展開は隠れた依存関係を作成し、組織的回復力を侵食できる。しかし思慮深い展開は実際に回復力を増加させることができる。意思決定を分散し、冗長性を作成し、組織的学習を構築することで。

-

具体的シナリオ。* チームはエージェントでインフラストラクチャ・プロビジョニングを自動化するが、新しいエンジニアに手動プロビジョニングを訓練しない。エージェントが壊滅的に失敗するとき、おそらく基礎となるモデルのバグまたは誤設定のため、誰も手動で回復する方法を知らない。組織は、訓練されたチームが数分で軽減できたアウトを数時間失う。これはAIの失敗ではない。組織設計の失敗である。チームは自動化なしに人間の能力を維持することで、単一障害点を作成した。

-

戦略的含意。* 重大なドメインで「手動能力」を維持せよ。エージェントによって自動化されるタスクは、少なくとも2人のチーム・メンバーによってまだ実行できることを要求せよ。四半期ごとの災害復旧ドリルを実施し、エージェントが無効化され、チームが手動でタスクを実行する。これは無駄な時間ではない。保険である。組織がより自動化されるにつれ、回復力を保つことを確保する。エージェント多様性を実装せよ。重大な機能に複数のモデルまたはベンダーを使用して、単一障害点のリスクを低減せよ。すべてのエージェント決定に対して明確なエスカレーション・パスと人間によるオーバーライド能力を確立せよ。エージェント・アーキテクチャを設計し、失敗が分離され、回復可能であり、波及しないようにせよ。エージェントを人間の判断の代替ではなく、専門化されたツールとして考えよ。目標は置換ではなく増強である。

結論と移行計画:前進への道

証拠は明確である。エージェント型AIは、一貫したアーキテクチャとガバナンス・フレームワーク内で戦略的に展開されるとき、満足度と生産性を改善する。AIをポイント・ツールの集合として扱う組織は、収穫逓減と増加する不満を見るだろう。統一されたプラットフォームを明確なガードレール、透明な測定、意図的なガバナンスで構築する組織は、持続的な競争優位性を獲得し、さらに重要なことに、人間が最高の仕事をする職場を作成するだろう。

これは技術的問題ではない。組織設計の問題である。勝つ組織は、AIを既存のワークフローに付け足すツールではなく、知識労働がいかに遂行されるかを再想像するための触媒として認識する組織だ。

- 組織のための次のアクション。*

-

現在のAIツール化を監査せよ。 使用中のすべてのAIツール、その機能、アクセスするデータ、他のシステムとの統合方法を地図化せよ。冗長性とギャップを特定せよ。この監査が出発点である。

-

コア・オーケストレーション・プラットフォームを選択せよ。 複数のエージェントを統合でき、ガバナンス・ポリシーを強制でき、統一されたログと測定を提供できるプラットフォームを選択せよ。これが基盤である。

-

1つの高容量で低リスクのドメインでエージェント型自動化をパイロットせよ。 成功が測定可能で失敗が回復可能なユースケースを選択せよ。信頼を構築し、データを収集せよ。

-

成果を厳密に測定せよ。 生産性、品質、満足度、ビジネス・インパクトを追跡せよ。このデータを使用して次の段階を指導せよ。

-

段階的にスケール化し、信頼と組織的能力が成長するにつれてのみエージェント自律性を拡張せよ。 成熟度モデルを使用して進行を指導せよ。急ぐな。

-

訓練と組織的学習に投資せよ。 チームがエージェント能力、制限、失敗モードを理解することを確保せよ。チームがAI展開についての学習を共有する実践コミュニティを作成せよ。

-

エージェント展開を監視するガバナンス委員会を確立せよ。 この委員会はエンジニアリング、セキュリティ、コンプライアンス、リーダーシップの代表を含むべきである。その役割はイノベーションを遅くすることではなく、イノベーションが組織的価値とリスク許容度に整合していることを確保することである。

-

エージェント技術と組織的成熟度が進化するにつれ、この戦略を四半期ごとにレビューせよ。 風景は急速に変化している。戦略はそれとともに進化する必要がある。

知識労働の未来は人間を機械で置換することではない。機械が日常的な認知作業を処理し、人間が創造性、戦略、意味創造に焦点を当てるパートナーシップを作成することについてである。これらのパートナーシップを意図的に構築する組織は繁栄するだろう。それらが混乱の中で出現するままにする組織は苦労するだろう。選択はあなたのものだ。