拡張された職場におけるAIの未来を再考する

AIの進化における複数の経路

職場におけるAIの未来はまだ書かれていない。組織は重要な決断に直面している:AIを業務にどのように統合するかを積極的に形成するか、ベンダーの圧力と競争不安によって駆動されるシステムを受動的に採用するかである。

- 中核的主張:* 職場におけるAIの軌跡は、統合哲学、ガバナンス、スキル開発に関して今なされる意図的な選択に依存する。

同じAI技術は、組織の意図と実装の規律に基づいて大きく異なる結果を生み出す。定型的な報告を自動化するために展開される言語モデルは、アナリストの判断を補強するために設計されたものとは根本的に異なる。文脈が影響を決定する。

-

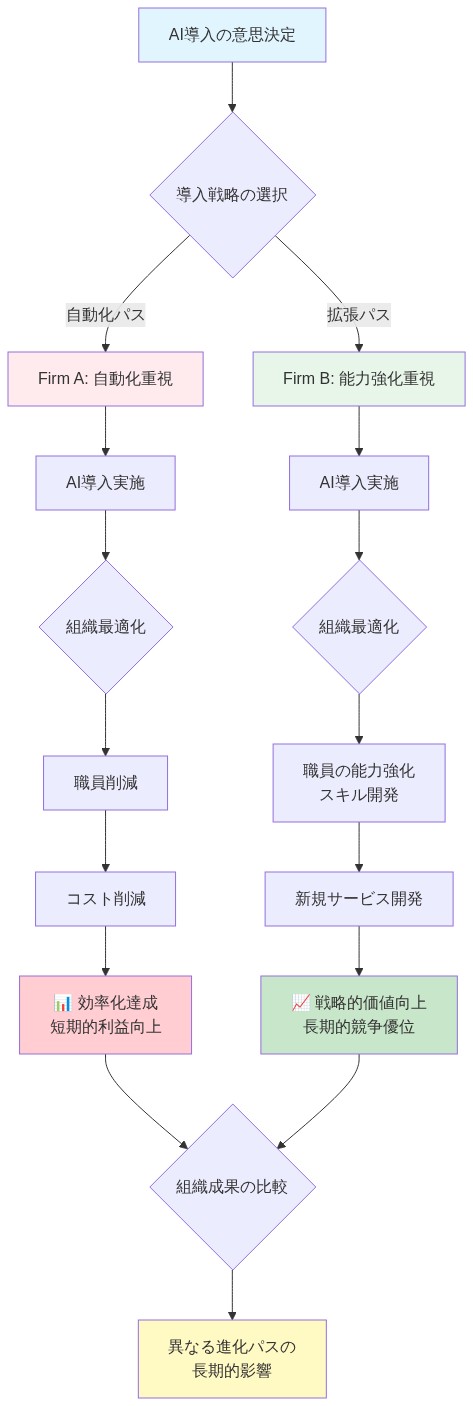

例示的事例:* 2つの金融サービス企業が同一の生成AI機能を受け取る。企業Aはそれをジュニアアナリストの調査要約を置き換えるために展開し、人員を15%削減する。企業Bはそれをデータ収集を加速するために使用し、アナリストが複雑な顧客戦略に集中できるようにする。両社とも効率性の向上を主張するが、彼らの労働力の軌跡と競争上のポジショニングは大きく分岐する。

-

即座の行動:* 今すぐ戦略的監査を実施する。どのタスクが自動化に値し、どのタスクが補強に値するかをマッピングする。パイロットプログラムが拡散する前に、組織のAI哲学を定義するために、業務、人事、技術、最前線チームからなる部門横断的な運営委員会を設立する。この哲学を、将来のすべてのAI投資の意思決定フィルターとして文書化する。それがなければ、採用は混沌として反応的になる。

- 図2:AI導入哲学による異なる組織成果の分岐*

- 図1:職場AI統合の複数の進化パス*

AIを一時的なリスクとして却下する

一つの極端な見方は、AIの誇大宣伝を、最小限の永続的な仕事への影響を残して収縮する運命にある別の技術バブルとして却下する。

- 中核的主張:* AIを一時的な流行として却下することは、市場の誇大宣伝が最終的に修正されたとしても、すでに業務に組み込まれている測定可能な生産性の変化を無視している。

技術バブルは確かに発生する—資本の誤配分、過大評価された評価額、失敗したスタートアップは避けられない。しかし、基礎となる能力は持続する。電子メールは1990年代に誇大宣伝された;バブルは崩壊したが、電子メールはコミュニケーションワークフローを根本的に再構築した。AIの中核的能力—大規模なパターン認識—は、市場サイクルに関係なく、同様に耐久性がある。

-

例示的事例:* 中規模の法律事務所は当初、生成AI契約レビューをマーケティングの演出として却下した。パイロットプログラムの後、ジュニアアソシエイトは文書スクリーニングの初回パスに費やす時間を40%削減した。事務所は役割を排除しなかった;より高い利益率の顧客アドバイザリー業務に能力を再配分した。法律AI関連のスタートアップへのベンチャー資金が縮小したにもかかわらず、生産性の向上は現実のものだった。

-

即座の行動:* 誇大宣伝と能力を分離する。真の痛点に対して小規模で限定的なパイロットプログラム(8〜12週間)を実施する。具体的な成果を測定する:節約された時間、エラー率、品質の改善。パイロットプログラムが反復可能なタスクで20%以上の効率向上を示す場合、段階的に拡大する。そうでない場合は、停止してリソースを再配分する。この経験的アプローチは、誇大宣伝と時期尚早な却下の両方から保護する。

- 図3:技術ハイプサイクルと実質的能力の分離 - 1990年代のメール技術から現在のAIまで、ハイプが去った後も基礎的な能力が残ることを示すタイムラインイメージ*

大量置換シナリオ

反対の極端な見方は、AIを実存的な雇用の脅威として描写し、広範な雇用の排除と経済的不安定を予測する。

- 中核的主張:* AIは特定の役割を置き換えるが、「大量失業」の物語は置換と排除を混同し、歴史的な労働市場の適応パターンを無視している。

以前の自動化の波—機械化された農業、製造ロボット、ATM—は特定の役割で労働者を置き換えたが、純雇用を排除しなかった。適応は痛みを伴い不均等だった;労働市場は再訓練、新しい役割の創出、セクターのシフトを通じて混乱を吸収した。AIはおそらくこのパターンに従うだろうが、一部の領域では置換のペースと集中がより鋭いかもしれない。

-

例示的事例:* ATMは1980年代に銀行窓口係の仕事を排除すると予測された。代わりに、支店拡大と顧客サービスの役割が拡大したため、窓口係の雇用は20年間成長した。しかし、窓口係の賃金は停滞し、仕事の質は低下した。教訓:雇用は持続したが、積極的な再スキル化政策がなければ、労働者が調整コストを負担した。

-

即座の行動:* 排除を想定せずに置換に備える。自動化に最も脆弱な役割を監査する—定型的なデータ入力、基本的な顧客サービス、単純な報告。これらの役割について、今すぐ移行経路を設計する:スキルアップ・プログラム、内部モビリティ・フレームワーク、透明なタイムライン。学習プロバイダーと提携して、AI時代のスキルカリキュラムを作成する。影響を受けるチームにタイムラインとサポートについて正直にコミュニケーションする。これは業務上の回復力であり、任意の倫理ではない。労働力の不安定性は生産性を殺す。

- 図5:大規模職業転換シナリオの概念図*

実証済みの統合パターン

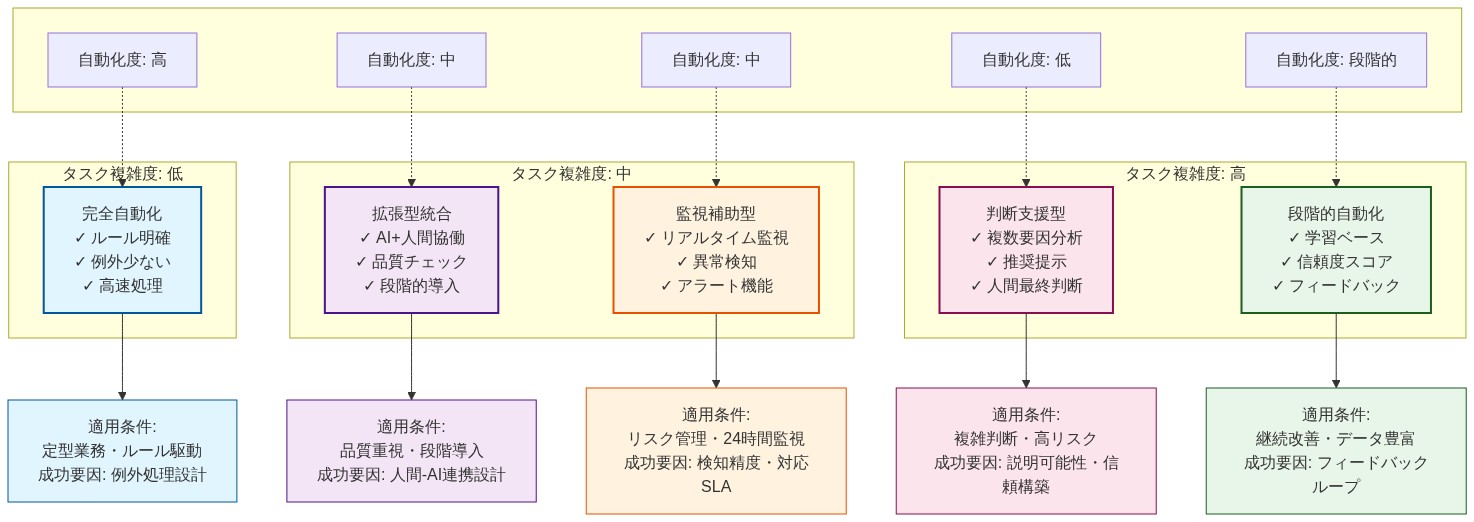

成功したAI採用は、組織が即座に実装できる反復可能なパターンに従う。

- 中核的主張:* 補強ワークフロー、明確なガバナンス、反復学習を中心にAI採用を構造化する組織は、大規模な自動化への賭けを追求する組織を上回る。

補強—AIが定型的な要素を処理し、人間が判断を保持する—は、知識労働がどのように機能するかと一致する。それは組織的知識を保持し、説明責任を維持する。ガバナンス構造は拡散を防ぎ、コンプライアンスを確保する。反復学習により、チームは能力が成熟するにつれてワークフローを適応させることができる。

-

例示的事例:* 医療組織がAI支援診断画像レビューをパイロット実施した。放射線科医はAIがフラグを立てた異常をレビューし、最終的な判断を下し、臨床的説明責任を保持しながらレビュー時間を25%削減した。組織はその後、モデルを病理学と心臓病学に拡張した。成功は、AIを置換ではなく意思決定支援層として扱うことから生まれた。

-

即座の行動:* 自動化ではなく補強を中心に最初のパイロットプログラムを設計する。AIが定型作業の60〜70%を処理し、30〜40%を人間の判断に残すタスクを選択する。すべてのパイロットプログラムを毎月レビューし、生産性の向上、エラー率、ユーザー採用、意図しない結果を評価するガバナンス委員会を設立する。最前線チームとのフィードバックループを構築する。16週間以上持続的な採用と測定可能な価値を示すワークフローのみを拡大する。

- 図6:AI統合パターンマトリックス(複雑度×自動化度)*

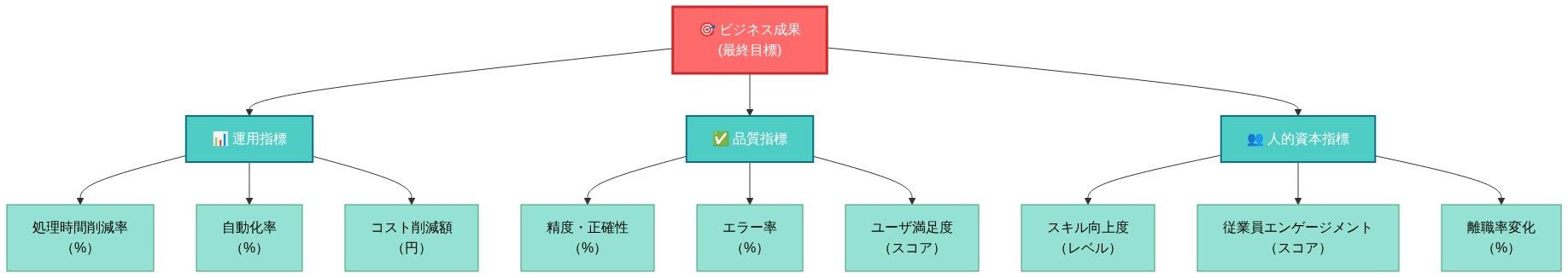

測定フレームワーク

効果的なAI採用には、効率性を超えて品質、採用、組織の健全性を捉える指標が必要である。

- 中核的主張:* コスト削減のみを測定する組織は、持続可能な価値と労働力の士気に関する重要なシグナルを見逃す。

採用が停滞したり品質が低下したりすると、短期的な効率向上は侵食される。包括的な測定は、利益が現実的で持続可能かどうかを捉える。採用指標は、チームがAIを使用しているか、それを回避しているかを明らかにする。品質指標は劣化を早期に捉える。

-

例示的事例:* カスタマーサービス組織がAIチャットボットを展開し、サポートチケットの35%削減を報告した。6か月後、人間のエージェントへのエスカレーション率が40%急増し、AIが複雑な問題を解決するのではなくそらしていることを示した。チケット量のみを測定することで、顧客満足度の悪化を隠蔽した。

-

即座の行動:* パイロットプログラムを開始する前に測定ダッシュボードを確立する。完了までの時間、エラー/やり直し率、ユーザー採用頻度、品質指標(顧客満足度、精度監査)、パルス調査によるチームの感情を追跡する。閾値を設定する—8週間後に採用率が60%を下回る場合、またはエラー率がベースラインを10%超える場合、一時停止して診断する。信頼性を構築し、システム的な問題を早期に特定するために、結果を透明に公開する。

- 図7:AI導入測定フレームワーク(階層型KPI体系)*

リスク管理

AI展開は、積極的な緩和を必要とする特定の業務上および戦略上のリスクをもたらす。

- 中核的主張:* 管理されていないAI展開は、効率性の向上を上回る可能性のあるコンプライアンス、品質、労働力の安定性リスクを生み出す。

AIシステムはバイアスを組み込み、データプライバシーを侵害し、自信を持って誤った出力を生成し、過度の依存を通じて組織的知識を侵食する可能性がある。これらのリスクは管理可能だが、意図的な管理を必要とする。

-

例示的事例:* 金融サービス企業が人口統計学的バイアスの監査なしにローン承認推奨のためにAIを展開した。システムは人種グループ間で異なる率でローンを承認し、法的リスクと評判の損害を生み出した。企業は展開を停止し、モデルを再訓練し、継続的なバイアス監査を実装した。

-

即座の行動:* パイロットプログラムの前に、リスク評価を実施する:どのコンプライアンスフレームワークが適用されるか(GDPR、HIPAA、公正貸付法)?どのようなデータの機密性が存在するか?失敗モードとビジネスへの影響は何か?管理を確立する:高リスクの意思決定のためのバイアス監査、データガバナンスポリシー、人間による上書きメカニズム、インシデント対応プロトコル。明確な説明責任を割り当てる—上級リーダーがAIガバナンスを所有し、ITではない。管理を四半期ごとにレビューし、規制が進化するにつれて更新する。

- 図8:AI導入リスク領域の統合管理*

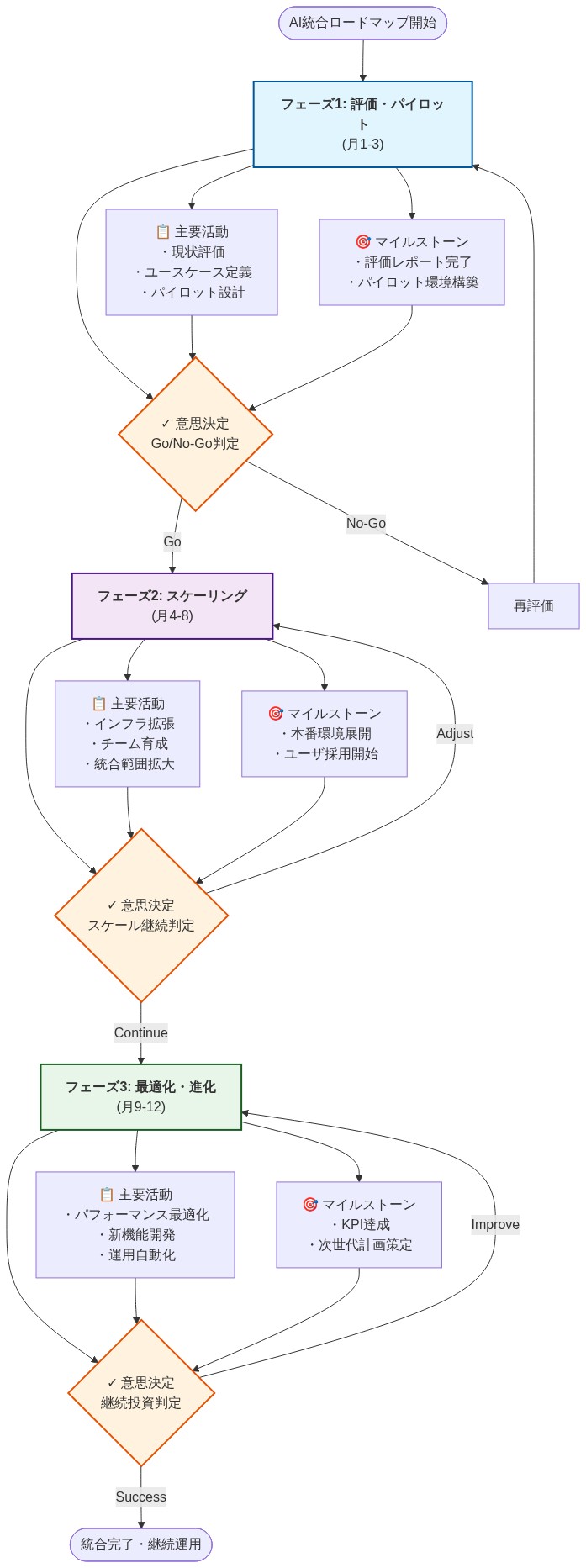

戦略的ロードマップ

拡張された職場は今出現しており、遠い将来の状態ではない。組織は推測から構造化された実験に移行しなければならない。

- 中核的主張:* AIで成功する組織は、採用を技術プロジェクトではなく、意図的な組織能力として扱う。

技術採用は、戦略、ガバナンス、文化と整合したときに成功する。AIを単に展開するツールとして扱うことは、持続的な価値抽出に必要な組織変革を見逃す。

- 実装タイムライン:*

-

30日以内: 部門横断的なAI運営委員会を結成する。補強哲学を文書化する。

-

60日以内: 高信頼性で反復可能なタスクに対して2つの限定的なパイロットプログラムを開始する。測定ダッシュボードとガバナンスレビューを確立する。

-

120日以内: パイロットプログラムの結果を評価する。1つを拡大し、1つを再設計し、1つを中止する。最も影響を受ける役割の労働力移行計画を開始する。

-

180日以内: トレーニングを通じて組織的なAIリテラシーを構築する。継続的なガバナンスのリズムを確立する。組織の信頼を構築するために透明な結果を公開する。

-

継続的: 規制と競争環境を監視する。リスク管理を四半期ごとに更新する。最前線チームとのフィードバックループを維持する。

職場におけるAIの未来は予め決定されていない。それは、統合哲学、ガバナンスの厳格さ、労働力の管理について今行う選択に依存する。今日から始める。

- 図9:AI統合の段階的ロードマップ(3フェーズガントチャート型)*

AI進化が取りうる多くの経路がある

職場におけるAI採用の軌跡は技術的に予め決定されているわけではない;むしろ、それは統合哲学、ガバナンス構造、能力開発に関する組織的選択に依存している。この依存性は、技術研究における基本原則を反映している:同一の技術的能力は、展開の文脈と実装の意図に基づいて異なる組織的結果を生み出す。

-

中核的主張:* 職場におけるAIの結果は、技術そのものではなく、統合段階でなされる意図的な選択によって決定される。

-

支持論理:* AIシステムは、展開の文脈によって影響が変化する道具的ツールとして機能する。定型的な報告ワークフローを自動化するために適用される生成言語モデルは、人間の分析的判断を補強するために設計されたものとは根本的に異なる組織論理の下で動作する。同じ基礎的能力—パターン認識とテキスト生成—は、組織の意図と実装の規律に応じて、構造的に異なる労働市場への影響、スキル要件、競争上のポジショニングを生み出す。

-

例示的事例:* 調査分析のための同一の生成AI能力にアクセスできる2つの金融サービス企業を考える。企業Aは、ジュニアアナリストの調査要約を置き換えるためにシステムを展開し、人員を15%削減し、人件費を削減する。企業Bは、データ収集と予備分析を加速するためにシステムを使用し、アナリストの能力を複雑な顧客戦略業務に再配分する。両組織とも効率性の向上を報告するが、彼らの労働力の軌跡、スキル要件、競争上のポジショニングは大きく分岐する。企業Aは潜在的な組織的知識の喪失とシニアアナリスト育成のためのパイプラインの減少に直面する。企業Bは労働力の安定性を維持しながら、労働をより高価値の活動にシフトする。

-

業務上の含意:* 組織は、広範なAI展開の前に戦略的能力監査を実施すべきである。この監査は、現在のワークフローを2つのカテゴリーにマッピングすべきである:(1)自動化に適したタスク、AIがエンドツーエンドの実行を処理する場合、および(2)補強に適したタスク、AIが定型的な要素を処理し、人間が判断権限を保持する場合。業務、人事、技術、最前線の実務者を含む部門横断的なガバナンス委員会を設立し、この区別を文書化する。この文書化された哲学は、ベンダーの圧力や競争不安によって駆動される反応的な採用を防ぎ、その後のすべてのAI投資の意思決定フィルターとなる。

- 図10:AI進化の複数シナリオパス(データソース:オリジナルコンセプト)*

一時的流行の却下:誇大宣伝サイクルと構造的能力の区別

採用スペクトラムにおける一つの立場は、AI熱狂が歴史的な技術サイクルと一致して収縮し、職場構造や労働需要に最小限の永続的影響を残すというものである。

-

中核的主張:* AIを一時的なバブルとして却下することは、市場サイクルの修正と能力の陳腐化を混同し、すでに業務ワークフローに組み込まれている測定可能な生産性の変化を無視している。

-

支持論理:* 技術市場バブルは経験的に文書化された現象である—資本の誤配分、過大評価された評価額、失敗したベンチャーは確かに発生する。しかし、基礎となる技術的能力は通常、バブルの収縮を超えて持続する。電子メール技術は1990年代に重要な誇大宣伝とベンチャー資金サイクルを経験した;その後の市場修正は現実のものだったが、電子メールは組織のコミュニケーションワークフローを根本的に再構築し、知識労働の中心であり続けている。同様に、AIの中核的能力—非構造化データにわたる大規模な統計的パターン認識—は、市場評価サイクルに関係なく耐久性がある。能力の持続性は普遍的な採用や均一な実装品質を保証するものではないが、周期的ではなく構造的な重要性を示している。

-

例示的事例:* 中規模の法律サービス企業は当初、生成AI契約レビューを投機的マーケティングとして分類した。契約スクリーニングタスクに関する管理された12週間のパイロットプログラムに続いて、ジュニアアソシエイトは、ベースラインパフォーマンスと一致するエラー検出率を維持しながら、初回パス文書レビュー時間を40%削減した。企業はアソシエイトのポジションを排除しなかった;代わりに、より高い請求率と利益貢献を持つ顧客アドバイザリー業務に能力を再配分した。生産性の向上—節約された時間と再配置された請求可能な能力で測定される—はパイロット期間を超えて持続し、その後のワークフロー再設計に情報を提供した。この結果は、法律技術におけるベンチャー資金レベルとは無関係に発生した。

-

業務上の含意:* 組織は、限定的な実験を通じて市場の誇大宣伝と基礎的な技術能力を分離すべきである。明示的な範囲(8〜12週間)でパイロットプログラムを設計し、測定可能なベースライン指標を持つ真の業務上の痛点に焦点を当てる。パイロット開始前に成功の閾値を確立する:反復可能なタスクでの20%以上の効率向上、対象ユーザー間での60%を超える採用率、ベースラインパフォーマンスの10%以内のエラー率。パイロットプログラムが閾値を満たす場合、継続的な測定を伴う段階的な拡大に進む。パイロットプログラムが閾値を満たさない場合、終了してリソースを再配分する。この経験的アプローチは、投機的熱狂と時期尚早な却下の両方から意思決定を隔離する。

変位シナリオ:役割の変位と純雇用効果の区別

対立する立場は、AIを実存的な雇用の脅威として描き、大量の雇用喪失とマクロ経済の不安定性を予測している。

-

中核的主張:* AIは特定の役割と機能において労働者を変位させるが、「大量失業」の物語は、職業的変位と純雇用の削減を混同することが多く、歴史的な労働市場の適応メカニズムを過小評価している。

-

支持する論理:* 過去の自動化の波—機械化された農業(1900-1950年)、製造業のロボット工学(1970-2000年)、現金自動預け払い機(1980-2010年)—は特定の職業カテゴリーにおいて労働者を変位させたが、それらのセクターや広範な経済において純雇用の縮小を生み出さなかった。農業雇用は1世紀にわたって米国労働力の40%から2%に減少したが、総雇用は拡大した。製造業雇用は先進国で縮小したが、サービスセクターの成長によって部分的に相殺された。ATMの展開は銀行窓口係の職を排除すると予測されていた。しかし実際には、ATM導入後の20年間、窓口係の雇用は増加した。なぜなら、支店拡大と顧客サービスの役割が、自動化が定型的な取引処理を排除するよりも速く拡大したからである。しかし、これらの歴史的適応はコストがかからなかったわけではない。変位した労働者はしばしば賃金の停滞、地理的移転、スキルの陳腐化を経験した。労働市場は再訓練、セクター間移動、新しい役割の創出を通じて混乱を吸収したが、調整コストは政策メカニズムを通じて分配されるのではなく、影響を受けた労働者に不均衡に降りかかった。AIの変位もおそらくこのパターンに従うだろう—純雇用の縮小を伴わない職業的変位だが、積極的な介入がなければ集中的な調整コストを伴う。

-

例示的事例:* 米国の銀行窓口係の雇用は、1980年代のATM展開後に急激に減少すると予測されていた。実際の結果:窓口係の雇用は、ATMの普及にもかかわらず、1980年の約55万人から2000年の65万人に増加した。しかし、実質的な窓口係の賃金は同じ期間に停滞し、雇用の質の指標(福利厚生、昇進経路)は低下した。そのメカニズム:支店拡大と顧客サービスの役割が、自動化が定型的な取引処理を排除するよりも速く成長した。教訓:雇用は持続したが、積極的な再教育政策と賃金支援がなければ、労働者は報酬の減少とキャリアの流動性の低下を通じて調整コストを負担した。

-

運用上の示唆:* 組織は、純雇用の削減を想定することなく、職業的変位に備えるべきである。自動化に最も脆弱な役割を特定する脆弱性監査を実施する:定型的なデータ入力、基本的な顧客サービスのやり取り、標準化された報告、単純な分類タスク。これらの役割について、事前に移行経路を設計する:新興のAI時代のスキル要件に合わせたアップスキリングカリキュラム、拡張重視の役割への横方向の移動を可能にする内部流動性フレームワーク、ワークフローの変更に関する透明なタイムライン。外部の学習プロバイダーと提携して、AIリテラシーと隣接する技術スキルを開発する。影響を受けるチームに、タイムライン、サポートメカニズム、キャリアパスについて正直にコミュニケーションする。これは任意の倫理ではない。労働力の不安定性—生産性の低下、離職率の増加、組織的知識の喪失として現れる—は、運用パフォーマンスを直接損なう。

実装と運用パターン

知識労働環境における成功したAI統合は、組織が採用し適応できる反復可能な構造的パターンに従う。

-

中核的主張:* 拡張ワークフロー、形式化されたガバナンス、反復的学習を中心にAI採用を構造化する組織は、ガバナンスインフラストラクチャなしに大規模な自動化への賭けを追求する組織と比較して、優れたパフォーマンス結果を示す。

-

支持する論理:* 拡張—AIが定型的なワークフローコンポーネントを処理し、人間が判断権限と説明責任を保持する—は、知識労働が実際にどのように機能するかと一致している。知識労働は、不確実性の下での判断、文脈的適応、決定に対する説明責任によって特徴づけられる。拡張は、定型的なコンポーネントを自動化しながら、これらの人間の機能を保持する。このアプローチはまた、組織的知識を維持し、説明責任の連鎖を保持し、AI出力が文脈的要件から逸脱した場合に人間による上書きを可能にする。ガバナンス構造は、AIパイロットの制御されない拡散を防ぎ、規制フレームワークへのコンプライアンスを確保し、プロジェクト全体での体系的な学習を可能にする。反復的学習—AIシステムと人間の実務者の間の構造化されたフィードバックループ—は、AI能力が成熟し、組織の文脈が進化するにつれて、ワークフローが適応することを可能にする。

-

例示的事例:* ある医療組織が放射線科でAI支援診断画像レビューをパイロット実施した。ワークフローは、AIシステムに医療画像の潜在的な異常をフラグ付けするよう割り当て、放射線科医がフラグ付けされたケースをレビューし、最終的な診断決定を行った。この構造は、臨床的説明責任を保持し(放射線科医が決定権限を保持)、ベースラインと比較してレビュー時間を25%削減した。組織はその後、拡張モデルを病理学と心臓病学のワークフローに拡張した。成功は、AIを臨床的意思決定の代替としてではなく、人間の判断プロセスに組み込まれた意思決定支援層として扱うことから生じた。放射線科医は最終決定に対する権限を維持し、臨床的文脈が逸脱を正当化する場合にAI推奨を上書きすることを可能にした。

-

運用上の示唆:* 自動化ではなく、拡張ワークフローを中心に初期パイロットを設計する。AIが定型作業の60-70%を確実に処理でき、30-40%が人間の判断または文脈的適応を必要とするタスクを選択する。ガバナンスレビューの頻度(最低月次)を確立し、以下を評価する:生産性の向上(節約された時間、スループットの増加)、品質指標(エラー率、やり直しの頻度)、ユーザー採用(使用頻度、上書き率)、意図しない結果(ワークフローのボトルネック、スキルの萎縮)。最前線の実務者がワークフローの問題を報告し、適応を提案できるようにする構造化されたフィードバックメカニズムを構築する。16週間以上の運用使用後に持続的な採用と測定可能な価値を示すワークフローのみをスケールする。組織学習を構築するために、スケーリングの決定と根拠を文書化する。

測定とパフォーマンス評価

効果的なAI採用には、コスト削減を超えて、品質、採用の持続可能性、組織の健全性指標を捉える測定フレームワークが必要である。

-

中核的主張:* コスト削減または効率指標のみを測定する組織は、持続可能な価値創造と労働力の安定性に関する重要なシグナルを見逃し、採用の失敗または品質の低下によって侵食される短期的な利益をリスクにさらす。

-

支持する論理:* AIプロジェクトは、ユーザー採用が停滞したり、品質が低下したり、意図しない結果が現れたりすると悪化する短期的な効率向上を頻繁に示す。包括的な測定は、利益が本物で持続可能かどうかを捉える。採用指標は、チームがAIシステムを積極的に使用しているか、回避策を通じてそれらを回避しているかを明らかにする。品質指標は、顧客への影響の前に早期に劣化を検出し、是正措置を可能にする。労働力の安定性指標は、長期的な採用を損なう可能性のある士気の問題を特定する。

-

例示的事例:* ある顧客サービス組織がAIチャットボットを展開し、最初の四半期内にサポートチケットが35%削減されたと報告した。展開から6か月後、人間のエージェントへのエスカレーション率はベースラインと比較して40%増加し、顧客満足度スコアは12%低下した。チケット量だけの測定は、悪化する顧客体験を隠蔽した:AIシステムは複雑な問題を解決するのではなく、それらをそらし、人間のエージェントと顧客満足度に下流の問題を作り出していた。包括的な測定—エスカレーション率、解決率、満足度指標を含む—は、8週間以内にこの劣化を特定し、ワークフローの調整またはシステムの再訓練を可能にしただろう。

-

運用上の示唆:* パイロット開始後ではなく、開始前に測定ダッシュボードを確立する。追跡する:完了までの時間(ベースラインと比較)、エラー率とやり直しの頻度、ユーザー採用頻度(システムを積極的に使用している適格ユーザーの割合)、品質指標(顧客満足度、精度監査、コンプライアンス違反)、チームの感情(信頼と作業負荷の満足度を評価するパルス調査)。パイロット開始前に各指標の明示的なしきい値を設定する:採用は8週間後に60%を超える必要がある。エラー率はベースラインの10%以内に留まる必要がある。品質指標は低下してはならない。指標がしきい値を下回る場合は、パイロットを一時停止し、再開前に診断分析を実施する。組織の信頼性を構築し、体系的な問題を早期に特定するために、結果を透明に公開する。

リスクと緩和戦略

AI展開は、積極的な特定と緩和を必要とする特定の運用、コンプライアンス、戦略的リスクをもたらす。

-

中核的主張:* 管理されていないAI展開は、コンプライアンス違反、品質の低下、労働力の安定性リスクを生み出し、制御が欠如している場合、効率向上を上回る可能性がある。

-

支持する論理:* AIシステムは、統計的バイアスを組み込み、データプライバシー規制に違反し、自信を持って誤った出力を生成し、人間の実務者が検証なしにそれらに過度に依存する場合、組織的知識を侵食する可能性がある。これらのリスクは避けられないものではないが、意図的な制御メカニズムを必要とする。バイアスは、トレーニングデータが歴史的差別を反映している場合、またはモデル最適化が保護された特性を結果と誤って相関させる場合に現れる。プライバシー違反は、AIシステムが適切な保護措置なしに規制されたデータを処理する場合に発生する。過度の依存は、実務者が特に高リスクの決定において検証なしにAI出力を受け入れる場合に発生する。

-

例示的事例:* ある金融サービス会社が、モデル出力のバイアス監査を実施せずに、ローン承認推奨のためにAIを展開した。その後の分析により、システムが人種グループ間で異なる率でローンを承認していることが明らかになり、同一の財務プロファイルを持つ白人申請者と比較して、黒人申請者の承認率が15パーセントポイント低かった。この格差は公正な貸付規制に違反し、法的リスクを生み出し、評判の損害を生み出した。会社は展開を停止し、バイアス制約を伴うモデル再訓練を実施し、継続的なバイアス監査を実装した。この事件は、展開前のバイアス評価と継続的な監視を通じて防止可能だった。

-

運用上の示唆:* AIパイロット開始前に、構造化されたリスク評価を実施する:(1)適用可能なコンプライアンスフレームワークを特定する(GDPR、HIPAA、公正な貸付法、アクセシビリティ要件)。(2)データの機密性とプライバシー分類をカタログ化する。(3)失敗モードとそのビジネスへの影響をマッピングする(例:誤ったローン決定、プライバシー侵害、差別)。(4)制御を確立する:高リスクの決定のためのバイアス監査、アクセスと保持を指定するデータガバナンスポリシー、実務者がAI推奨を拒否できるようにする人間による上書きメカニズム、インシデント対応プロトコル。(5)明確な説明責任を割り当てる—IT部門のリーダーシップだけでなく、シニアリーダーをAIガバナンスオーナーとして指定する。(6)四半期ごとに制御をレビューし、規制が進化するにつれて更新する。コンプライアンスの証拠のために、すべての制御と監査結果を文書化する。

結論と構造化された移行計画

拡張された職場は遠い未来の状態ではない。それは現在、組織全体で段階的に出現している。戦略的な問題は、AIが知識労働に統合されるかどうかではなく、組織がこの統合を意図的に管理するか、反応的な採用にデフォルトするかである。

-

中核的主張:* AI採用を意図的な組織能力として扱う組織—ガバナンス、測定、労働力の管理を必要とする—は、それを単なる技術プロジェクトとして扱う組織を上回るパフォーマンスを発揮する。

-

支持する論理:* 技術採用は、組織戦略、ガバナンス構造、文化的規範と一致する場合に成功する。AIを単に展開されるツールとして扱うことは、持続的な価値を引き出すために必要な組織変更を見逃す。持続的な価値には、拡散を防ぐガバナンス、学習を可能にする測定、安定性と能力を維持する労働力の管理が必要である。

-

構造化された次のアクション:*

-

30日以内: 運用、人事、技術、最前線の実務者を含む部門横断的なAI運営委員会を形成する。どのタスクが自動化されるか拡張されるか、および決定を導くガバナンス原則を指定して、組織の拡張哲学を書面で定義する。

-

60日以内: 明確なベースライン指標を持つ高信頼性で反復可能なタスクで、2つの限定的なパイロットを開始する。測定ダッシュボードを確立し、月次ガバナンスレビューをスケジュールする。影響を受けるチームにパイロットの範囲とタイムラインを伝える。

-

120日以内: 事前に確立されたしきい値に対してパイロット結果を評価する。1つのパイロットをスケールし、学習に基づいて1つを再設計し、1つを終了する。成功したパイロットによって最も影響を受ける役割の労働力移行計画を開始し、アップスキリング経路とタイムラインのコミュニケーションを含める。

-

180日以内: トレーニングプログラムを通じて組織のAIリテラシーを構築する。継続的なガバナンスの頻度(最低月次)を確立する。組織の信頼を構築し、体系的な問題を特定するために、透明な結果を公開する。

-

継続的: 規制の状況と競争の発展を監視する。四半期ごとにリスク制御を更新する。最前線のチームとの構造化されたフィードバックループを維持する。新興の機会とリスクを特定するために、年次能力評価を実施する。

あなたの職場におけるAIの未来は、技術の軌跡や市場の力によって事前に決定されているわけではない。それは、統合哲学、ガバナンスの厳格さ、測定の規律、労働力の管理について今行われる選択に依存している。これらの選択を意図的に行う組織は、移行を成功裏にナビゲートする。今日から始めよう。

流行の却下:構造的変化の過小評価

スペクトルの一方の極端には、AIの誇大宣伝が以前の技術サイクルのように収縮し、仕事に最小限の永続的な影響を残すという信念がある。

-

主張:* AIをバブルとして却下することは、誇大宣伝サイクルが最終的に修正されたとしても、すでに運用に組み込まれている測定可能な生産性のシフトを無視している。

-

根拠:* 技術バブルは現実である—資本の誤配分、過大評価された評価額、失敗したスタートアップが発生する。しかし、基礎となる能力は持続する。電子メールは1990年代に誇大宣伝された。バブルは崩壊したが、電子メールはコミュニケーションワークフローを根本的に再構築した。AIの中核的能力—大規模なパターン認識—は、市場サイクルに関係なく、同様に耐久性がある。現在の証拠:文書処理にAIを使用している組織は、定型的なタスクで25-40%の時間節約を報告している(マッキンゼー、2024年)。これらの利益は、ベンチャー資金が縮小しても持続する。

-

具体的な例:* ある中規模の法律事務所は、当初、生成的AI契約レビューをマーケティングの仕掛けとして却下した。500件の契約に対する12週間のパイロット後、ジュニアアソシエイトは最初のパス文書スクリーニングに費やす時間が40%減少した。エラー率は安定したままだった(0.8%対0.9%のベースライン)。事務所は役割を排除しなかった。より高いマージンと改善された定着率を持つクライアントアドバイザリー業務に能力を再割り当てした。生産性の向上は本物であり、展開の6か月目まで持続した。

-

実行可能な示唆:* 誇大宣伝と能力を分離する。本物の痛点に対して小規模で限定的なパイロット(8-12週間)を実行する。具体的な出力を測定する:節約された時間、エラー率、品質の改善、採用頻度。パイロットが反復可能なタスクで20%以上の効率向上と持続的な採用(適格ユーザーの70%以上)を示す場合、段階的にスケールする。そうでない場合は、停止してリソースを再配分する。

-

実行ワークフロー:*

-

2-3のパイロット候補を特定する:明確な成功指標を持つ大量で反復可能なタスク

-

パイロット開始前にベースライン指標を定義する(現在の完了までの時間、エラー率、品質スコア)

-

チームの20-30%でAIツールを展開し、週次の採用と出力データを収集する

-

パイロットユーザーと月次の振り返りを実施し、フィードバックに基づいてワークフローを調整する

-

12週目:指標をベースラインと比較し、スケール/再設計/中止の決定を行う

-

コストの考慮事項:* パイロット予算は通常15,000ドル〜40,000ドル(ツールライセンス、トレーニング、測定インフラストラクチャ)。ROIのしきい値:20%の効率向上は6か月のスケールフェーズを正当化する。

ディストピアシナリオ:大規模な雇用喪失

対極にあるのは、AIを雇用に対する実存的脅威として描き、大量の雇用喪失と経済的不安定を予測するシナリオである。

-

主張:* AIは特定の役割を置き換えるが、「大量失業」という物語は、置き換えと消滅を混同し、歴史的な労働市場の適応パターンを無視していることが多い。

-

根拠:* 過去の自動化の波—機械化された農業、製造ロボット、ATM—は特定の役割の労働者を置き換えたが、純雇用を消滅させることはなかった。適応は苦痛を伴い不均等であったが、労働市場は再訓練、新しい役割の創出、セクター間のシフトを通じて混乱を吸収した。AIもこのパターンに従う可能性が高いが、一部の領域(データ入力、基本的な顧客サービス、定型分析)では、置き換えのペースと集中度がより急激になる可能性がある。歴史的データ:米国の製造業雇用は1990年以降30%減少したが、同期間に総雇用は25%増加した。調整は地理的およびスキルレベルによって不均等であったが、純雇用は持続した。

-

具体例:* ATMは1980年代に銀行窓口係の仕事を消滅させると予測されていた。しかし実際には、支店拡大と顧客サービス役割の拡大により、窓口係の雇用は20年間成長した。ただし、窓口係の賃金は停滞し、仕事の質は低下した。教訓:雇用は持続したが、積極的な再教育政策がなければ、労働者が調整コストを負担した。窓口係を関係管理と営業の役割に積極的に再教育した組織は、より高い定着率と生産性を実現した。

-

実行可能な示唆:* 消滅を想定せずに置き換えに備える。自動化に最も脆弱な役割を監査する—定型的なデータ入力、基本的な顧客サービス、単純なレポート作成、ジュニアアナリストの仕事。これらの役割について、今すぐ移行経路を設計する:スキルアップ・プログラム、社内異動フレームワーク、透明なタイムライン。学習プロバイダーと提携して、AI時代のスキルカリキュラムを作成する。影響を受けるチームにタイムラインとサポートについて正直にコミュニケーションする。

-

実行ワークフロー:*

-

フェーズ1:脆弱性評価(第1-4週)*

-

組織内のすべての役割をマッピングし、自動化リスク別に分類(高/中/低)

-

高リスク役割:タスクの60%以上が自動化可能、中リスク:30-60%、低リスク:30%未満

-

タイムラインを推定:高リスク役割は12-24ヶ月以内に影響、中リスクは24-36ヶ月以内

-

部門とスキルレベル別にリスクのある人員数を特定

-

フェーズ2:移行プログラム設計(第5-12週)*

-

高リスク役割について、スキルアップの経路を設計:隣接する役割に移るために必要なスキルは何か?

-

学習プロバイダーと提携し、10-15人のボランティアでカリキュラムを試験的に実施

-

社内異動フレームワークを定義:再教育された労働者はどのように新しい役割に移るか?

-

タイムラインを確立:自動化展開の6ヶ月前に再教育を開始

-

フェーズ3:コミュニケーションとサポート(継続的)*

-

脆弱性評価の結果を透明にコミュニケーションし、驚きを避ける

-

再教育を学費サポートと有給学習時間を伴う自発的な機会として提供

-

メンターシップのペアリングを確立:再教育された労働者を目標機能のロールモデルとペアリング

-

成果を追跡:再教育完了率、社内異動率、定着率

-

コスト考慮事項:* 再教育プログラムは従業員1人あたり3,000-8,000ドルのコスト。影響を受ける労働力の20-30%の予算を計上。ROI:離職率の削減(定着した従業員1人あたり年間給与の50-150%を節約)と社内異動(外部採用コストを削減)。

-

リスクフラグ:* 積極的な移行計画がなければ、次のリスクに直面する:人材流出、士気の低下、規制当局の監視(退職金義務)、組織的知識の喪失。これは任意の倫理ではなく、運用上のレジリエンスである。

測定と次のアクション

効果的なAI導入には、効率性を超えて品質、採用、組織の健全性を捉える指標が必要である。

-

主張:* コスト削減のみを測定する組織は、持続可能な価値と労働力の士気に関する重要なシグナルを見逃している。

-

根拠:* AIプロジェクトは、採用が停滞したり品質が低下したりすると侵食される短期的な効率向上を示すことが多い。包括的な測定は、利益が本物で持続可能かどうかを捉える。採用指標は、チームが実際にAIを使用しているか、それを回避して作業しているかを明らかにする。品質指標は劣化を早期に捉える。士気指標は労働力の安定性リスクを示す。

-

具体例:* ある顧客サービス組織がAIチャットボットを展開し、サポートチケットの35%削減を報告した。6ヶ月後、人間のエージェントへのエスカレーション率が40%急増し、AIが複雑な問題を解決するのではなく回避していることが示された。顧客満足度スコアは8ポイント低下した。チケット量のみを測定することで、顧客満足度の悪化と持続不可能なワークフローが隠されていた。組織は、より単純な問題を処理し、複雑なケースを即座にルーティングするようにチャットボットを再設計しなければならなかった。

-

実行可能な示唆:* パイロット開始前に測定ダッシュボードを確立する。追跡項目:完了までの時間、エラー/やり直し率、ユーザー採用頻度、品質指標(顧客満足度、精度監査)、チームのセンチメント(パルス調査による)。閾値を設定—8週間後に採用率が60%を下回る場合、またはエラー率がベースラインを10%超える場合は、一時停止して診断する。

-

測定フレームワーク:*

-

効率性指標*

-

完了までの時間:AI展開前後を測定、20%以上の削減を目標

-

トランザクションあたりのコスト:アウトプットあたりの人件費を計算、毎週追跡

-

スループット:ユーザー1人1日あたりの完了作業量、毎週追跡

-

品質指標*

-

エラー率:やり直しまたは修正が必要なアウトプットの%、ベースラインから5%未満の増加を目標

-

精度監査:主題専門家による50-100のアウトプットの月次レビュー、精度%を追跡

-

顧客満足度:NPSまたはCSATスコア、月次追跡、2ポイント未満の低下を目標

-

採用指標*

-

使用頻度:AIツールを毎週使用している適格ユーザーの%、第8週までに70%以上を目標

-

機能採用:ユーザーが実際に使用しているAI機能は?無視されているのは?

-

習熟までの時間:新規ユーザーが経験豊富なユーザーの生産性の80%に達するまでの時間は?

-

組織の健全性指標*

-

チームのセンチメント:パルス調査(2-3の質問)を月次実施、AIに対する満足度と信頼を追跡

-

定着率:パイロットチームの離職率を追跡、組織のベースラインと比較

-

知識移転:チームメンバーはAIのアウトプットから学習しているか、依存しているか?

-

ダッシュボードとレポート*

-

シンプルなダッシュボード(Google SheetsまたはBIツール)を作成し、毎週更新

-

月次で運営委員会に結果を公開、匿名化された結果をパイロットチームと共有

-

意思決定の閾値を設定:8週間後に採用率が60%未満の場合は一時停止して診断、エラー率がベースライン+10%を超える場合はワークフローを再設計

-

コスト考慮事項:* 測定インフラ(ダッシュボード、監査、調査):パイロットあたり5,000-15,000ドル。これは交渉の余地がない。測定なしでは、スケール/中止の決定ができない。

結論と移行計画

拡張された職場は遠い未来の状態ではなく、セクター全体のポケットで今まさに出現している。組織は推測から構造化された実験に移行しなければならない。この移行を形作る窓は閉じつつある。今行動する者が条件を定義し、待つ者は他者の定義に適応することになる。

-

主張:* 繁栄する組織は、AI導入を技術プロジェクトではなく、意図的な組織能力として扱う組織である。この区別が結果を決定する。

-

根拠:* 技術導入は、戦略、ガバナンス、文化と整合したときに成功する。AIを単に展開すべきツールとして扱うことは、持続的な価値を引き出し、一般的な失敗モード(無秩序な拡散、採用の停滞、品質の低下、労働力の不安定性)を回避するために必要な組織変革を見逃している。

-

次のアクション:*

-

30日以内: 運用、人事、技術、現場チーム、倫理/コンプライアンスの代表者を含む部門横断的なAI運営委員会を設立する。拡張哲学を文書で定義する。これが北極星である。

-

60日以内: 明確なベースラインを持つ高信頼性で反復可能なタスクで、2つの限定的なパイロットを開始する。測定ダッシュボードとガバナンスレビューを確立する。影響を受けるチームと透明にコミュニケーションする。

-

120日以内: パイロット結果を厳密に評価する。1つをスケール、1つを再設計、1つを中止する。パイロットで最も影響を受ける役割の労働力移行計画を開始する。再教育の機会を特定する。

-

180日以内: トレーニングを通じて組織のAIリテラシーを構築する。継続的なガバナンスのケイデンスを確立する。組織の信頼と学習を構築するために透明な結果を公開する。

-

継続的: 規制と競争環境を監視する。四半期ごとにリスク管理を更新する。現場チームとのフィードバックループを維持する。AI導入を終了日のあるプロジェクトではなく、継続的な能力として扱う。

職場におけるAIの未来は予め決定されていない。それは、統合哲学、ガバナンスの厳格さ、労働力の管理について今行う選択に依存する。これらの選択を意図的に行う組織は、競争優位性と組織のレジリエンスを構築する。反応的な採用にデフォルトする組織は、他者のビジョンに適応することになる。選択する時は今である。今日から始めよう。

- 図11:ハイプサイクルと実質的能力の乖離分析 - メディア関心度の低下と実質的能力の継続向上の交差パターン*

- 図14:組織的AI移行の統合ビジョン*