The Download: 医療向けチャットボットと米国におけるAI規制をめぐる争い

医療チャットボットの能力と限界の評価

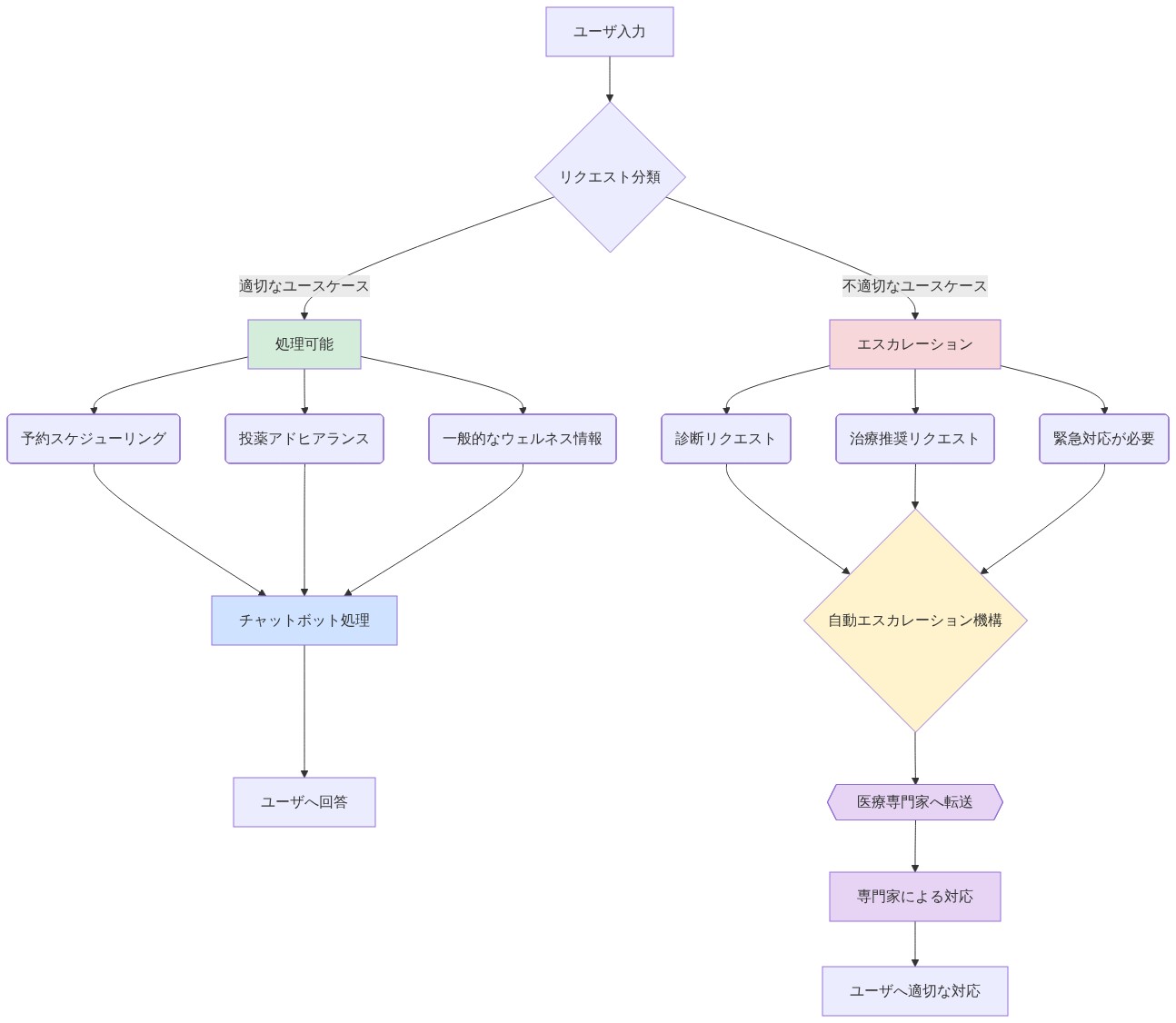

AIチャットボットを導入する医療機関は、実装前に運用上防御可能な境界を確立しなければならない。根本的な課題は、適切なユースケース(予約スケジューリング、服薬遵守のリマインダー、公衆衛生ガイダンスに沿った一般的な健康情報の提供)と、診断の策定や治療推奨を含む臨床判断を必要とするものとを区別することである。

-

能力評価の実証的根拠:* チャットボットは、大量の定型的な問い合わせにおいて測定可能な効率向上を示し、それによって臨床スタッフの能力を人間の専門知識を必要とする複雑なケースに再配分する。しかし、文書化された限界には、症状の説明の体系的な誤解釈や、現在のエビデンスに基づく臨床ガイドラインと矛盾する応答の生成が含まれる(Hao et al., 2023; Eysenbach & Wyatt, 2002)。厳格な運用ガードレールの根拠は直接的な因果関係に由来する:医学的に不正確な情報は、必要なケアの遅延や医原性の害への文書化された経路を生み出す。

-

運用実装:* 階層的エスカレーションアーキテクチャがこの制約に対処する。システムは、その運用範囲を超えるクエリ(潜在的に深刻な状態を示す症状の組み合わせ、文書化された薬物相互作用、または感情的苦痛の指標)を認識し、ユーザーを自動的に免許を持つ提供者に転送するように訓練されなければならない。これには、包括的な応答カバレッジを試みるのではなく、限界認識に関する明示的な訓練が必要である。

-

前提条件と仮定:* このフレームワークは以下を仮定する:(1)組織が機械可読形式の最新の臨床ガイドラインにアクセスできること、(2)エスカレートされたケースを受け取る臨床スタッフの能力が存在すること、(3)チャットボットの訓練データが現在のエビデンスを反映していること、(4)システムが範囲外のクエリを確実に検出できること。

-

実行可能な実装ステップ:*

- 本番環境への展開前に、査読済みの臨床ガイドラインおよび現在の治療プロトコルに対してチャットボットの応答を検証する

- 臨床レビューと文書化のために問題のあるインタラクションにフラグを立てる継続的な監視システムを実装する

- コンプライアンス監査とシステム改善のために包括的な会話ログを維持する

- 多様な患者集団(年齢、性別、人種、言語能力、健康リテラシーレベル)にわたって体系的なバイアス監査を実施する

- チャットボットが情報提供のサポートのみを提供し、医学的アドバイスや臨床評価を構成しないことを明記する明示的な免責事項をユーザーインターフェースに確立する

- 継続的なガバナンス:* 定期的な監査は、システムが新しいシナリオに遭遇する際に、運用境界が適切なままであるかどうかを評価すべきである。これにより、システムが安全に実行できない責任の段階的な引き受けであるスコープクリープを防ぐ。

- 図2:医療チャットボットの機能スコープと自動エスカレーションアーキテクチャ*

- 図4:医療チャットボット導入の5段階実装プロセス*

- 図1:医療AIチャットボットと人間の医療専門家の協働による患者ケア*

医療AIにおける透明性を通じた信頼の構築

AI支援医療における患者の信頼は、システムの運用とデータ慣行に関する透明性に根本的に依存している。文書化された研究は、患者がチャットボットを不信に思うのは、その意思決定プロセスが不透明なままであるためであることを示している(Longoni et al., 2019; Castelo et al., 2019)。

-

理論的根拠:* 患者がチャットボットが恣意的な決定を下すのではなく、エビデンスに基づくプロトコルを実行していることを理解すると、ツールへのエンゲージメントが測定可能に増加する。逆に、アルゴリズムの不透明性は懐疑を生み、採用率を低下させる—これは臨床AI実装への文書化された障壁である(Ghai et al., 2021)。

-

透明性メカニズム:*

-

AI支援インタラクションを明確に識別するユーザーインターフェースラベリング

-

情報処理ワークフローの平易な言葉での説明

-

具体的な技術的詳細(データ保持期間、アクセス制御、第三者共有)を含む公開されたデータプライバシー慣行

-

患者に参加とデータ使用に対する意味のある制御を提供する明示的な同意ワークフロー

-

文書化要件:* 医療機関は、精度率(運用上定義された)、エスカレーション頻度、患者満足度指標、およびシステムパフォーマンスの人口統計学的内訳を含む定期的な透明性レポートを公開すべきである。

-

具体例:* 「あなたの症状は提供者に連絡することを示唆しています」と述べるのではなく、透明なシステムは次のように説明する:「あなたが報告した症状の組み合わせと[特定のソース]からの現在の臨床ガイドラインに基づいて、身体検査と追加検査を通じてあなたを直接評価できる医療専門家と話すことをお勧めします。」

-

実行可能な実装ステップ:*

- 訓練データソース、既知の限界、および更新頻度を指定する患者向け文書を作成する

- 患者がAI推奨の人間による臨床レビューを要求できる正式なチャネルを確立する

- ケア提供ワークフローにおけるチャットボットの特定の役割を説明するために、臨床および管理スタッフを訓練する

- 文書化された利点と既知の限界の両方に対処する教育資料を開発する

- 透明性のギャップを特定するために、多様な人口統計を代表する患者諮問グループを招集する

- 前提条件:* このアプローチは、組織が以下を持っていることを仮定する:(1)チャットボットの訓練データソースを文書化していること、(2)正式な精度とバイアス評価を実施していること、(3)患者教育のためのリソースを割り当てていること、(4)臨床レビュー能力を確立していること。

- 図6:医療AI意思決定の透明化メカニズム - 入力から説明可能性確保までの全体構造*

- 図5:医療AIにおける透明性と説明可能性の実現*

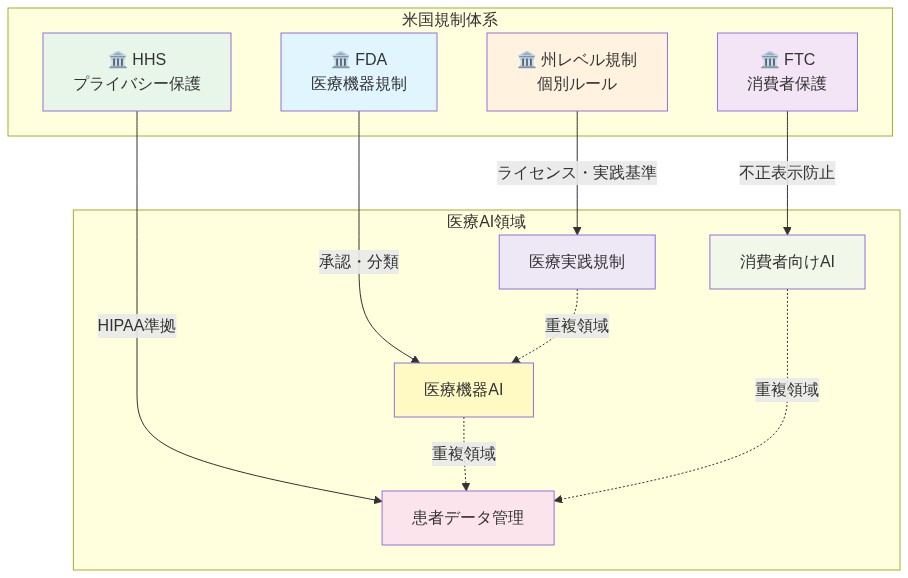

断片化された米国のAI規制環境のナビゲート

現在、米国には統一された連邦AI規制は存在しない。組織は代わりに、州固有の法律、提案された連邦法、および範囲、執行メカニズム、コンプライアンスのタイムラインが大幅に異なるセクター固有の規則で構成される断片化された環境をナビゲートする。

-

現在の規制環境:* 2024年時点で、規制アプローチには以下が含まれる:

-

AIシステムへの適用性が異なる州レベルのプライバシー法(カリフォルニア州消費者プライバシー法、コロラド州プライバシー法、バージニア州消費者データ保護法)

-

現在の法的効力を持たない提案された連邦法(AI権利章典フレームワーク、アルゴリズム説明責任法案)

-

セクター固有のガイダンス(医療機器としてのソフトウェアに関するFDAフレームワーク、不公正または欺瞞的なAI慣行に対するFTC執行措置)

-

機関固有のAIガバナンス要件を確立する大統領令

-

コンプライアンスの複雑性:* 一つの管轄区域の要件に違反するだけでも、文書化されたリスクが生じる:重大な金銭的罰則、評判の損傷、および運用の混乱。カリフォルニア州の基準に準拠したチャットボットは、コロラド州のアルゴリズム透明性要件に違反する可能性があり、管轄区域固有の実装または最も厳格な適用基準を満たすガバナンスアプローチのいずれかが必要となる。

-

具体例:* カリフォルニア州の提案された規制は、透明性とアルゴリズム影響評価を強調している。コロラド州の法律は、データプライバシーと消費者の権利に焦点を当てている。他の管轄区域は、バイアス検出と公平性指標を強調している。全国で事業を展開する組織は、統一されたコンプライアンスを確保するために、すべての管轄区域にわたって最も厳格な要件を満たさなければならない。

-

実行可能な実装ステップ:*

- 各運営管轄区域における既存および提案されたAI法を体系的にマッピングし、特定の要件とコンプライアンス期限を文書化する

- 特定のアプリケーションへの規制の適用性を解釈する権限を持つコンプライアンス責任者を指定する

- 四半期ごとのレビューサイクルで規制の動向を監視する集中追跡システムを確立する

- 最も厳格な適用要件に対応する柔軟なガバナンスフレームワークを作成する

- 曖昧な条項の明確化のために、規制機関(州司法長官、連邦機関)との関係を構築する

- 規制の調和を提唱する業界連合および業界団体に参加する

-

戦略的考慮事項:* 組織は、特定の高リスクAIアプリケーションが準拠管轄区域への地理的制限を正当化するかどうかを評価すべきである。この実用的なアプローチは、すべての50州にわたる完全なコンプライアンスが一時的に実行不可能である可能性があることを認識している。

-

前提条件:* このフレームワークは以下を仮定する:(1)専任のコンプライアンスリソース、(2)複数の管轄区域における法的専門知識、(3)管轄区域固有のアプローチを実装する組織の柔軟性。

- 図8:米国医療AI規制における機関別責任範囲と領域別適用マトリックス*

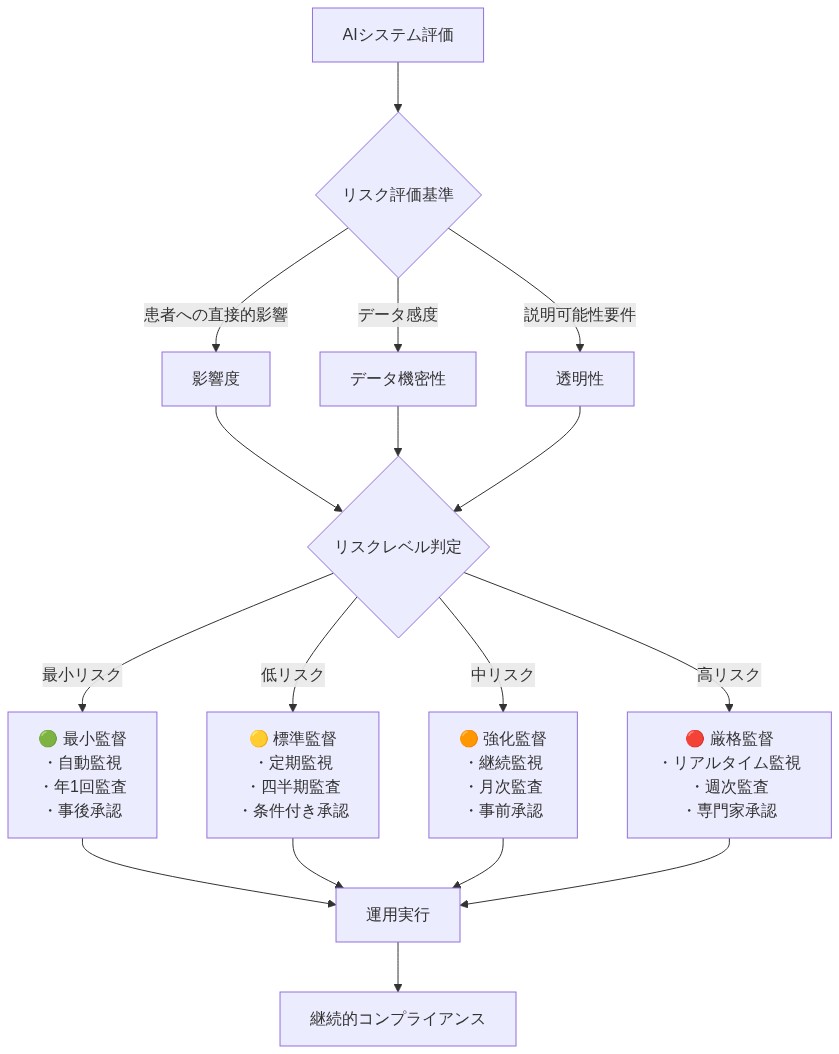

リスクベースのAIガバナンスフレームワークの実装

効果的なAIガバナンスは、潜在的な害に比例した監視を割り当てる。一般的な健康のヒントを提供するチャットボットは、雇用決定、刑事司法の結果、または治療推奨に影響を与えるシステムとは根本的に異なる精査を必要とする。

-

理論的根拠:* リスクベースの配分は、高リスクシステムのガバナンス不足(責任を生み出す)と低リスクシステムの過剰ガバナンス(リソースを浪費し、イノベーションを遅らせる)の両方を回避することにより、リソース効率を最適化する。

-

リスク分類システム:* 以下の次元にわたってアプリケーションを評価する:

-

健康/安全への影響: 不正確な情報またはケアの遅延による直接的な患者への害の可能性

-

市民権への影響: 保護されたクラスに影響を与える差別的な結果の可能性

-

財務的影響: 個人または組織への経済的害の可能性

-

自律性への影響: システムが人間の意思決定を置き換える程度と支援する程度

-

ガバナンスの強度:* リスクレベルに監視を調整する:

-

低リスクアプリケーション(予約スケジューリング、一般情報提供):基本的な精度チェック、エスカレーションプロトコル、四半期ごとの監査

-

中リスクアプリケーション(症状トリアージ、服薬リマインダー):臨床検証、バイアス監査、月次監視、文書化されたエスカレーション手順

-

高リスクアプリケーション(治療推奨、診断支援):厳格な臨床検証、多様なレビューボード、継続的なパフォーマンス監視、人間の監視メカニズム、インシデント対応手順

-

具体例:*

-

予約をスケジュールするチャットボット(低リスク)は、基本的な精度検証と人間のスタッフへの明確なエスカレーション経路を必要とする

-

治療オプションを推奨するチャットボット(高リスク)は以下を必要とする:査読済みガイドラインに対する臨床検証、人口統計グループにわたる体系的なバイアス監査、人間の臨床医の監視メカニズム、継続的なパフォーマンス監視、および文書化されたインシデント対応手順

-

実行可能な実装ステップ:*

- 技術的専門知識、法的権限、臨床知識、および倫理的訓練を持つレビューボードを確立する

- 敏感な領域(健康、雇用、刑事司法)に対してより厳格な文書化を要求する承認ワークフローを設計する

- 展開後のパフォーマンス低下を検出する継続的な監視システムを実装する

- ユーザー通知、是正、および規制報告を含むインシデント対応手順を開発する

- システムの動作と結果に対する責任を割り当てる明示的な説明責任構造を作成する

- 技術的精度とともに、公平性(人口統計グループ間のパフォーマンスパリティ)、透明性(説明可能性)、およびユーザー満足度を評価する指標を確立する

- 前提条件:* このアプローチには以下が必要である:(1)ガバナンス構造への組織的コミットメント、(2)多様な専門知識へのアクセス、(3)監視を可能にする技術インフラストラクチャ、(4)文書化された意思決定プロセス。

- 図10:AIリスク分類と対応する監督レベルの対応関係*

連邦AI法への準備

連邦AI規制は避けられないが、その具体的な法的形式は不確実なままである。組織は、提案された法案、機関のガイダンス文書、および管轄区域にわたる規制動向を分析することにより、可能性の高い要件を予測すべきである。

-

*提案にわたる共通の規制テーマ**には以下が含まれる:

-

データガバナンス(品質保証、出所の文書化、プライバシー保護)

-

影響評価(潜在的な害の展開前評価)

-

人間の監視メカニズム(AIが人間の判断を置き換えるのではなく支援することを保証する)

-

透明性要件(説明可能性、監査可能性)

-

外部説明責任メカニズム(第三者監査、公開報告)

-

戦略的根拠:* 規制は通常、責任ある組織によってすでに採用されているベストプラクティスを成文化する。これらの慣行を今実装する早期採用者は、より低いコンプライアンスコストに直面し、規制当局と顧客に対する信頼性を示す。

-

実行可能な実装ステップ:*

- 品質、文書化された出所、およびプライバシー保護を保証する堅牢なデータガバナンス慣行を確立する

- AIシステムの設計、訓練データソース、テストプロトコル、およびパフォーマンス指標の包括的な文書化を開発する

- 展開前に潜在的な害を評価する影響評価を実装する

- 外部の利害関係者が懸念を報告できるメカニズムを作成する

- AIが臨床意思決定を置き換えるのではなく支援することを保証する人間の監視プロトコルを確立する

- 説明可能性(モデルの解釈可能性、決定の文書化)と監査可能性(包括的なロギング)を可能にする技術インフラストラクチャを構築する

- 第三者プロバイダーがガバナンス基準を満たすことを保証するベンダー管理慣行を開発する

- AI戦略とコンプライアンスに対する明示的な責任を持つ上級幹部を任命する

-

利害関係者のエンゲージメント:* 組織は、提案された規制に関する公開コメントプロセスに参加し、業界団体を通じて政策立案者と関与し、運用上の現実に基づいた実用的な規制アプローチを形成すべきである。

-

前提条件:* この準備には以下が必要である:(1)上級リーダーシップのコミットメント、(2)技術インフラストラクチャへの投資、(3)文書化の規律、(4)継続的な規制監視。

- 図11:連邦AI法制化への移行と組織の先制的準備*

AI開発におけるイノベーションとコンプライアンスのバランス

技術チームは、コンプライアンスをイノベーションの制約として頻繁に認識する。効果的な組織は、実験を抑制することなく、ガバナンスを開発ワークフローに統合する。

-

理論的根拠:* コンプライアンスとイノベーションは本質的に対立するものではない。明確なガイドラインは、許容されるアプローチに関する曖昧さを排除し、開発の後期にコンプライアンスの問題が浮上したときのコストのかかる再作業を防ぐことにより、実際に開発を加速する。

-

統合メカニズム:*

-

プライバシーバイデザインと公平性バイデザインの原則を技術アーキテクチャに組み込む

-

パフォーマンス指標とともに規制コンプライアンスを評価するテストプロトコルを開発する

-

適切な保護措置を備えた実験用のサンドボックス環境を作成する

-

技術的決定とトレードオフを文書化する

-

コンプライアンスタスク(バイアス検出、監査証跡生成)を自動化するツールに投資する

-

コンプライアンスの懸念を奨励する組織文化を育成する

-

規制環境と個々のコンプライアンスの役割に関するスタッフトレーニングを提供する

-

上級リーダーシップの決定を必要とするイノベーションとコンプライアンスの対立のための明確なエスカレーション経路を確立する

-

具体例:* 診断チャットボットを構築する開発チームは、以下をカバーするコンプライアンスチェックリストを使用する:データプライバシー(暗号化、保持)、バイアステスト(人口統計グループ間のパフォーマンス)、臨床検証(査読済みガイドラインに対する精度)、およびエスカレーションプロトコル(範囲外のクエリの自動転送)。これにより、開発の後期にコンプライアンスの問題が浮上したときの再作業を防ぐ。

-

実行可能な実装ステップ:*

- アジャイル開発スプリントにコンプライアンスチェックポイントを統合する

- 技術、コンプライアンス、臨床、および法的専門知識を含む機能横断チームを確立する

- 異なるユースケースに合わせた再利用可能なコンプライアンステンプレートを作成する

- バイアス、プライバシー、および精度のための自動テストを実装する

- 新たな問題に早期に対処する技術スタッフとコンプライアンススタッフ間の定期的なタッチポイントを確立する

- コンプライアンスの決定と根拠を文書化する

- 展開前の予測と実際のパフォーマンスを比較する展開後監査を実施する

- 前提条件:* この統合には以下が必要である:(1)コンプライアンスへの組織的コミットメント、(2)機能横断的な協力、(3)技術インフラストラクチャ、(4)ガバナンス優先事項に関するリーダーシップの整合性。

主要なポイントと次のアクション

医療チャットボットは、適切な保護措置を伴って展開される場合に限り、アクセスと運用効率を改善するための実証された機会を提供します。組織は以下を行う必要があります:明確な運用境界を確立し、透明性を優先し、断片化された規制をナビゲートし、リスクベースのガバナンスを実装し、連邦要件を予測し、コンプライアンスを開発ワークフローに統合すること。

- 即座のアクション:*

- 上記で概説されたフレームワークに対して既存のチャットボット展開を監査し、ギャップを文書化する

- システムの動作に対する明示的な説明責任を割り当てるガバナンス構造を確立する

- 運用管轄区域における規制要件を文書化されたコンプライアンス期限とともにマッピングする

- AIシステムの包括的な文書化(設計、トレーニングデータ、テスト、パフォーマンス)を開始する

- 技術、法律、臨床、倫理の専門知識を持つ部門横断的なガバナンス委員会を設立する

これらのステップを体系的に実装する組織は、真の患者の信頼と規制上の信頼性を構築しながら、責任を持ってAIをスケールする立場に置かれます。

- 図13:イノベーションとコンプライアンスの統合的アプローチ*

医療チャットボットの能力と限界の評価:トリアージ革命の解放

医療組織は転換点に立っています。チャットボットを制約されたツールとして見るのではなく、先見の明のあるリーダーは、それらを根本的に再構想されたケア提供モデルの基盤として認識しています。AIが日常的な問い合わせの指数関数的な増加を処理し、臨床医が複雑性、ニュアンス、人間的なつながりに集中できるようにするモデルです。

機会は広大です:日常的な医療問い合わせは、臨床スタッフの時間の推定30〜40%を消費しています。予約スケジューリング、服薬リマインダー、一般的なウェルネス情報、症状トリアージを処理できるチャットボットは、効率向上だけでなく、世界中の医療サービスが不足している人々を悩ませる医療アクセスのボトルネックを解決する道筋を表しています。

しかし、このビジョンには厳格な運用境界が必要です。重要な区別は、適切なユースケース(明確な決定木を持つ大量のパターンマッチングされた相互作用)と、不可欠な人間の判断を必要とするもの(不確実性下での診断、文脈的な患者履歴を必要とする治療推奨、または危機的瞬間における感情的サポート)との間にあります。チャットボットは、専門家の判断を形成する具体化された臨床経験を欠いているため、症状の組み合わせを頻繁に誤解したり、現在の臨床ガイドラインから逸脱したりします。

戦略的洞察:限界を失敗として見るのではなく、設計仕様として再構成します。自信を持って能力を超えて答えるチャットボットは危険です。自身の境界を認識し、インテリジェントにエスカレーションするチャットボットは、人間の専門知識の力を倍増させます。

- 次世代トリアージのための実装アーキテクチャ:*

段階的なエスカレーション経路がバックボーンを作成します。システムが深刻な状態を示唆するクエリ(急性疾患を示す症状の組み合わせ、潜在的な薬物相互作用、または心理的苦痛のマーカー)を検出すると、遅延なくユーザーを認可されたプロバイダーに転送します。これには、答えるだけでなく、自身の能力の境界を認識するようにシステムをトレーニングする必要があります。これは聞こえるよりも難しく、真のイノベーションホワイトスペースを表しています。

- 具体的な運用ステップ:*

- 展開前の検証:患者とのやり取りの前に、査読済みの臨床ガイドラインと実世界のケーススタディに対してチャットボットの応答をテストします。エスカレーションをトリガーすべきエッジケースのライブラリを構築します。

- 継続的なパフォーマンス監視:問題のある相互作用をリアルタイムでフラグ付けし、集団全体でシステムの動作を改善するフィードバックループを作成します。これがAIが真に適応的になる場所です。

- 包括的な会話文書化:すべての相互作用が、改善、コンプライアンス、患者ニーズの新たなパターンの特定のためのデータになります。

- 集団全体でのバイアス監査:多様な人口統計グループ、社会経済的背景、健康リテラシーレベル全体で応答をテストします。医療AIにおけるバイアスは、コンプライアンスのチェックボックスではなく、患者の安全性の必須事項です。

- 透明な免責事項:チャットボットが情報提供であり、臨床判断の代替ではないことを明確に伝えることは、逆説的に、正直な期待を設定することで信頼を高めます。

長期的なビジョン:チャットボットは、質問に答えるだけでなく、どの患者が緊急介入を必要としているかを予測し、集団における新たな健康トレンドを特定し、個々の健康軌道に基づいてガイダンスをパーソナライズするインテリジェントな受付システムに進化します。これには、システムが新しいシナリオに遭遇する際の継続的な監査が必要です。チャットボットが安全に処理できない責任を段階的に引き受ける徐々のスコープクリープを防ぐためです。

医療AIにおける透明性を通じた信頼の構築:説明可能性の必須事項

AI支援医療における患者の信頼は、基本的な洞察に依存しています:不透明性は懐疑を生み、透明性はパートナーシップを構築します。多くの患者がチャットボットを信頼しないのは、AIに懐疑的だからではなく、意思決定プロセスが隠されたままだからです。効率性を彼らの幸福よりも優先するかもしれないブラックボックスです。

戦略的機会は深遠です。チャットボットが恣意的な決定を下すのではなく、エビデンスに基づくプロトコルに従っていることを患者が理解すると、エンゲージメントが深まります。彼らはアルゴリズム出力の受動的な受信者ではなく、ケアの積極的な参加者になります。コンプライアンスからコラボレーションへのこのシフトは、AIが患者とプロバイダーの関係をどのように再形成するかについての次の地平線への賭けを表しています。

透明性メカニズムがこの潜在能力を解き放ちます:

- 信頼構築のための具体的なメカニズム:*

- 明示的なAIラベリング:すべての相互作用で、AIが関与している時期を明確に識別し、信頼を侵食する欺瞞を排除します。この正直さは競争上の優位性になります。

- 平易な言葉での説明:不透明な信頼スコアの代わりに、推論を説明します:「報告された症状の組み合わせと[ソース]からの現在の臨床ガイドラインに基づいて、直接評価できる医療専門家と話すことをお勧めします。」

- データプライバシーの透明性:どのデータが収集され、どのように使用され、誰がアクセスでき、どのくらいの期間保持されるかについて、明確でアクセス可能な文書を公開します。これをコンプライアンスの負担ではなく、マーケティングの優位性にします。

- 患者コントロールメカニズム:患者に参加に対する真の主体性を与える同意ワークフローを確立します。一部の患者はオプトアウトするかもしれません。その選択を尊重することは、残る人々との信頼を構築します。

- 公的説明責任報告:医療組織は、精度率、エスカレーション頻度、患者満足度指標、人口統計の内訳を示す四半期ごとの透明性レポートを公開する必要があります。これは外部の説明責任を作成し、改善の機会を特定します。

- 実行可能な実装経路:*

- チャットボットのトレーニングデータソース、既知の限界、人間の臨床医との違いを説明する患者向けの文書を作成します。

- 患者がAI推奨の人間によるレビューを要求できるチャネルを確立し、実際にこのフィードバックを使用してシステムを改善します。

- 臨床スタッフをトレーニングして、チャットボットのケア提供における役割を説明し、専門知識を置き換えるのではなく強化するツールとして位置付けます。

- 利点と限界の両方に対処する教育資料を開発し、非現実的な期待と根拠のない懐疑の両方から患者を守ります。

- 特に代表されていない集団からの患者諮問グループを招集し、信頼危機になる前に透明性のギャップを特定します。

長期的なビジョン:透明性は、医療におけるAIに関する新しい社会契約の基盤になります。システムがどのように機能し、どのデータを使用し、どのように決定が下されるかを理解する患者は、懐疑論者ではなく支持者になります。不透明性から開放性へのこのシフトは、患者が積極的に使用することを選択するAIシステムを構築する世代的な機会を表しています。

断片化された米国AI規制環境のナビゲート:断片化から戦略的優位性へ

現在の規制環境はバグではありません。移行期のアメリカ連邦主義の特徴です。統一された連邦AI規制は存在しません。代わりに、組織は、範囲、執行メカニズム、哲学的アプローチが劇的に異なる州法、提案された法律、セクター固有の規則の複雑なパッチワークをナビゲートします。

この断片化は真のリスクを生み出しますが、体系的に考える意欲のある組織にとっては戦略的機会でもあります。カリフォルニアで準拠しているチャットボットは、コロラドの基準に違反する可能性があり、組織は管轄区域固有のガバナンスアプローチを維持するか、すべての場所で最も厳しい要件を満たすのに十分柔軟なシステムを構築する必要があります。

-

戦略的再構成:* 規制の断片化を障害として見るのではなく、先見の明のある組織はそれを自然な進化段階として認識します。環境規制が画期的なクリーンテクノロジー企業の条件を作り出したように、AIガバナンスの断片化は、コンプライアンスインフラストラクチャとガバナンス慣行におけるイノベーションを加速する可能性があります。

-

具体的な規制環境のマッピング:*

カリフォルニアの提案された規制は、透明性と影響評価を強調しています。組織がシステムを深く理解することを要求する要件です。コロラドはアルゴリズムのバイアスと公平性に焦点を当てています。他の州はデータプライバシーまたは消費者保護を優先します。全国で事業を展開する組織は、すべての管轄区域で最も厳しい要件を満たす必要があります。これは逆説的に競争上の優位性を生み出します:カリフォルニアの基準に合わせて構築する組織は、最終的に出現する連邦規制に対応する立場にあります。

- 戦略的コンプライアンスアーキテクチャ:*

- 管轄区域マッピング:各運用管轄区域における既存および提案されたAI法律を追跡する生きた文書を作成します。これは、コンプライアンスの負担だけでなく、戦略的資産になります。

- 専任のコンプライアンスリーダーシップ:規制が特定のアプリケーションにどのように適用されるかを解釈するシニアエグゼクティブを指定し、コンプライアンスの決定が法的リスク回避だけでなくビジネス戦略を反映するようにします。

- 集中追跡システム:すべての管轄区域で規制の発展を監視し、将来の連邦方向を示す新たなパターンを特定します。

- 柔軟なガバナンスフレームワーク:すべての管轄区域で最も厳しい要件に対応するシステムを構築します。これは管轄区域固有のコンプライアンスよりも難しいですが、長期的な競争上の優位性を生み出します。

- 規制機関との関係:曖昧な規定の明確化のために規制機関との真の関係を構築します。機関は、業界が意図を理解するとコンプライアンスが容易になることをますます認識しています。

- 業界連合への参加:調和を提唱する連合に参加します。規制の進化を形成する組織は、それに反応する組織よりも競争上の優位性を得ます。

- 将来を見据えた戦略的決定:* 組織は、この移行期間中に特定のコンプライアント管轄区域に特定のAIアプリケーションを地理的に制限することが正当化されるかどうかを評価する必要があります。この実用的なアプローチは、すべての50州にわたる完全なコンプライアンスが一時的に不可能である可能性があることを認めますが、コンプライアンスを真剣に受け止めていることを規制当局に示します。

長期的なビジョン:現在の断片化は、州の実験によって情報を得た連邦基準に統合される可能性があります。この移行を思慮深くナビゲートし、連邦要件を予測するガバナンス慣行を構築する組織は、競合他社が既存のシステムにコンプライアンスを後付けするのに奔走している間に、責任を持ってAIをスケールする立場に置かれます。

リスクベースのAIガバナンスフレームワークの実装:競争上の優位性としての比例監視

効果的なAIガバナンスは、潜在的な害に比例して監視を割り当てます。ウェルネスのヒントを提供するチャットボットは、雇用決定や刑事司法の結果に影響を与えるチャットボットとは根本的に異なる精査を必要とします。この洞察は、理論的には明白ですが、組織がすべてを過剰に管理するか、すべてを過小に管理する実践ではまれです。

戦略的機会:リスクベースのフレームワークは、イノベーションの速度と害の防止のバランスを最適化します。比例監視を実装する組織は、低リスクアプリケーションでより速く移動しながら、高リスクシステムで厳格な保護措置を維持します。これは、速度と信頼性を同時に通じて競争上の優位性を生み出します。

- リスク分類アーキテクチャ:*

健康、安全、市民権、財政的幸福への潜在的な影響によってアプリケーションを評価する分類システムを実装します。高リスクの展開には、厳格なテスト、多様なレビューボード、継続的な監視が必要です。低リスクのアプリケーションには、イノベーションを不必要に遅らせない軽いタッチのガバナンスが必要です。

-

具体的なリスク階層化の例:*

-

低リスク:予約をスケジュールするチャットボット(基本的な精度チェック、エスカレーションプロトコル)

-

中リスク:薬物情報を提供するチャットボット(臨床検証、バイアス監査、人間の監視)

-

高リスク:治療オプションを推奨するチャットボット(厳格な臨床検証、多様なレビューボード、継続的なパフォーマンス監視、外部説明責任)

-

各リスク層のガバナンス実装:*

- レビューボードの構成:技術、法律、倫理、ドメインの専門知識を持つボードを設立します。重要なのは、内部の利害関係者だけでなく、患者代表とコミュニティメンバーを含めることです。

- 承認ワークフロー:機密性の高いドメインに対してより厳格な文書化を必要とするワークフローを設計します。これにより、高リスクシステムが不十分な監視で通過するのを防ぎます。

- 継続的な監視:展開後のパフォーマンス低下を検出するシステムを実装します。多くのAI障害は、システムが実世界の複雑性に遭遇した後にのみ現れます。

- インシデント対応手順:システムが失敗した場合の通知、修復、学習のための明確なプロトコルを開発します。この透明性は、規制当局と患者との信頼を構築します。

- 説明責任構造:システムの動作に対する明確な責任を割り当てます。拡散した説明責任は説明責任の敵です。

- 公平性指標:技術的精度と並んで、公平性、透明性、ユーザー満足度を評価する指標を確立します。これにより、間違った目的のために最適化することを防ぎます。

- 戦略的優位性:* リスクベースのガバナンスを実装する組織は、規制手続きにおいてデューデリジェンスを実証しながら、予見可能な害を防ぎます。これは、規制が厳しくなるにつれて競争上の優位性になります。すでに準拠しているからです。

長期的なビジョン:リスクベースのガバナンスが標準的な慣行になり、組織は低リスクアプリケーションで迅速にイノベーションを起こしながら、高リスクシステムで厳格な保護措置を維持できるようになります。この比例アプローチは、どちらの極端(無謀に速く動くか、氷河のように遅く動く)よりもうまくスケールします。

連邦AI法制化への準備:不可避なものを予測する

連邦レベルでのAI規制は不可避であるが、その具体的な形態は依然として不確実である。戦略的機会は、提案された法案、政府機関のガイダンス文書、国際的な規制動向を分析することで、想定される要件を予測することにある。これらの実践を今実装する組織は、競争上の優位性と規制への準備態勢を獲得する。

- 提案に共通するテーマ:*

- データガバナンスと品質基準

- 展開前に潜在的な害を評価する影響評価

- AIが意思決定を置き換えるのではなく支援することを保証する人間による監視メカニズム

- 透明性と説明可能性の要件

- ステークホルダーのフィードバックを可能にする外部説明責任メカニズム

- 監査証跡と文書化要件

- 公平性とバイアステストプロトコル

戦略的洞察:規制は通常、責任ある組織がすでに採用しているベストプラクティスを成文化する。早期採用者は、コンプライアンスコストが低く、規制当局と顧客に対して信頼性を示し、規制が厳格化するにつれて競争優位性を獲得する。

- プロアクティブな実装経路:*

- 堅牢なデータガバナンス:データの品質、出所、プライバシー保護を保証する実践を確立する。これが他のすべての基盤となる。

- 包括的な文書化:AIシステムの設計、トレーニングデータソース、テストプロトコル、パフォーマンス指標の詳細な文書を作成する。この文書化は、規制がそれを要求するようになったときに競争優位性となる。

- 影響評価:展開前に潜在的な害を評価する包括的な評価を開発する。これにより、後の高コストな改修を防ぐ。

- 外部説明責任メカニズム:外部ステークホルダーが懸念を報告するためのチャネルを作成する。この透明性は信頼を構築し、問題を早期に特定する。

- 人間による監視プロトコル:AIが人間の意思決定を置き換えるのではなく支援することを保証するメカニズムを確立する。これは、AIが既存のプロセスを自動化するだけでなく、真に有益になる場所である。

- 説明可能性のための技術インフラ:AI の決定を人間が理解できる用語で説明できるシステムを構築する。これは聞こえるほど簡単ではなく、真のイノベーションの余地を表している。

- ベンダー管理実践:サードパーティプロバイダーがガバナンス基準を満たすことを保証する。あなたのAIは、サプライチェーンと同じくらいしか信頼できない。

- 経営幹部の説明責任:AI戦略とコンプライアンスに責任を持つ上級幹部を任命する。これは組織のコミットメントを示し、ガバナンスがコンプライアンス部門に孤立しないことを保証する。

- 戦略的関与:* 組織は、パブリックコメントプロセスや業界団体を通じて政策立案者と積極的に関与し、運用の現実に基づいた実用的な規制アプローチを形成すべきである。業界の意見を取り入れて形成された規制は、孤立して開発されたものよりも実装可能である傾向がある。

長期的ビジョン:連邦要件を予測し、それらをプロアクティブに実装する組織は、競合他社がコンプライアンスの改修に奔走する中、責任を持ってAIを拡大する立場に置かれる。これは、規制が厳格化し、顧客が信頼できるAIをますます要求するようになるにつれて、競争優位性となる。

AI開発におけるイノベーションとコンプライアンスのバランス:対立ではなく統合

技術チームは、コンプライアンスをイノベーションの敵、つまり開発を遅らせる官僚的制約と見なすことが多い。この誤った二分法は、イノベーションとコンプライアンスの両方を損なう。効果的な組織は、実験を抑制することなく、ガバナンスを開発ワークフローに統合する。

戦略的洞察:コンプライアンスとイノベーションは本質的に対立するものではない。明確なガイドラインは、何が許可されているかについての曖昧さを排除することで、実際には開発を加速する。チームは、何が許可されているかを議論する時間を減らし、構築する時間を増やす。

- アジャイルガバナンスアーキテクチャ:*

実装の柔軟性を許容しながら明確なガイドラインを提供するガバナンスを実装する。さまざまなユースケースに合わせたコンプライアンスチェックリストを作成する。技術スタッフとコンプライアンススタッフの間で定期的な接点を確立し、新たな問題が高コストな作り直しになる前に早期に対処する。

- 具体的な実装例:*

診断チャットボットを構築する開発チームは、データプライバシー、バイアステスト、臨床検証、エスカレーションプロトコルをカバーするコンプライアンスチェックリストを使用する。これにより、コンプライアンスの問題が表面化する開発後期の作り直しを防ぐ。チェックリストは、技術チームとコンプライアンスチームの間の共通言語となる。

- 統合経路:*

- プライバシー・バイ・デザインとフェアネス・バイ・デザイン:これらの原則を、後付けではなく、最初から技術アーキテクチャに組み込む。

- コンプライアンステストプロトコル:パフォーマンス指標と並行して規制コンプライアンスを評価するテストプロトコルを開発する。これにより、精度とコンプライアンスの間の誤った選択を防ぐ。

- サンドボックス環境:適切な保護措置を備えた実験用のサンドボックス環境を作成する。これにより、本番システムにリスクを与えることなく迅速な反復が可能になる。

- 技術的決定の文書化:技術的決定とトレードオフを文書化し、組織の記憶を作成し、将来の監査を可能にする。

- コンプライアンスの自動化:バイアス検出や監査証跡生成などのコンプライアンスタスクを自動化するツールに投資する。これにより、手動の負担が軽減され、一貫性が向上する。

- コンプライアンス肯定的な文化:コンプライアンスの懸念を罰するのではなく、奨励する文化を育成する。問題を早期に表面化するチームは、後の災害を防ぐ。

- スタッフトレーニング:規制環境と従業員のコンプライアンスにおける役割についてのトレーニングを提供する。コンプライアンスは、コンプライアンス部門だけでなく、全員の責任である。

- エスカレーション経路:上級リーダーシップの決定を必要とするイノベーションとコンプライアンスの対立のための明確なエスカレーション経路を確立する。これにより、行き詰まりを防ぐ。

- 戦略的優位性:* コンプライアンスを開発ワークフローに統合する組織は、コンプライアンスを別のフェーズとして扱う組織よりも速く動く。これは、規制が厳格化し、顧客が信頼できるAIをますます要求するようになるにつれて、競争優位性となる。

長期的ビジョン:コンプライアンスが組織のDNAに組み込まれ、組織が責任を持って統治しながら迅速に動くことを可能にする。この統合により、イノベーションと信頼性の間の誤った選択を防ぐ。勝利する組織は、両方を同時に行う組織である。

重要なポイントと次のアクション:移行から変革へ

ヘルスケアチャットボットは、アクセス、効率性、健康アウトカムを改善するための変革的な機会を表しているが、それは適切な保護措置と信頼性への真のコミットメントを持って展開された場合に限られる。この変革をリードする組織は、ガバナンスを制約ではなく競争優位性として見る組織である。

- 即座の戦略的アクション:*

- 既存の展開を監査する:上記で概説したフレームワークに対して現在のチャットボット実装を評価する。ギャップを特定し、是正の優先順位を付ける。

- ガバナンス構造を確立する:AI戦略とコンプライアンスに対する明確な説明責任を割り当てる。これは組織のコミットメントを示し、ガバナンスが孤立するのを防ぐ。

- 規制要件をマッピングする:運営管轄区域における既存および提案された規制を文書化する。これは長期計画を導く戦略的資産となる。

- 包括的な文書化を開始する:AIシステムを包括的に文書化し始める—トレーニングデータ、設計決定、テストプロトコル、パフォーマンス指標。この文書化は、規制コンプライアンスと継続的改善の基盤となる。

- 患者諮問関係を構築する:ガバナンスの決定に患者とコミュニティを関与させる。彼らの洞察は、組織内部からは見えない問題を特定する。

- コンプライアンスインフラに投資する:大規模なコンプライアンスを可能にするツールとプロセスを構築する。この投資は、規制が厳格化するにつれて配当を支払う。

- 戦略的ビジョン:* これらのステップを今取る組織は、真の患者と規制当局の信頼を構築しながら、責任を持ってAIを拡大する立場に置かれる。規制環境が統合され、連邦基準が出現するにつれて、早期参入者は、確立されたガバナンス実践、患者関係、実証された信頼性を通じて競争優位性を持つことになる。

ヘルスケアAIの未来は、ガバナンスとイノベーションを補完的な力として認識する組織、つまり信頼を構築しながら迅速に動き、ケアの中心に人間の判断を維持しながら責任を持って拡大する組織に属する。これらの能力を構築する時は今である。