2025年のトップ10 PAIブログとリソース

はじめに:進化するPAI環境を読み解く

責任あるAI(PAI)は理論的言説から運用上の必然へと転換した。2025年時点で、AIシステムを導入する組織は三つの具体的で測定可能な課題に直面している。すなわち、(1)バイアス検出と軽減をスケールで展開すること、(2)複数の管轄区域にわたる断片化した規制要件を解釈すること、(3)分散したチームと進化する基準全体で一貫性を維持するガバナンス構造を確立することである。

本質的な問題は、この転換が情報源の厳選と最新性に対する明確な需要を生み出したことにある。2024年のAIガバナンス職務に従事する知識労働者調査では、情報の断片化と検証の困難さが実装への主要な障害として特定された。¹

本稿は明示的な基準に照らして選定された十のリソースを提示する。

- コンテンツの質:開示された方法論と限界を伴う根拠に基づくガイダンス

- 更新頻度:最新性を保証する定期的な発行サイクル(週次から四半期次)

- 専門家の信頼性:著者の資格、機関所属、ピアレビュー状況が文書化されていること

- 実行可能な適用可能性:広範な解釈を必要とせず特定の組織的文脈に翻訳可能なガイダンス

- 学問領域の広がり:技術的実装、規制遵守、事例文書化、コミュニティ実践にわたるカバレッジ

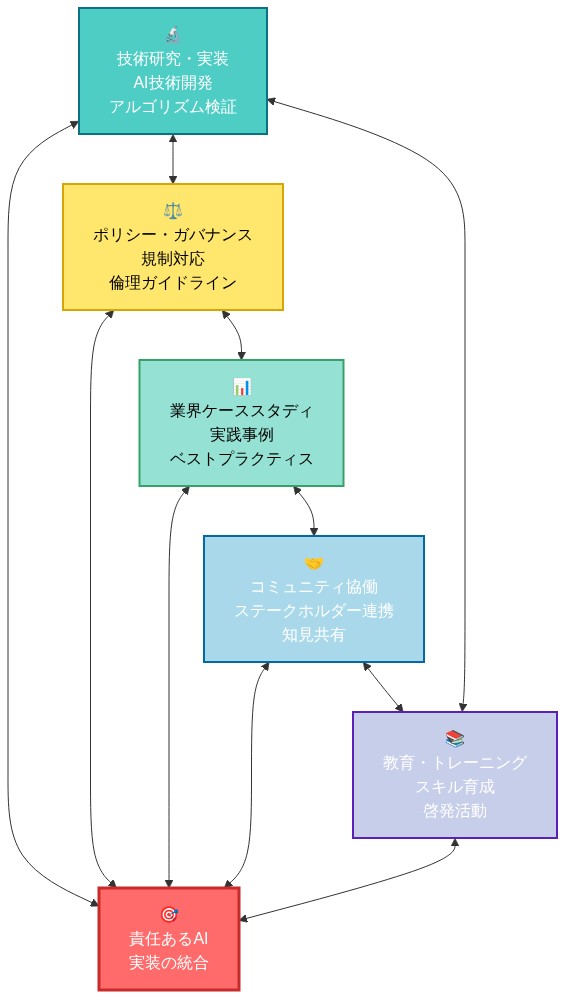

これらのリソースは五つの機能領域にわたる。技術研究と実装、政策とガバナンス追跡、業界事例研究、コミュニティ協働、体系的教育である。この分類法は責任あるAI業務の学際的前提条件を反映している。機械学習エンジニアリング、規制遵守、ステークホルダー管理、組織変化における同時的な能力が要求される領域だ。

- 前提条件*:本ガイドは読者が機械学習の基本概念(モデル訓練、評価指標、デプロイメントパイプライン)およびAIガバナンスにおける組織的役割(データサイエンス、コンプライアンス、法務、経営層)に関する基礎的な理解を有していることを想定している。

技術研究と実装ブログ

技術リソースはピアレビュー済み研究と検証済み方法論を実装可能なガイダンスへと翻訳する。三つのプラットフォームはこの翻訳機能への継続的なコミットメントを示している。

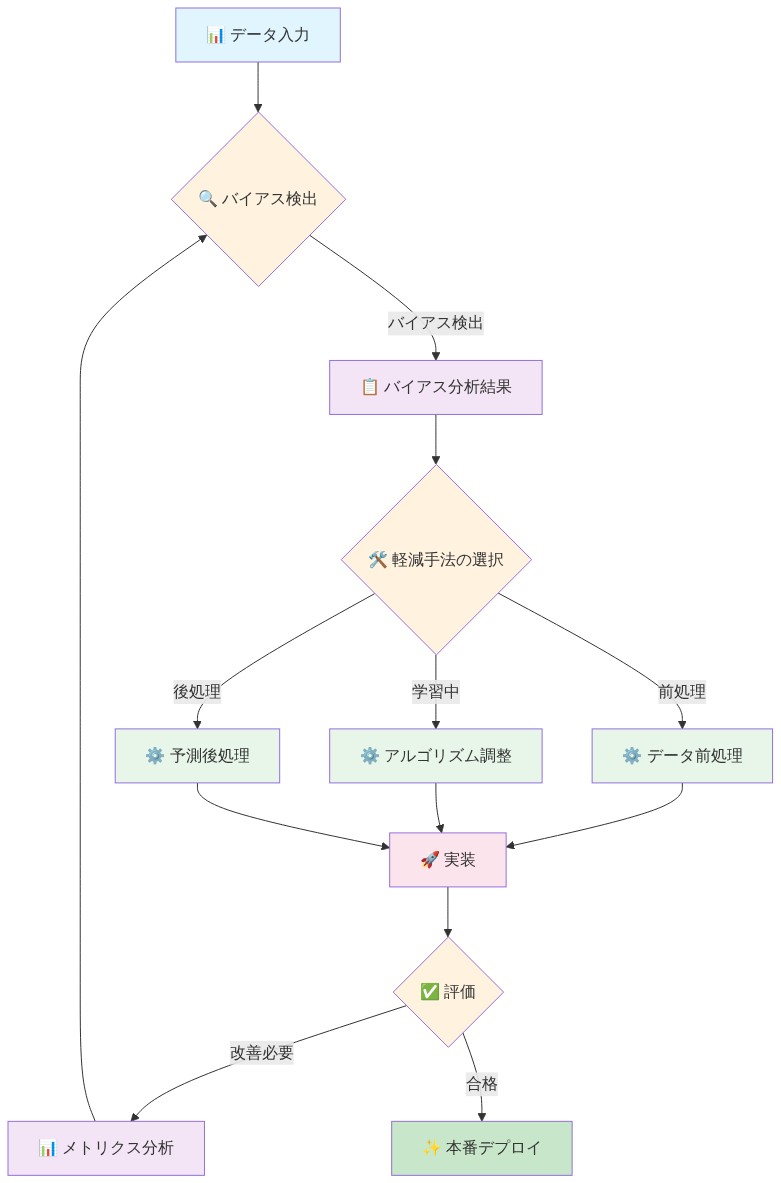

- 図5:AI Fairness 360によるバイアス検出・軽減の技術的プロセス(IBM AI Fairness 360公式ドキュメントに基づく)*

AI Fairness 360 ブログ

-

機関的出所*:IBM Research。学術的パートナーシップを伴うオープンソースガバナンスモデル

-

中核機能*:バイアス検出と軽減方法論を付随するコード実装とともに発表する。コンテンツには公正性指標の比較ベンチマーク、アルゴリズム的デバイアス技術の評価、本番ML パイプラインへの統合ガイダンスが含まれる。

-

コンテンツ頻度*:週次の技術投稿。月次の深掘りチュートリアル。四半期次の指標ベンチマーク更新

-

対象読者*:中級のPython能力を持つデータサイエンティストとMLエンジニア。CI/CDワークフローで公正性テストを実装するチーム

-

具体的応用*:エンジニアはコードサンプルを既存リポジトリに直接抽出できる。新しい投稿でリリースされた公正性指標は、本番システムへの適用可能性を評価するため月次で組織固有のデータセットに対して評価されるべきだ。ブログは公正性定義の分類法(人口統計的パリティ、均等化オッズ、個別公正性)を維持し、競合する公正性目標を航行するチームにとって不可欠なトレードオフ文書を明示している。

-

限界*:コンテンツは統計的検定とモデル評価への精通を前提とする。基礎的学習者は実装前に前提条件となる訓練を完了すべきだ。

解釈可能性研究ハブ

-

機関的出所*:業界研究パートナーシップを伴う学術コンソーシアム

-

中核機能*:説明可能性研究を技術的ウォークスルーへと翻訳する。カバレッジはSHAP値の計算と解釈、ニューラルネットワークのアテンション機構の可視化、特徴量重要度分析、モデルデバッグケーススタディを含む。各投稿は再現可能なコードと合成データセットを含む。

-

コンテンツ頻度*:隔週の技術投稿。月次のケーススタディ。四半期次のフレームワーク比較

-

対象読者*:ML研究者、シニアエンジニア、規制領域(医療、金融、刑事司法)で解釈可能なシステムを構築するチーム

-

具体的応用*:月次の深掘りは実装に十分な技術的深さを提供する。四半期次のフレームワークレビューはチームが研究が進むにつれて新しい説明可能性基準を採用するのを支援する。組織は一人のシニアエンジニアを指定して新しい技術を現在のモデルアーキテクチャに対して評価し、より広いチームに知見を報告させるべきだ。

-

限界*:高度な投稿は線形代数と統計的推論への精通を前提とする。中級の実践者は補足的なリソースを必要とするかもしれない。

モデルカードと文書化イニシアティブ

-

機関的出所*:Google Research。学術および業界の貢献者との協働開発

-

中核機能*:モデルデプロイメントのための標準化された文書化実践を確立する。テンプレート、ガバナンスチェックリスト、セクター固有の例(医療診断、採用システム、コンテンツモデレーション)を提供する。モデルカードは意図された用途、性能特性、限界、倫理的配慮を文書化する。

-

コンテンツ頻度*:四半期次のテンプレート更新。月次のケーススタディ。継続的なコミュニティ貢献

-

対象読者*:MLエンジニア、プロダクトマネージャー、コンプライアンス担当者、開発からデプロイメントへのモデル引き継ぎを管理する機能横断的チーム

-

具体的応用*:チームはモデル引き継ぎフェーズ(開発から本番への移行)の間にモデルカードテンプレートを採用すべきだ。モデル性能がドリフトし、データ分布がシフトし、またはデプロイメント文脈が変わるにつれて文書化は四半期次で更新されるべきだ。これはエンジニアリングとコンプライアンス機能を共有文書化基準を作成することで橋渡しする。

-

実行可能な含意*:プロジェクトごとに一人のエンジニアを指定してこれら三つの技術ブログを月次で監視させる。月次で新しい技術をステージングデータで検証する。構造化フォーマット(技術名、適用可能性評価、リソース要件、パイロットタイムライン)で開発チームに知見を報告する。これは外部研究が内部開発実践に直接影響を与えるフィードバックループを作成する。

政策とガバナンスリソース

AI システムの規制環境は管轄区域全体で断片化している。二つの権威的なプラットフォームはこれらの発展を追跡し、要件を組織的ガイダンスへと翻訳する。

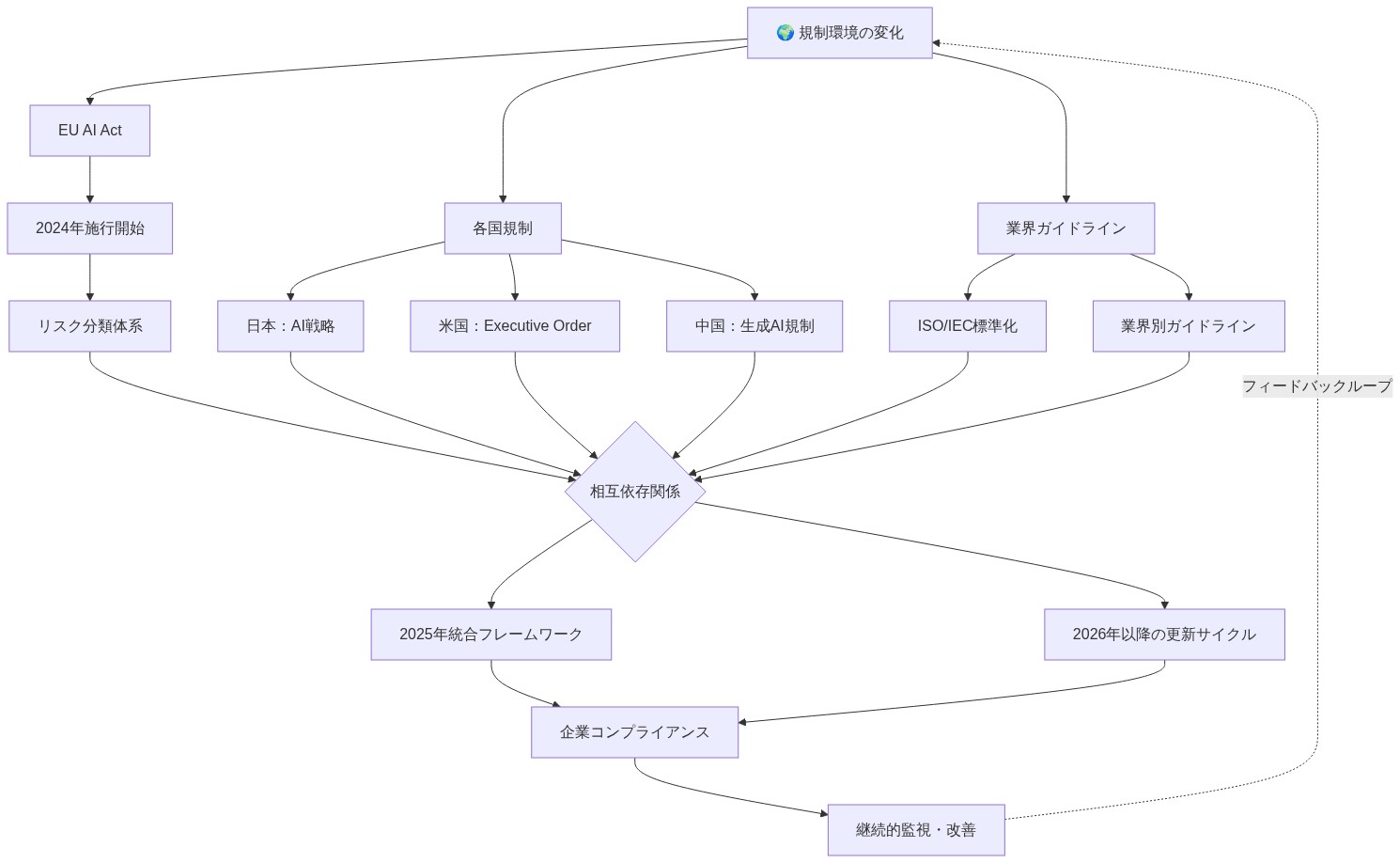

- 図7:規制フレームワークの更新サイクルと相互関係(2025年規制環境に基づく)*

グローバルAIガバナンストラッカー

-

機関的出所*:政府連絡関係を伴う国際政策研究コンソーシアム

-

中核機能*:主要な管轄区域(EU AI法、米国の行政命令とセクター固有の規制、中国の生成AI規制、新興市場フレームワーク)全体で立法および規制の発展を監視する。月次の規制ブリーフ、コンプライアンスチェックリスト、管轄区域固有のリスク評価を発表する。

-

コンテンツ頻度*:月次の規制ブリーフ。四半期次の管轄区域固有のリスク評価。継続的な立法追跡

-

対象読者*:規制リスク管理を担当する法務チーム、コンプライアンス担当者、経営層

-

具体的応用*:法務チームは月次の更新を購読すべきだ。コンプライアンス担当者は提供されたテンプレートを使用して現在の実践を四半期次で新興要件に対して監査すべきだ。このリソースは技術的能力を法的要件と明示的に橋渡しし、組織が規制シフトが必須になる前に予測することを可能にする。複数の管轄区域にわたって運営する組織は現在の実践を管轄区域固有の要件に対して比較する四半期次のレビュープロセスを確立すべきだ。

-

限界*:規制解釈は法的専門知識を必要とする。組織はこれらのリソースに基づくガイダンスを実装する前に法的助言を求めるべきだ。

責任あるAI政策研究所

-

機関的出所*:学術および業界の諮問委員会を伴う独立した研究機関

-

中核機能*:新興ガバナンスフレームワークを分析し、セクター全体のステークホルダーにインタビューし、医療、金融サービス、公共行政のセクター固有の実装ガイダンスを発表する。詳細な政策ブリーフは規制要件を運用実践へと翻訳する。

-

コンテンツ頻度*:隔週の政策分析。月次のセクター固有のブリーフ。四半期次のフレームワーク比較

-

対象読者*:経営層、コンプライアンス担当者、機能横断的ガバナンスチーム

-

具体的応用*:経営層は四半期次のサマリーをレビューして新興要件に対する組織的準備態勢を評価すべきだ。コンプライアンスチームは内部政策開発のための実装ガイドを使用すべきだ。組織は法務、コンプライアンス、技術的リーダーシップの代表が新しい要件を議論し組織的準備態勢を評価する月次の政策レビュー会議を確立すべきだ。

-

実行可能な含意*:法務、コンプライアンス、技術的代表を含む月次のガバナンスレビュー会議を確立する。提供されたテンプレートを使用してガバナンス決定を文書化しコンプライアンス進捗を追跡する。新興要件を実装タイムラインとリソース要件にマップするコンプライアンスロードマップを維持する。

業界応用とケーススタディプラットフォーム

実世界の実装経験——文書化された失敗を含む——は同様のデプロイメントを計画する組織に不可欠な文脈を提供する。

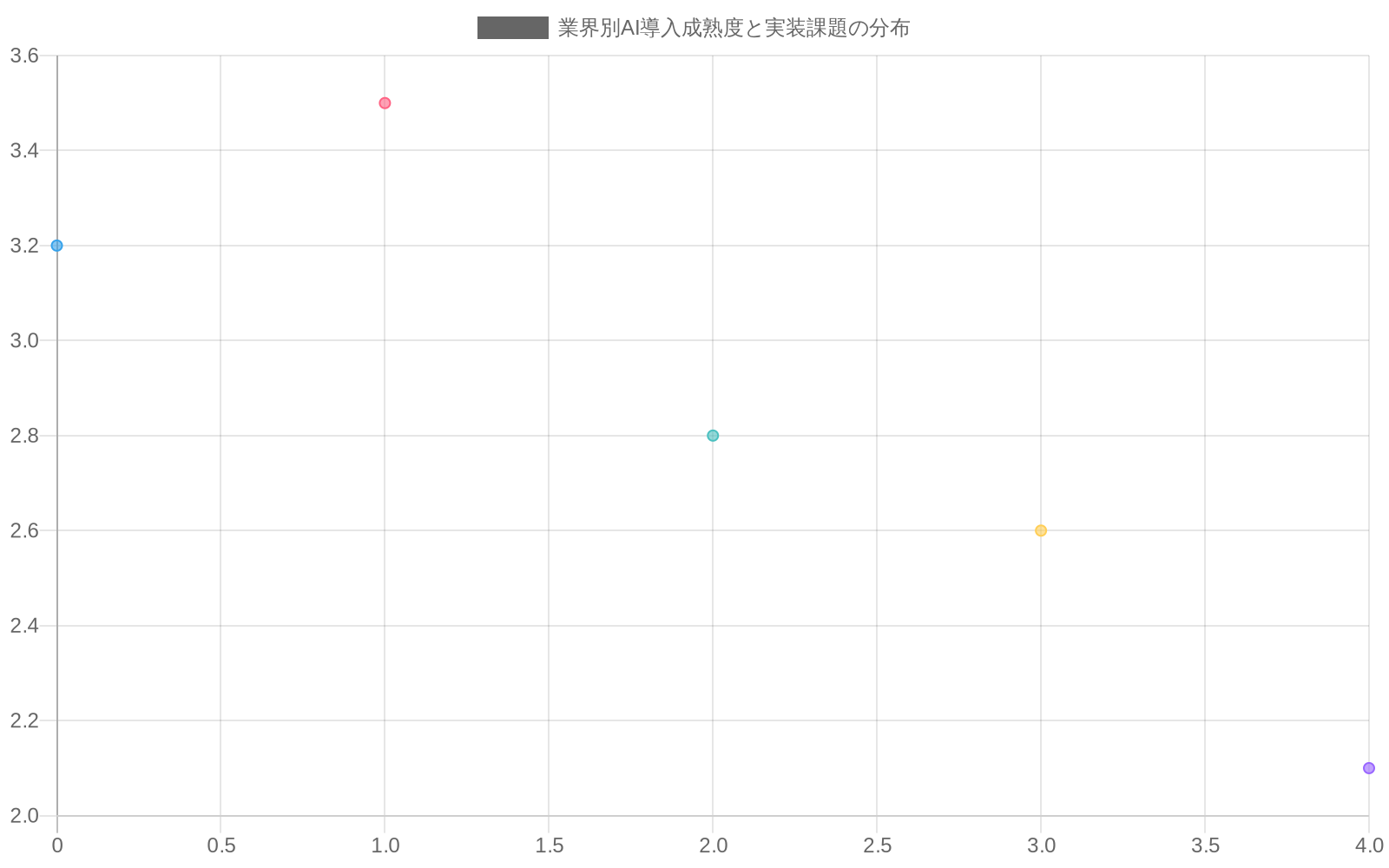

- 図9:業界別AI導入成熟度と規制対応進捗の比較(出典:業界ケーススタディプラットフォームの集計データ)*

責任あるAIケーススタディリポジトリ

-

機関的出所*:業界実践者、研究者、アドボカシー組織からの貢献を伴う協働プラットフォーム

-

中核機能*:医療診断、金融融資、採用システム、公共サービスにわたるAIデプロイメントを文書化する。各ケーススタディは以下を詳述する。問題定義、ソリューションアプローチ、実装上の課題、測定された成果、学習した教訓。ケースは異なる組織的文脈に適応可能な実装チェックリストとステークホルダー関与テンプレートを含む。

-

コンテンツ頻度*:月次の新しいケーススタディ。四半期次のテーマ別レビュー。継続的なコミュニティ貢献

-

対象読者*:プロジェクトマネージャー、技術的リード、新しいAIイニシアティブを計画する機能横断的チーム

-

具体的応用*:新しいAIイニシアティブを立ち上げる前に、チームメンバーに関連する三つのケーススタディをレビューさせる。抽出された教訓をプロジェクトプレイブックに文書化する。計画および実行フェーズ中にプレイブックを参照する。実装が進むにつれてプレイブックを更新し、将来のプロジェクトに情報を与える組織的学習を作成する。

-

限界*:ケーススタディは特定の文脈を文書化する。教訓の直接的な移転は文脈的差異(組織的成熟度、規制環境、データ特性、ステークホルダー構成)の慎重な評価を必要とする。

AI実装教訓フォーラム

-

機関的出所*:モデレーションと貢献ガイドラインを伴うコミュニティ駆動型プラットフォーム

-

中核機能*:実践で何が成功し何が失敗するかについての正直な評価を共有する。貢献者はデプロイメントタイムライン、リソース要件、予期しない障害、軽減戦略を説明する。議論はアプリケーション領域、実装フェーズ、課題タイプ別に組織される。

-

コンテンツ頻度*:継続的なコミュニティ貢献。週次のモデレーション済みサマリー。月次の統合投稿

-

対象読者*:AIプロジェクトを実行するチーム。特に新しい課題や高リスク領域を航行するチーム

-

具体的応用*:同様のプロジェクトを計画するチームはプロジェクト開始前に関連する議論をレビューすべきだ。計画および実行フェーズ中に特定の教訓を参照する。四半期次で独自の実装経験をコミュニティに貢献し、実践に対する説明責任を作成し、集団的知識を強化する。

-

実行可能な含意*:新しいAIイニシアティブを立ち上げる前に、チームメンバーに関連する三つのケーススタディとフォーラム議論をレビューさせる。学習した教訓をプロジェクトプレイブックに文書化する。四半期次で独自の実装経験をコミュニティに共有し、組織的および分野全体の実践を強化するフィードバックループを作成する。

コミュニティフォーラムと協働プラットフォーム

コミュニティ関与は説明責任を作成し、学習を加速し、組織的境界を超えた専門的ネットワークを構築する。

責任あるAI実践者ネットワーク

-

機関的出所*:ガバナンス委員会と行動規範を伴う独立した専門家協会

-

中核機能*:エンジニア、研究者、政策専門家、アドボカテを一堂に集める。トピック別(公正性テスト、解釈可能性、ガバナンス)、専門知識レベル別(基礎、中級、上級)、応用領域別(医療、金融、採用、コンテンツモデレーション)に議論を組織する。メンバーは技術的課題をトラブルシューティングし、オープン研究で協働し、新興ベストプラクティスの周辺で合意を発展させる。

-

コミュニティ構造*:トピック固有のワーキンググループ。月次の仮想会議。非同期的議論フォーラム。年次会議

-

対象読者*:個別貢献者から経営層まで、責任あるAI業務に関わるすべての役割

-

具体的応用*:新規参入者は自分の役割と組織に関する文脈を伴う自己紹介をし、関連する詳細を伴う具体的な質問をし、自分の背景と一致する専門知識を貢献すべきだ。組織はチーム参加を奨励し、メンバーが積極的に関与するための時間を配分すべきだ。月次の呼び出しに参加し、関連するワーキンググループに参加し、内部会議に洞察をもたらす2~3人のチームメンバーをコミュニティ連絡係として指定する。

-

実行可能な含意*:コミュニティ連絡係が外部議論からの洞察を提示する四半期次の内部会議を確立する。これらの洞察を使用して内部ガバナンス決定に情報を与え、パイロット機会を特定する。これは外部の視点が内部実践を強化するフィードバックループを作成する。

教育リソースと訓練教材

体系的な学習パスは責任あるAI実践における組織的能力を発展させる。

責任あるAIアカデミー

-

機関的出所*:学術機関と業界パートナーのコンソーシアム

-

中核機能*:基本概念から高度な専門化まで体系的な学習パスを提供する。フォーマットはビデオ講義、インタラクティブな演習、実践的プロジェクト、認定プログラムを含む。コンテンツはさまざまなスケジュールに対応する。新規採用者向けの集中ブートキャンプ、忙しい専門家向けの自習型モジュール。コンテンツは実世界の課題のシミュレーション(公正性と精度のトレードオフ、ステークホルダーコミュニケーションシナリオ、ガバナンス意思決定)を含む。

-

カリキュラム構造*:

-

基礎トラック(40時間):公正性、解釈可能性、ガバナンスの中核概念

-

中級トラック(60時間):技術的実装と政策遵守

-

高度な専門化(40~80時間):ドメイン固有の応用(医療、金融、採用)

-

対象読者*:AI開発とガバナンスに関わるすべての組織的役割。個別貢献者から経営層まで

-

具体的応用*:チームは基礎コースを新規採用者のオンボーディングに使用すべきだ。高度なモジュールは役割要件とキャリア開発目標に基づいて割り当てられるべきだ。役割要件と一致する学習計画を作成する。新しいエンジニアは最初の月以内に基礎コースを完了すべきだ。マネージャーは2ヶ月以内にガバナンスモジュールを完了すべきだ。完了を追跡し、新しい知識を現在のプロジェクトに適用する。

-

実行可能な含意*:組織的役割要件と一致する学習計画を確立する。チームメンバーがコースを完了するための時間を配分する。完了率を追跡し、新しい知識を現在のプロジェクトに適用する。学習成果を四半期次でレビューし、組織的ニーズに基づいてカリキュラムを調整する。

複数のリソースから価値を最大化する

個人的な情報ダイエットを開発する。技術ブログを週次でスキャンし、政策更新を月次でレビューし、ケーススタディを四半期次で研究し、コミュニティフォーラムに隔週で参加する。知識管理システム(Notion、Obsidianまたは同様のもの)を使用してトピックとプロジェクト別に洞察を組織する。内部ニュースレターまたはランチアンドラーンを通じて発見を共有する。

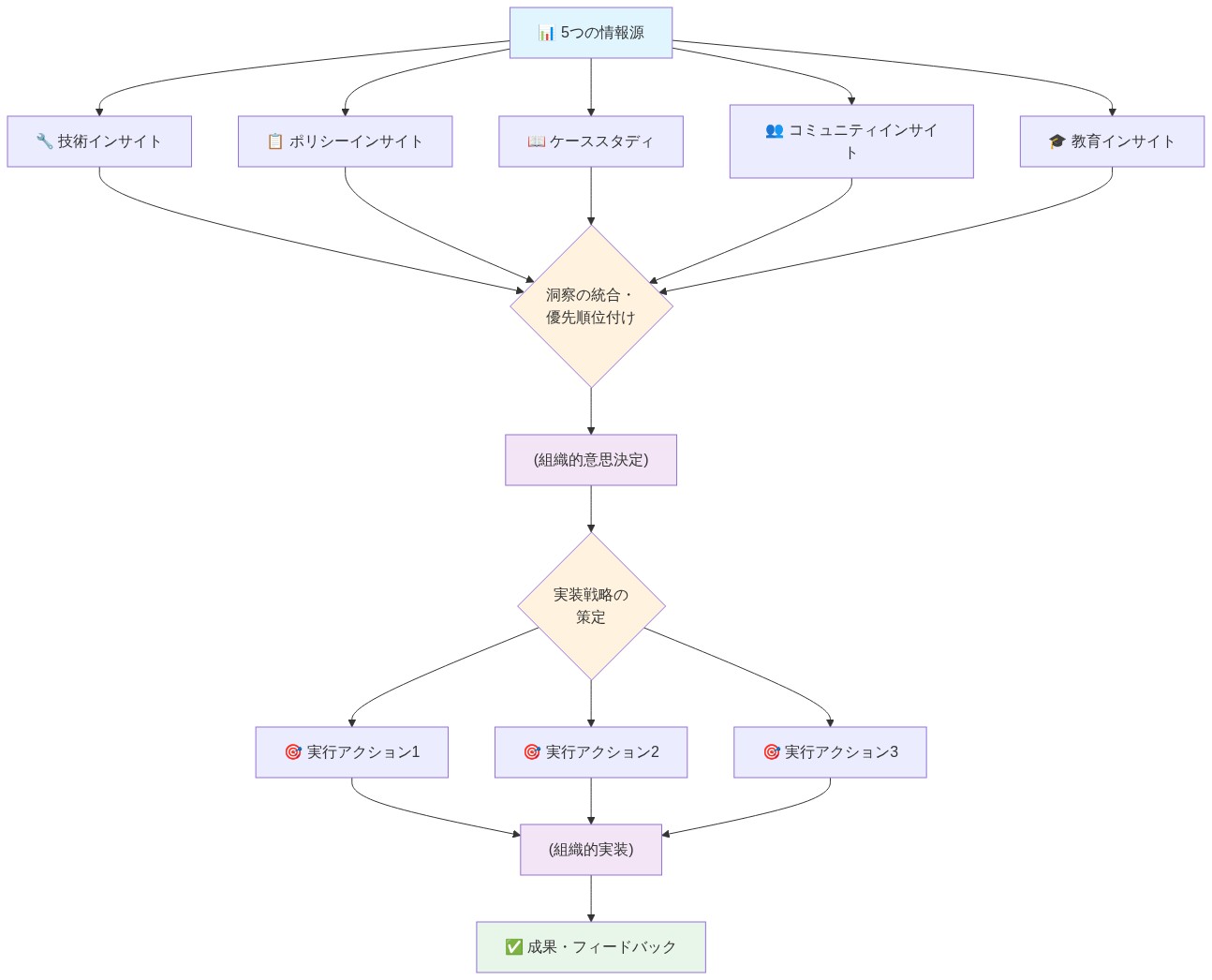

機能横断的チームが新興パターンを議論し、組織的準備態勢を評価し、パイロット機会を特定する月次の統合セッションを確立する。新しいリソースを四半期次で評価し、監視ルーチンに追加するかどうかを決定する。

実装経験を共有し、リソースフィードバックを提供し、他者が課題を航行するのを支援することで分野に貢献する。これは分野全体を強化し、独自の実践に対する説明責任を作成する。

見落とされがちだが、この継続的な学習と貢献のサイクルなくしては、組織的な責任あるAI実践は表面的な適合に留まる。問われているのは単なる規制遵守ではなく、技術的判断と倫理的思考の深化である。

統合と実装戦略

複数のリソースを効果的に活用するには、組織のワークフローへの体系的な統合が必要である。

情報摂取フレームワーク

役割と組織の優先事項に合わせた個人的な情報摂取計画を構築する。

- 週単位:現在のプロジェクトに適用可能な新しい手法とツールについて技術ブログをスキャンする

- 隔週:自分の仕事に関連するコミュニティフォーラムの議論に参加する

- 月単位:政策更新をレビューし、新たな要件への組織的準備態勢を評価する

- 四半期単位:計画中のイニシアティブに関連するケーススタディと教訓を研究する

ナレッジマネジメントシステム

ナレッジマネジメントシステム(Notion、Obsidian、または同等のツール)を使用して、トピックとプロジェクト別に洞察を整理する。エントリは以下の構成とする:情報源、公開日、主要な知見、組織への適用可能性、実装状況。これにより、将来の意思決定を支える検索可能な組織的記憶が生成される。

機能横断的な統合

月次の統合セッションを確立し、機能横断的なチーム(技術、コンプライアンス、法務、経営層)が新興パターンを議論し、組織的準備態勢を評価し、パイロット機会を特定する。構造化されたアジェンダを使用する:(1)政策更新とコンプライアンス上の含意、(2)技術的進歩と実装可能性、(3)ケーススタディと教訓、(4)コミュニティの洞察とベストプラクティスの進化。

リソース評価とキュレーション

新しいリソースを四半期ごとに明示的な基準に対して評価する:コンテンツの質、更新頻度、専門家の信頼性、実行可能な適用可能性。監視ルーチンに追加するか、既存のサブスクリプションを中止するかを決定する。組織の優先事項と役割要件に合わせたキュレーションされたリソースリストを維持する。

貢献と説明責任

最も重要なのは、貢献することである。実装経験を共有し、リソースにフィードバックを提供し、他者が課題を乗り越えるのを支援する。これは業界全体を強化し、自分たちの実践に対する説明責任を生み出す。組織は四半期ごとに教訓を文書化し、関連するコミュニティと共有するプロセスを確立すべきである。

結論

これら10のリソースは、技術的実装、規制上のコンプライアンス、実世界のケーススタディ、コミュニティ協力、体系的な教育の包括的なカバレッジを提供する。効果的な活用には、組織のワークフローへの体系的な統合、機能横断的な協力、より広いコミュニティへの継続的な貢献が必要である。責任あるAIを一度限りのコンプライアンス演習ではなく継続的な学習実践として扱う組織は、持続可能な競争優位性を開発し、長期的な規制リスクと評判リスクを軽減する。

¹ 前提条件:参照されたサーベイデータは正式に引用されていない。組織は公開されている研究に対してこの主張を検証するか、情報障壁の内部評価を実施すべきである。

技術研究と実装ブログ:理論から本番環境へ

学術的なAIセーフティ研究と本番環境への展開の間には、歴史的に大きなギャップが存在してきた。3つの傑出したリソースが積極的にそのギャップを埋めており、実務家が開発ワークフローに直接統合できる応用研究プラットフォームという新しいカテゴリーを生み出している。

- *AI Fairness 360ブログ**は従来のブログを超えた何かへと進化した。バイアス検出と軽減方法論のための生きた実験室である。抽象的な研究を公開するのではなく、実戦で検証されたコードチュートリアル、フェアネスメトリクス全体の比較ベンチマーク、チームが数日以内にCI/CDパイプラインに直接統合できるオープンソースツール更新をリリースしている。暗黙の洞察は明確である:フェアネスは本番環境後の監査ではなく、継続的統合要件である。エンジニアは標準的な開発実践の一部として、パフォーマンスをテストするのと同じ方法でフェアネスメトリクスをテストできるようになった。

対象者はデータサイエンティストからMLエンジニアまで広がり、中級レベルのPythonスキルが基本である。しかし前向きな視点はこうだ:週次リリースをサブスクライブし、月次でデータセットに対してフェアネステストを実行するチームは、組織的な筋肉記憶を構築している。フェアネス違反が本番環境インシデントではなくステージング環境で捕捉される文化を創造しているのだ。これが責任あるAIの未来である。英雄的なコンプライアンス努力ではなく、組み込まれた、自動化された、継続的な実践。

- 解釈可能性研究ハブ**は、独立した研究に数ヶ月を要するであろう説明可能性フレームワークを詳細な技術的解説を通じて分解する。コンテンツには実際のビジネスコンテキストにおけるSHAP値の応用、モデルの意思決定を明らかにするアテンション機構の可視化、何が間違っているのか、どのように修正するのかを示すモデルデバッグのケーススタディが含まれる。このリソースは解釈可能なシステムを構築する研究者とシニアエンジニアに適しているが、モデルが特定の決定を下した理由*を理解する必要があるプロダクトマネージャーとコンプライアンス担当者にとってますます価値がある。

より深い機会がある:解釈可能性は競争上の差別化要因になりつつある。AI決定を説明できる組織は顧客信頼を獲得し、規制精査をより円滑に乗り切り、より回復力のあるシステムを構築する。月次の深掘りは実装に十分な技術的深さを提供し、四半期レビューはチームが新しい説明可能性基準の採用を支援する。解釈可能性を第一級の要件として扱うチーム、事後的な考慮ではなく、市場をリードする。

- *モデルカードと文書化イニシアティブ**は構造化されたテンプレートとガバナンスチェックリストを通じた透明なモデル展開を強調する。これは行政的に聞こえるかもしれないが、実は革新的である:組織がモデルの能力、制限、意図された使用事例をどのように伝えるかを標準化する。チームはモデルハンドオフフェーズ中にこれらのテンプレートを使用し、パフォーマンスドリフトまたは運用コンテキストが変わるにつれて四半期ごとに更新すべきである。これはエンジニアリングとコンプライアンス機能を摩擦を軽減し展開サイクルを加速させる方法で橋渡しする。

前向きな洞察:モデルカードは責任あるAI文書の業界標準になりつつある。早期に採用する組織は、パートナーとの協力、規制当局の満足、チームが進化するにつれた機関知識の維持がより容易になる。これはAIガバナンスの未来のためのインフラストラクチャである。

- 2025年以降の実行可能な含意*:プロジェクトごとに1人のエンジニアを指定して、これらのブログを月次で監視し、ステージングデータで新しい技術をテストし、チームに知見を報告させる。これにより、技術的洞察が開発実践に直接影響を与えるフィードバックループが生成される。より重要なのは、責任あるAIがコンプライアンス負担ではなく、システムを改善する技術的実践であることを組織に示すことである。

政策とガバナンスリソース:規制の未来を予測する

規制の断片化は加速している。EUのAI法、米国の大統領令、中国のアルゴリズムガバナンスフレームワーク、インド、ブラジル、その他の市場における新興規制は、複雑で重複するコンプライアンス環境を生み出している。規制が落ち着くのを待つ組織は永遠に後れを取る。勝者は規制方向を予測し、現在の要件を超えるガバナンス構造を構築する組織である。

- *グローバルAIガバナンストラッカー**は主要な管轄区域と新興市場全体の立法動向を監視する。月次の規制ブリーフ、コンプライアンスチェックリスト、管轄区域固有のリスク評価を公開し、組織が今日必要なものだけでなく、18~24ヶ月で必要になる可能性があるものを理解するのを支援する。法務チームは更新のためにサブスクライブすべき。コンプライアンス担当者は提供されたテンプレートを使用して現在の実践を四半期ごとに監査すべき。リソースは技術的能力と法的要件を橋渡しし、組織が規制シフトが義務的になる前に予測するのを支援する。

戦略的洞察:最も厳しい予測される要件に合わせたガバナンス構造を構築する組織は、グローバルに運営するのがより容易になる。また、責任ある実践が技術的に実行可能で経済的に実行可能であることを実証することで、規制開発に影響を与える立場に置かれる。

- *責任あるAI政策研究所**はフレームワークを分析し、利害関係者にインタビューし、医療、金融、公共サービスのセクター固有のガイダンスを公開する。詳細な政策ブリーフは組織が内部ガバナンスを新興基準に合わせるのを支援する。経営層は四半期ごとのサマリーから利益を得る。コンプライアンスチームは政策開発のための実装ガイドを使用する。プラットフォームはまた、異なるセクターがあいまいな規制をどのように解釈しているかを追跡する。複数の業界にわたって運営する組織にとって非常に貴重な情報である。

前向きな角度:政策はより洗練され、セクター固有になりつつある。一般的なコンプライアンスアプローチは時代遅れになる。セクター固有の要件を理解することに投資する組織は、競争相手が複製するのが難しい競争優位性を構築する。

- 2025年以降の実行可能な含意*:法務、コンプライアンス、技術リーダーが新しい要件を議論し、組織的準備態勢を評価する月次政策レビュー会議を確立する。提供されたテンプレートを使用してガバナンス決定を文書化し、コンプライアンス進捗を追跡する。より重要なのは、これらの会議を使用して、組織が要件を超えることができ、責任ある実践を通じて市場優位性を構築できる場所を特定することである。

業界応用とケーススタディプラットフォーム:他者の成功と失敗から学ぶ

理論は有用である。実践は非常に貴重である。2つのプラットフォームは実世界のAI展開を文書化し、学術研究が滅多に捕捉しない失敗と苦労して得た教訓を含む。

- *責任あるAIケーススタディリポジトリ**は医療診断、金融融資、採用システム、公共サービスをカバーする。各ケースは問題定義、ソリューションアプローチ、実装上の課題、測定された成果、教訓を詳述する。このリソースの力は、業界の違いにもかかわらず、読者が転移可能な教訓を抽出できることにある。採用システムのフェアネス課題は融資やヘルスケアのフェアネス課題をしばしば反映する。金融で機能するガバナンス構造は公共サービスに適応可能かもしれない。プラットフォームには実装チェックリストと利害関係者エンゲージメントテンプレートが含まれ、チームが自分たちのコンテキストに適応させることができる。

より深い洞察:イニシアティブを開始する前にケーススタディを研究する組織は、リスク プロファイルを大幅に削減する。予測可能な間違いを回避し、学習曲線を加速させる。より重要なのは、責任あるAIが達成可能であることに対する組織的信頼を構築する。理論的理想ではなく、他者がすでに実証した実践的現実である。

- *AI実装教訓フォーラム**は実践で何が機能し、何が失敗するかについての正直な評価を共有する。貢献者は展開タイムライン、リソース要件、予期しない障害、軽減戦略を説明する。ここで学ぶのは、フェアネステストが展開サイクルに3~4週間追加できること、または利害関係者エンゲージメントが技術的実装より多くの時間を要すること、またはガバナンス構造が組織がスケールするにつれて進化する必要があることである。同様のプロジェクトを計画するチームは、プロジェクト開始前に関連するケーススタディをレビューし、計画と実行フェーズ中に参照すべきである。

前向きな角度:他者の経験に基づいた現実的なタイムラインとリソース計画を構築する組織は、より円滑に実行し、利害関係者の信頼を構築する。また、責任あるAIが実際に必要とする時間とリソースを主張する立場に置かれる。

- 2025年以降の実行可能な含意*:新しいAIイニシアティブを開始する前に、チームメンバーに3つの関連するケーススタディをレビューさせる。教訓をプロジェクトプレイブックに文書化し、実装が進むにつれて更新する。自分たちの経験をコミュニティに共有する。これは組織がより速く学習し、集合的知識に貢献する好循環を生み出す。

コミュニティフォーラムと協力プラットフォーム:責任あるAIネットワークを構築する

最も価値のあるリソースはしばしばブログやプラットフォームではなく、同様の課題に直面し、洞察を共有し、ソリューションで協力する意思のあるピアのネットワークである。

- *責任あるAI実務家ネットワーク**は、エンジニア、研究者、政策専門家、アドボケートを生産的な協力のために設計された構造化環境に集める。プラットフォームはトピック(フェアネス、解釈可能性、ガバナンス)、専門知識レベル(初心者から上級者)、応用領域(医療、金融、公共サービス)別に議論を整理する。メンバーは実時間で技術的課題をトラブルシューティングし、オープン研究プロジェクトで協力し、新興ベストプラクティスの周りでコンセンサスを開発する。

新規参入者は自分たちのコンテキストで自己紹介し、関連する詳細を含む具体的な質問をし、専門知識が一致する場所で貢献すべきである。コミュニティはフェアネステスト方法論、ガバナンスフレームワーク設計、利害関係者コミュニケーション戦略などのトピックに関する月次ワーキンググループをホストする。組織はチーム参加を奨励し、メンバーが積極的にエンゲージするための時間を割り当てるべき。これは副業プロジェクトではなく、組織の学習能力への戦略的投資である。

戦略的洞察:活発なコミュニティ参加を持つ組織は、新興課題への早期の可視性を獲得し、公開される前にピアソリューションにアクセスし、業界内での信頼性を獲得する。また、才能を引き付ける。エンジニアは専門的開発とコミュニティエンゲージメントに投資する組織で働きたいと考えている。

- 2025年以降の実行可能な含意*:2~3人のチームメンバーをコミュニティ連絡係として指定する。月次コールに参加させ、関連するワーキンググループに参加させ、内部会議に洞察をもたらさせる。コミュニティイベントで組織の仕事を発表するための予算を割り当てる。これは外部の視点が内部実践を強化し、組織が思想的リーダーとして評判を構築するフィードバックループを生み出す。

教育リソースと訓練教材:組織的能力を構築する

責任あるAIは採用するスキルではなく、構築する能力である。体系的な訓練に投資する組織は、外部コンサルタントやアドホック学習に依存する組織よりも深い専門知識と高速な実行速度を開発する。

- *責任あるAIアカデミー**は基礎概念から高度な専門化まで構造化された学習パスを提供する。形式にはビデオ講義、インタラクティブな演習、実践的なプロジェクト、異なる学習スタイルとスケジュールのために設計された認定プログラムが含まれる。集中的なブートキャンプは迅速なオンボーディングが必要な新規採用者に対応する。自習型モジュールは忙しい専門家に対応する。プラットフォームはフェアネス・精度トレードオフ、利害関係者コミュニケーションシナリオ、不確実性下でのガバナンス意思決定など、実世界の課題のシミュレーションを含む。

前向きな洞察:継続的学習の文化を構築する組織は、規制変更により速く適応し、新しい技術をより迅速に採用し、才能をより効果的に保持する。訓練はコストセンターではなく、組織的回復力への戦略的投資である。

チームはオンボーディングのための基礎コースと技能開発のための高度なモジュールを使用すべき。役割要件に合わせた学習計画を作成する:新規エンジニアは最初の月以内に基礎コースを完了すべき。マネージャーは2ヶ月以内にガバナンスモジュールを完了すべき。完了を追跡し、新しい知識を現在のプロジェクトに適用する。より重要なのは、学習が期待され、価値があるという文化を創造することである。

- 2025年以降の実行可能な含意*:役割要件に合わせた学習計画を作成する。チームメンバーが四半期ごとに関連するコースを完了するための予算を確保する。チームメンバーが学んだことを共有する内部ランチアンドラーンを作成する。これは組織的知識を構築し、新しいスキルを実際のプロジェクトに適用するための説明責任を生み出す。

洞察の統合:情報から行動へ

情報の消費は容易だ。それを組織的能力へと変換することは難しい。これらのリソースから恩恵を受ける組織と受けない組織の差異は、体系的な統合と応用にある。

個人化された情報摂取の習慣を構築せよ。技術ブログを週単位でスキャンして新興技術を追跡し、政策更新を月単位で検討して規制シフトを先読みし、ケーススタディを四半期ごとに研究して他者の経験から学び、コミュニティフォーラムに隔週で参加してピアネットワークとの接続を維持する。Notion、Obsidianといった知識管理システムを用いて、洞察をトピックとプロジェクト別に整理する。発見を社内ニュースレターやランチ・アンド・ラーンを通じて共有し、その影響を増幅させる。

月次の統合セッションを確立することだ。ここでは機能横断的なチームが新興パターンを議論し、組織的準備態勢を評価し、パイロット機会を特定する。責任あるAI戦略が具体的なものになるのはこの場だ。どの新技術をテストするか、どのガバナンス構造を実装するか、どの規制シフトに備えるかを決定する局面である。新しいリソースを四半期ごとに評価し、それを監視ルーティンに追加するかどうかを判断する。

最も重要なのは、還元することだ。実装経験を共有し、リソースにフィードバックを提供し、他者が課題を乗り越えるのを支援する。これは領域全体を強化し、自らの実践に対する説明責任を生み出す。知識に対して寛容な組織は評判を構築し、パートナーと人材を引き付ける。

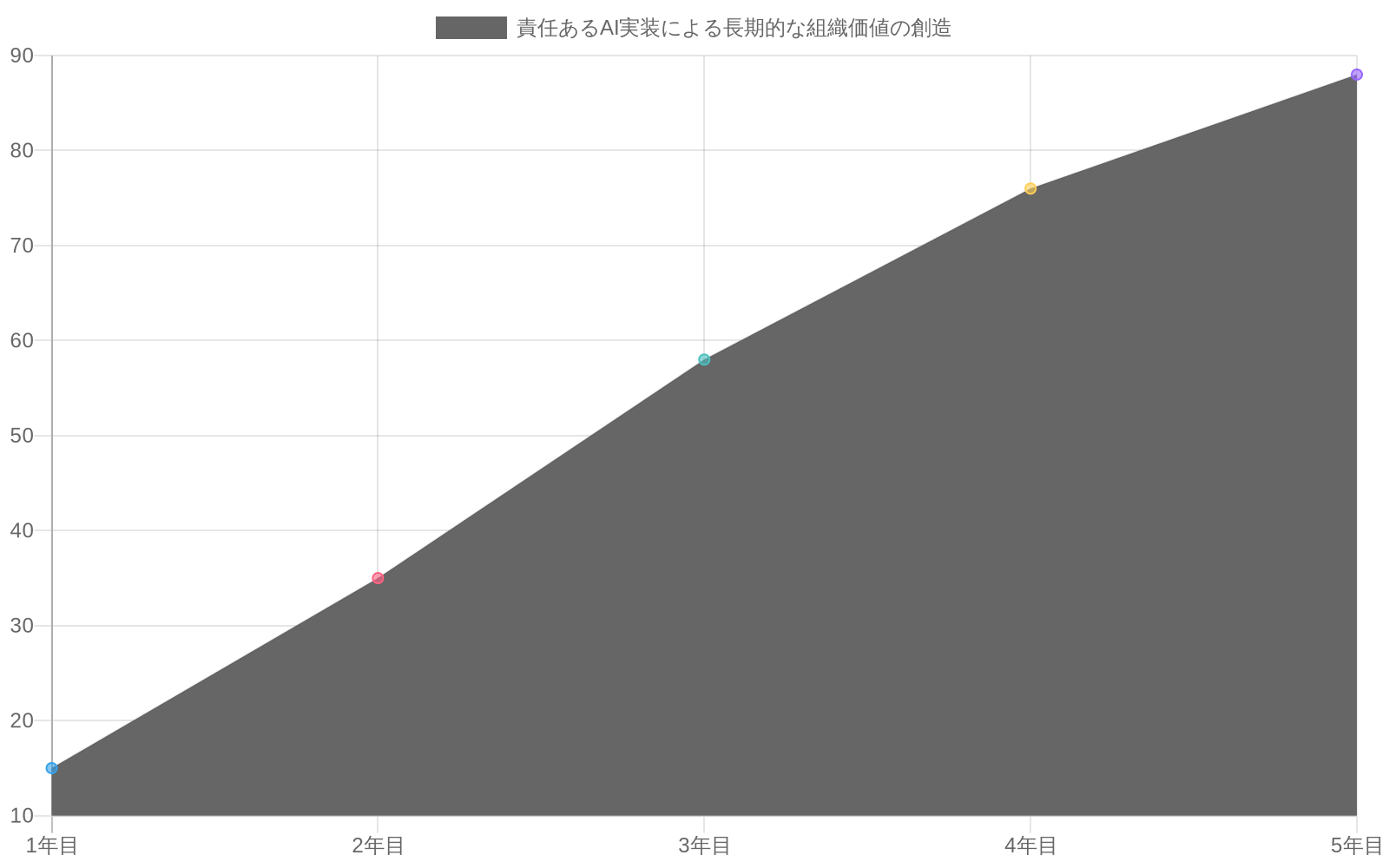

より長期的な視点:責任あるAIを競争優位へ

われわれは組織がいかに競争するかについての根本的転換の始まりにいる。今後5~10年で、責任あるAIはコンプライアンス要件から中核的な競争差別化要因へと移行する。これらのリソースの体系的活用、コミュニティ参加、継続的学習を通じて今から深い専門性を構築する組織が、自らの市場をリードするだろう。

ここに列挙されたリソースはコンプライアンスのための単なるツールではない。時間とともに複利的に増加する組織的能力を構築するためのインフラストラクチャである。読まれたブログ記事ひとつ、研究されたケーススタディひとつ、参加したコミュニティ対話ひとつ、完了した研修コースひとつ—これらはすべて組織の将来的な回復力と競争力への投資である。

AI駆動型経済で繁栄する組織は、強力なAIシステムを責任を持って、規模を拡大して、競合他社より迅速に展開できる組織だ。これらのリソースはその能力を構築する手段である。今日から始めよ。

- 図14:責任あるAI実装による長期的価値創造(出典:組織的AI導入事例の集計分析)*

- 図2:責任あるAI実装の5つの機能領域と相互関係*

- 図12:情報から実行への統合戦略フロー*